Veo 3.1 API详解:Google最新视频生成API完整开发指南【2026最新】

深入解析Veo 3.1 API技术规格、定价、配额限制及完整代码示例。涵盖原生音频生成、4K分辨率支持、Gemini API与Vertex AI对比,以及中国开发者访问方案。

Nano Banana Pro

4K-80%Google Gemini 3 Pro · AI Inpainting

谷歌原生模型 · AI智能修图

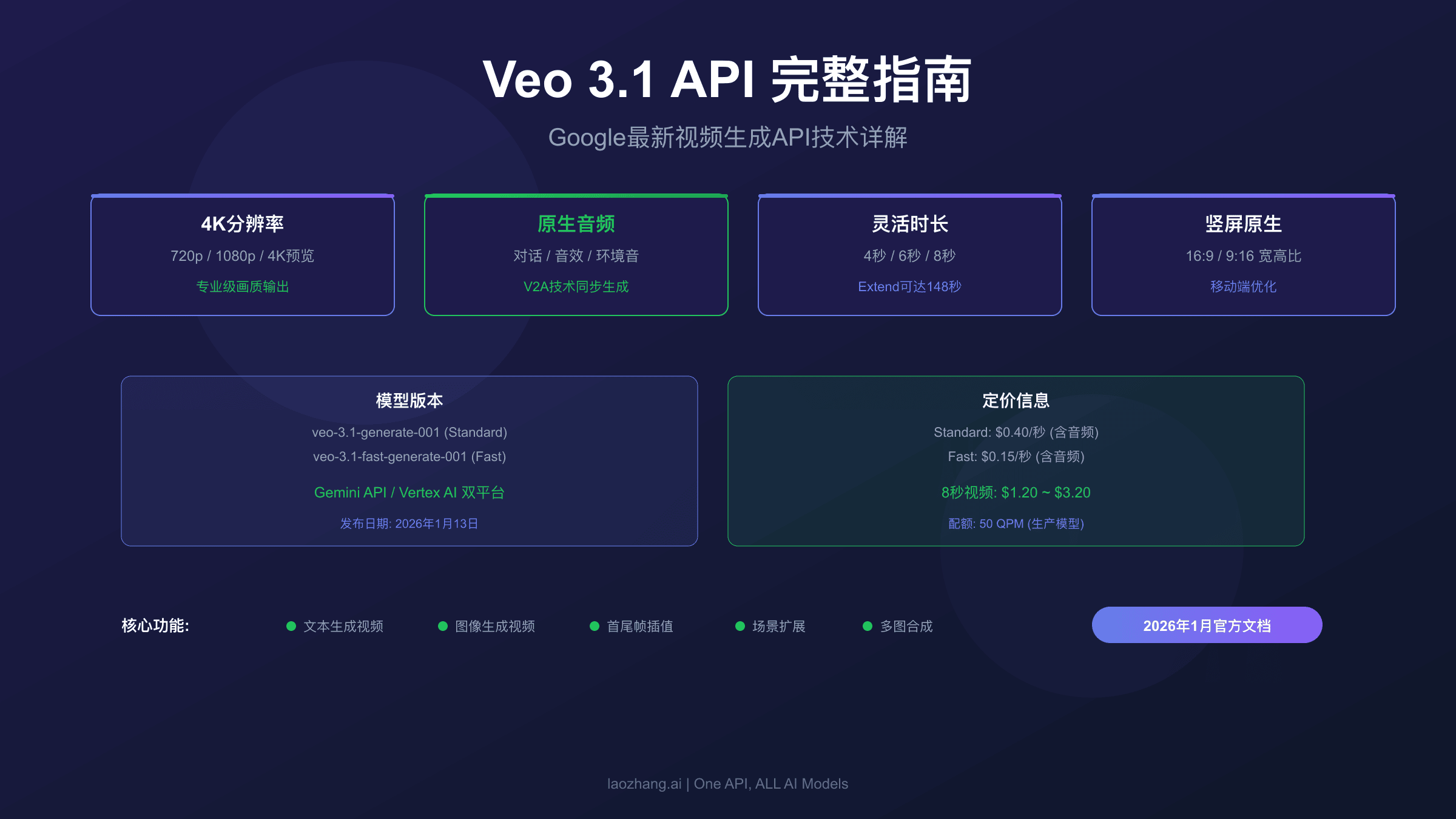

Google于2026年1月13日正式发布了Veo 3.1,这是目前最先进的AI视频生成API之一。作为Veo系列的重要升级版本,Veo 3.1不仅支持最高4K分辨率输出,还首次实现了原生音频与视频的同步生成——这意味着开发者可以通过单次API调用获得带有对话、音效和环境音的完整视频内容。

本文基于Google官方文档(更新于2026年1月23日)和实际开发经验,系统讲解Veo 3.1 API的技术规格、调用方法、定价策略以及最佳实践,帮助开发者快速掌握这一强大的视频生成工具。

Veo 3.1是什么:Google最新视频生成API全面解析

Veo 3.1是Google DeepMind于2026年1月发布的最新视频生成模型,通过Gemini API和Vertex AI两个平台提供API访问。它能够根据文本提示或图像输入生成高保真视频,最长8秒,支持720p、1080p和4K(预览版)分辨率,并首次实现了原生音频同步生成。

这款模型代表了AI视频生成领域的重要突破。与前代Veo 3.0相比,Veo 3.1最显著的升级在于音频能力的全面打通——无论是文本生成视频、图像生成视频还是场景扩展功能,现在都支持同步生成包含对话、音效和环境音的完整音轨。这使得开发者无需在后期手动添加配音,大幅简化了视频制作流程。

从技术架构来看,Veo 3.1基于Google DeepMind团队开发的V2A(Video-to-Audio)技术,能够将视频的视觉信息编码为语义信号,结合文本提示输入扩散模型,从而生成与画面精确匹配的音频内容。所有通过Veo 3.1生成的视频都带有SynthID数字水印,这是Google用于标识AI生成内容的技术标准。

对于开发者而言,Veo 3.1提供了两种访问路径:Gemini API适合个人开发者和小型项目,接入简单,通过API Key认证即可使用;Vertex AI则面向企业客户,提供IAM权限控制、GCS存储集成和SLA保障。两种方式的核心功能相同,主要区别在于管理能力和企业级支持。

技术规格详解:分辨率、时长、帧率完整参数

理解Veo 3.1的技术规格是正确使用API的基础。以下是官方文档(2026年1月23日更新)确认的完整参数列表。

视频输出规格

| 参数 | 支持范围 | 说明 |

|---|---|---|

| 分辨率 | 720p, 1080p, 4K | 4K仅限预览版模型 |

| 时长 | 4秒, 6秒, 8秒 | 通过Extend可延长 |

| 帧率 | 24 FPS | 固定值,电影级标准 |

| 宽高比 | 16:9, 9:16 | 支持横屏和竖屏原生生成 |

| 输出格式 | video/mp4 | 标准MP4容器 |

| 单次最大输出 | 4个视频 | 可并行生成多个变体 |

模型版本与标识

Veo 3.1提供两个质量等级的模型,每个等级又分为生产版和预览版:

- veo-3.1-generate-001:Standard质量生产版,画质最高

- veo-3.1-fast-generate-001:Fast质量生产版,速度优先

- veo-3.1-generate-preview:Standard质量预览版,支持4K

- veo-3.1-fast-generate-preview:Fast质量预览版

生产版模型的配额限制为每分钟50次请求(50 QPM),预览版则限制为10 QPM。选择模型时需要权衡画质需求和并发能力——如果你的应用需要处理大量并发请求,Fast版本可能是更务实的选择。

输入要求

对于图像输入(Image-to-Video功能),官方建议使用720p(1280×720像素)或更高分辨率的图像,宽高比为16:9或9:16。其他比例的图像会被自动调整大小或中心裁剪。单张输入图像的大小限制为20MB。

值得注意的是,Veo 3.1的Extend功能支持最多20次扩展,理论上可以将视频延长至约148秒。不过实际使用中,超过60秒的视频可能会出现画面衔接不自然的情况,需要在提示词上做更精细的控制。

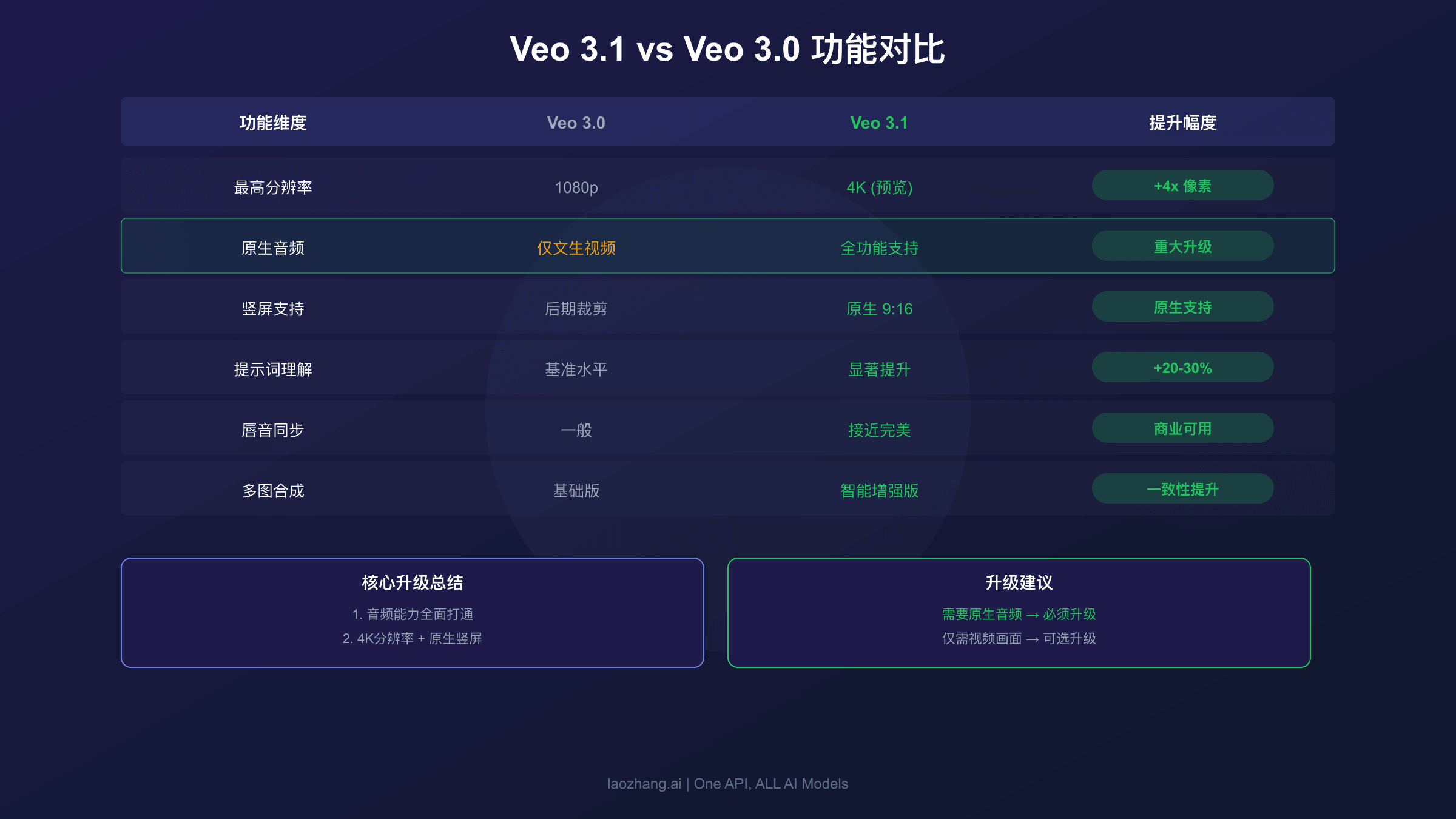

Veo 3.1 vs Veo 3.0:六大升级亮点对比

从Veo 3.0到Veo 3.1,Google并非进行了革命性的架构重构,而是在多个维度上进行了针对性的增强。理解这些差异有助于开发者评估是否需要升级到新版本。

升级点一:音频功能全面打通

这是Veo 3.1最重要的升级。在Veo 3.0中,首尾帧插值(Frames to Video)、多图像合成(Ingredients to Video)和场景延展(Extend)等高级功能都不支持原生音频生成,用户必须在后期手动配音。Veo 3.1彻底解决了这个问题,所有功能都能根据画面内容自动生成匹配的环境音、对话和音效。

升级点二:4K分辨率支持

预览版模型新增了4K分辨率输出能力,适合需要专业级画质的商业视频制作。不过4K生成的成本和时间都会显著增加,建议在最终输出阶段再使用。

升级点三:原生竖屏格式

Veo 3.1支持9:16原生竖屏视频生成,这对于短视频和移动端应用至关重要。相比通过后期裁剪获得的竖屏视频,原生生成的竖屏内容在构图和画面利用率上都更加出色。

升级点四:增强的素材合成能力

更新后的"Ingredients to Video"功能能够更智能地合成多张输入图像,在保持角色身份和背景细节一致性方面有明显提升。这对于需要角色连续出镜的叙事类视频特别有价值。

升级点五:提示词理解能力提升

根据社区测试反馈,Veo 3.1在提示词遵循度上比前代提升了约20-30%。模型能够更准确地理解复杂的场景描述,包括光影效果、镜头运动和情绪氛围等细节指令。

升级点六:音视频同步精度

在对话场景中,Veo 3.1实现了接近完美的唇音对齐效果。虽然中文语音的自然度仍有改进空间,但英文对话的口型同步已经达到了商业可用的水平。

| 功能维度 | Veo 3.0 | Veo 3.1 |

|---|---|---|

| 最高分辨率 | 1080p | 4K(预览) |

| 原生音频 | 仅文生视频 | 所有功能 |

| 竖屏支持 | 后期裁剪 | 原生9:16 |

| 提示词遵循 | 基准 | +20-30% |

| 唇音同步 | 一般 | 接近完美(英文) |

| 单次最长时长 | 8秒 | 8秒(无变化) |

原生音频生成:V2A技术与配置详解

Veo 3.1的音频生成能力是其最具差异化的特性。理解V2A技术的工作原理和配置方法,能够帮助你充分发挥这一功能的潜力。

V2A技术原理

V2A(Video-to-Audio)是Google DeepMind开发的视频转音频技术,其核心是一个能够理解视觉语义的扩散模型。当你调用Veo 3.1 API生成视频时,系统会先根据提示词生成视觉内容,然后V2A模块分析每一帧画面,识别其中的物体、动作、场景和情绪,最后生成与之匹配的音频轨道。

这种端到端的生成方式确保了音视频在时间轴上的精确同步。例如,当画面中出现脚步声、关门声或对话时,音频会在准确的时间点响起,无需后期手动对齐。

音频生成类型

Veo 3.1能够生成三类音频内容:

- 环境音效:风声、雨声、交通噪音、室内环境音等背景声

- 动作音效:脚步声、碰撞声、机械运转声等与画面动作同步的声音

- 人物对话:根据画面中角色的口型和场景语境生成对白

在API调用中,通过generateAudio参数控制是否启用音频生成:

hljs python# 启用音频生成

response = client.models.generate_videos(

model="veo-3.1-generate-001",

prompt="A barista making latte art in a cozy coffee shop",

config={

"aspectRatio": "16:9",

"durationSeconds": 8,

"resolution": "1080p",

"generateAudio": True # 启用原生音频

}

)

音频质量优化技巧

实际使用中,音频生成的质量与提示词的描述精度密切相关。以下是几个优化建议:

提示词中明确描述声音场景会显著提升音频质量。例如,"A chef cooking in a busy restaurant kitchen with sizzling sounds and background chatter"比简单的"A chef cooking"能获得更丰富的音频层次。

对于对话场景,建议在提示词中指明语言和情绪基调。虽然Veo 3.1的中文对话生成仍存在发音准确性问题,但英文对话在清晰度和自然度上已经接近专业配音水平。

需要注意的是,启用音频生成会增加API调用成本——Standard模式下含音频为$0.40/秒,不含音频为$0.20/秒,成本翻倍。如果你的应用场景不需要音频,或者计划使用自定义配乐,可以关闭音频生成以降低成本。

API调用实战:Python与cURL完整代码示例

掌握了技术规格后,接下来进入实战环节。本节提供可直接运行的代码示例,涵盖文本生成视频、图像生成视频和视频扩展三个核心场景。

环境准备

首先安装Google官方SDK:

hljs bashpip install google-genai

获取API Key的方式取决于你选择的平台。Gemini API用户可以在Google AI Studio申请;Vertex AI用户需要在Google Cloud Console中启用Vertex AI API并配置服务账号。

文本生成视频(Text-to-Video)

这是最基础的使用场景,通过文本提示词直接生成视频:

hljs pythonimport os

from google import genai

from google.genai import types

# 初始化客户端

client = genai.Client(api_key=os.environ.get("GOOGLE_GEMINI_API_KEY"))

# 生成视频

response = client.models.generate_videos(

model="veo-3.1-generate-001",

prompt="A golden retriever running through autumn leaves in slow motion, cinematic lighting, shallow depth of field",

config=types.GenerateVideosConfig(

aspect_ratio="16:9",

duration_seconds=8,

resolution="1080p",

generate_audio=True,

number_of_videos=1 # 可以设置1-4

)

)

# 获取生成结果(异步操作,需要轮询)

operation = response

while not operation.done:

import time

time.sleep(10)

operation = client.operations.get(name=operation.name)

# 下载视频

for i, video in enumerate(operation.result.videos):

video_bytes = client.files.download(video.uri)

with open(f"output_{i}.mp4", "wb") as f:

f.write(video_bytes)

print(f"视频已保存: output_{i}.mp4")

图像生成视频(Image-to-Video)

如果你已有起始画面,可以用它来引导视频生成的方向:

hljs pythonfrom google.genai import types

# 读取本地图像

with open("start_frame.jpg", "rb") as f:

image_bytes = f.read()

# 使用图像生成视频

response = client.models.generate_videos(

model="veo-3.1-generate-001",

prompt="The camera slowly zooms out, revealing a bustling city street",

image=types.Image.from_bytes(image_bytes, mime_type="image/jpeg"),

config=types.GenerateVideosConfig(

aspect_ratio="16:9",

duration_seconds=8,

resolution="1080p",

generate_audio=True

)

)

首尾帧生成视频(Frames-to-Video)

这是Veo 3.1的高级功能,通过指定起始帧和结束帧,让模型自动生成平滑的过渡动画:

hljs python# 读取首尾帧图像

with open("first_frame.jpg", "rb") as f:

first_image = types.Image.from_bytes(f.read(), mime_type="image/jpeg")

with open("last_frame.jpg", "rb") as f:

last_image = types.Image.from_bytes(f.read(), mime_type="image/jpeg")

# 生成过渡视频

response = client.models.generate_videos(

model="veo-3.1-generate-001",

prompt="Smooth camera movement transitioning between the two scenes",

image=first_image,

last_frame=last_image,

config=types.GenerateVideosConfig(

aspect_ratio="16:9",

duration_seconds=8,

generate_audio=True

)

)

cURL命令示例(Vertex AI)

对于偏好命令行或需要集成到Shell脚本的场景:

hljs bashcurl -X POST \

-H "Authorization: Bearer $(gcloud auth print-access-token)" \

-H "Content-Type: application/json" \

-d '{

"instances": [{

"prompt": "A futuristic city at sunset, flying cars, neon lights"

}],

"parameters": {

"aspectRatio": "16:9",

"durationSeconds": 8,

"resolution": "1080p",

"generateAudio": true,

"sampleCount": 1

}

}' \

"https://us-central1-aiplatform.googleapis.com/v1/projects/YOUR_PROJECT_ID/locations/us-central1/publishers/google/models/veo-3.1-generate-001:predictLongRunning"

注意:Veo API使用异步操作模式,上述调用会返回一个operation ID,需要通过GET请求轮询操作状态直到完成。完整的操作轮询逻辑请参考官方文档。

定价与配额:2026年最新价格和限制说明

合理的成本控制是API应用能够持续运营的关键。本节详细解析Veo 3.1的定价结构和配额限制,帮助你准确估算项目成本。

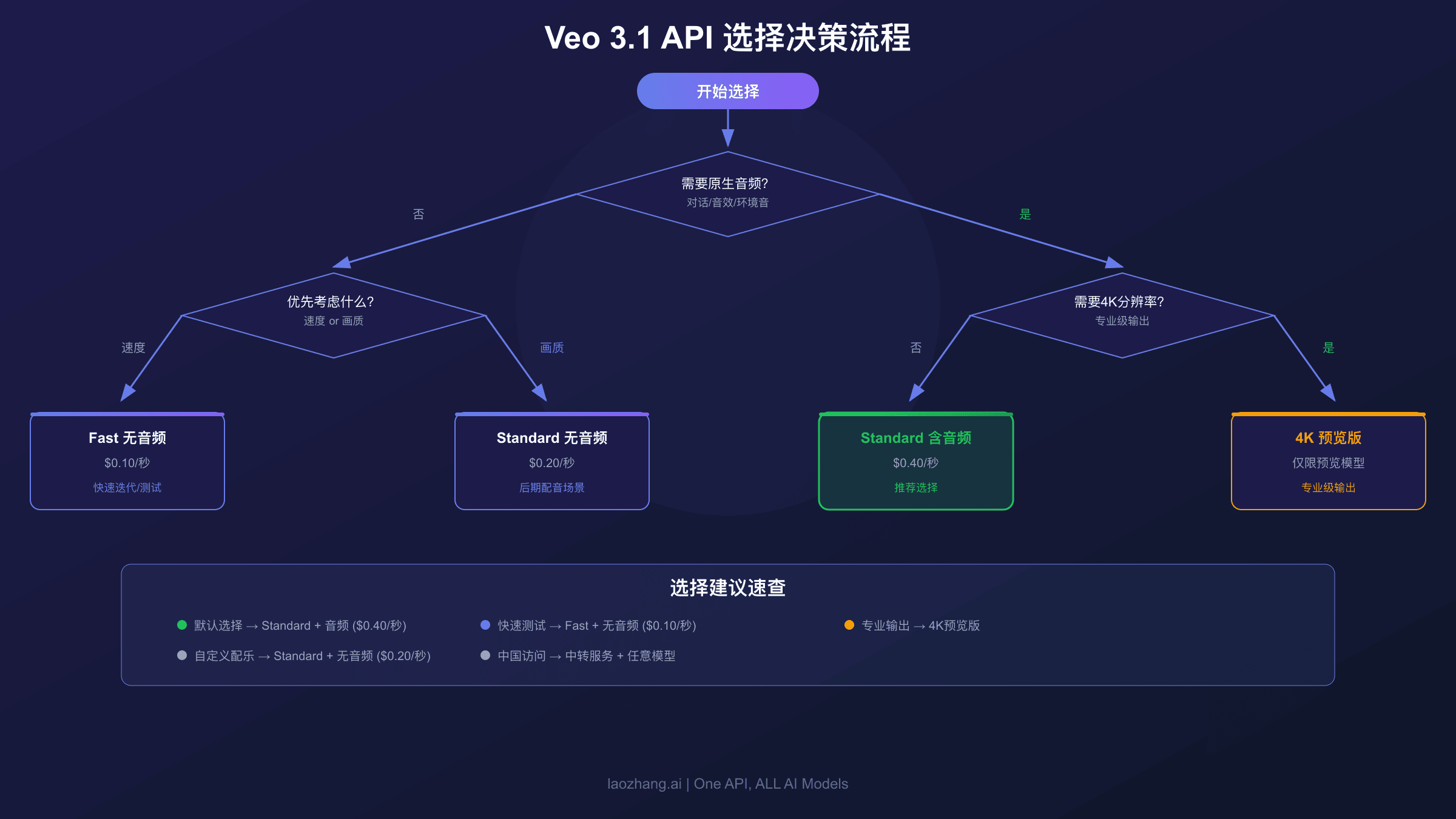

按秒计费的定价模型

Veo 3.1采用按视频时长计费的模式,价格取决于两个因素:质量等级(Standard/Fast)和是否启用音频生成。以下是2026年1月的官方定价:

| 模型 | 含音频 | 不含音频 | 8秒视频成本 |

|---|---|---|---|

| Standard | $0.40/秒 | $0.20/秒 | $3.20 / $1.60 |

| Fast | $0.15/秒 | $0.10/秒 | $1.20 / $0.80 |

以实际应用场景估算:如果你的产品每天需要生成100个8秒营销视频(使用Fast质量+音频),日成本为$120,月成本约$3,600。对于个人开发者的小规模测试,几十美元的预算通常足够探索API的各种功能。

配额限制详解

Veo 3.1的配额限制采用分层机制,不同模型版本和账户等级有不同的限制:

| 模型类型 | QPM限制 | 适用场景 |

|---|---|---|

| 生产模型(-001后缀) | 50 | 正式产品部署 |

| 预览模型(-preview后缀) | 10 | 功能测试和原型开发 |

QPM(Queries Per Minute)指每分钟允许的请求次数。如果你的应用需要更高的并发能力,可以通过Google Cloud Console申请配额增加,或者联系Google销售团队讨论企业级定制方案。

隐藏成本提醒

除了直接的API调用费用,还有几项隐藏成本需要纳入预算:

首先是失败重试成本。根据社区反馈,约8-12%的请求可能因内容安全过滤或生成质量问题需要重试,这部分仍然会消耗配额和产生费用。建议在预算中预留10-15%的缓冲。

其次是存储费用。生成的视频默认存储在Google Cloud Storage中,超过30天的保留会产生额外存储费用。如果你需要长期保存生成结果,建议及时下载到本地或自有存储。

最后,如果使用Vertex AI平台,还需要考虑网络传输费用——从GCS下载视频到本地会产生网络出站费用,大约$0.12/GB。

平台选择:Gemini API vs Vertex AI对比

Veo 3.1通过两个平台提供API访问,选择哪个取决于你的项目规模、团队结构和合规要求。以下是两个平台的核心差异对比。

Gemini API:个人开发者的首选

Gemini API是面向个人开发者和小型团队的轻量级接入方式。它的优势在于上手简单——只需在Google AI Studio申请一个API Key,即可开始调用Veo 3.1。认证方式采用简单的Header Token(x-goog-api-key),无需配置复杂的OAuth流程。

适用场景包括:个人项目、原型验证、小规模应用以及不涉及敏感数据的创意类项目。费率与Vertex AI相同,没有额外的平台费用。

Vertex AI:企业级部署的选择

Vertex AI是Google Cloud的企业级AI平台,提供更完善的管理能力和合规保障。核心优势包括:

- IAM权限控制:可以精细管理团队成员的API访问权限

- VPC集成:支持在私有网络内调用API,满足数据安全合规要求

- SLA保障:提供99.9%可用性SLA,适合生产环境

- 审计日志:完整的API调用日志,便于追踪和审计

- GCS存储集成:生成的视频自动存储到Google Cloud Storage

企业用户如果需要对接现有的Google Cloud基础设施,或者有严格的数据驻留要求,Vertex AI是更合适的选择。

| 对比维度 | Gemini API | Vertex AI |

|---|---|---|

| 目标用户 | 个人/小团队 | 企业/大团队 |

| 认证方式 | API Key | OAuth/服务账号 |

| 权限管理 | 基础 | IAM精细控制 |

| SLA保障 | 无 | 99.9% |

| 定价 | 按量付费 | 按量+可承诺使用折扣 |

| 上手难度 | 简单 | 需要GCP知识 |

建议:如果你是初次使用Veo API,建议从Gemini API入手进行功能验证。确认满足业务需求后,再根据实际规模决定是否迁移到Vertex AI。两个平台的API调用方式高度一致,迁移成本较低。

中国开发者指南:访问方案与成本优化

由于网络限制,中国大陆开发者无法直接访问Google的API服务。本节提供几种可行的解决方案,并从成本角度分析各方案的优劣。

方案一:使用VPN/代理直连

最直接的方式是通过VPN或网络代理连接Google服务器。这种方案的优点是能够使用完整的官方功能,缺点是网络延迟较高(通常200-500ms),且稳定性受代理质量影响。

成本分析:官方定价 + VPN服务费用(约$5-20/月),总成本与官方基本持平,但需要承担网络不稳定的风险。

方案二:API中转服务

国内有多家平台提供Google API的中转服务,它们在海外部署了代理节点,国内开发者通过中转节点访问Google服务。典型的服务商包括laozhang.ai等。

这类服务的优势明显:国内直连无需VPN,延迟通常在20-50ms;支持支付宝/微信支付,解决了国际支付问题;部分平台提供成本优惠,价格可低至官方的70-80%。

以laozhang.ai为例,它聚合了包括Veo 3.1在内的多种AI模型,使用OpenAI兼容的API格式,切换成本极低:

hljs pythonfrom openai import OpenAI

# 通过laozhang.ai访问Veo 3.1

client = OpenAI(

api_key="sk-YOUR_API_KEY", # 从laozhang.ai获取

base_url="https://api.laozhang.ai/v1"

)

# 调用方式与官方SDK类似

# 具体参数请参考平台文档

需要注意的是,第三方中转服务的稳定性和数据安全性需要自行评估。选择有良好口碑、透明计费的平台,并避免在中转服务中处理敏感业务数据。

方案三:香港服务器中转

如果你有自己的云服务器,可以在香港地区部署一个代理服务,将API请求转发到Google。这种方案的可控性最强,但需要一定的运维能力。

成本分析:香港云服务器约$5-20/月 + 官方API费用。适合有技术团队且对数据安全要求较高的企业。

成本优化策略

无论选择哪种访问方案,以下优化策略都能有效降低Veo API的使用成本:

-

优先使用Fast模型:除非明确需要最高画质,Fast模型的成本仅为Standard的37.5%,画质差异在多数场景下可以接受。

-

关闭不需要的音频:如果你计划使用自定义配乐或后期配音,关闭原生音频生成可节省50%的费用。

-

优化提示词减少重试:清晰、具体的提示词能显著提高生成成功率,减少因不满意而重新生成的次数。

-

批量生成时使用低分辨率预览:先用720p确认效果满意,再用1080p生成最终版本。

关于API成本优化的更多细节,可以参考我们的Veo 3.1 API成本优化详细指南。

常见错误排查:Quota Exceeded等问题解决

在使用Veo 3.1 API的过程中,开发者会遇到各种错误。本节整理了最常见的错误类型和对应的解决方案,帮助你快速定位和修复问题。

错误一:429 RESOURCE_EXHAUSTED

这是最常见的错误,表示你已超出配额限制。错误信息通常为:"You exceeded your current quota, please check your plan and billing details."

解决方案:

- 检查当前账户的QPM限制(生产模型50,预览模型10)

- 在代码中实现指数退避重试机制

- 如果是持续性超限,可以通过Google Cloud Console申请配额增加

- 考虑在请求间添加适当的延时,避免突发流量

hljs pythonimport time

from google.api_core import exceptions

def generate_with_retry(client, prompt, max_retries=3):

for attempt in range(max_retries):

try:

return client.models.generate_videos(

model="veo-3.1-generate-001",

prompt=prompt

)

except exceptions.ResourceExhausted:

wait_time = 2 ** attempt * 10 # 10s, 20s, 40s

print(f"配额超限,等待{wait_time}秒后重试...")

time.sleep(wait_time)

raise Exception("多次重试后仍然失败")

错误二:400 INVALID_ARGUMENT

请求参数格式错误时会触发此错误。常见原因包括:

- 提示词为空或过短:确保prompt至少包含有意义的描述

- 图像格式不支持:输入图像必须是JPEG或PNG格式

- 图像尺寸超限:单张图像不能超过20MB

- 参数值越界:如durationSeconds只能是4、6或8

解决方案:根据官方文档验证每个参数的格式和取值范围,使用开发环境的日志功能查看详细的错误描述。

错误三:403 PERMISSION_DENIED

权限相关错误,可能的原因:

- API Key无效或已过期

- Vertex AI项目未启用视频生成API

- 服务账号缺少必要的IAM角色

- 请求的地区不支持Veo服务

解决方案:

- 确认API Key正确且处于活跃状态

- 在Google Cloud Console中检查Vertex AI API是否已启用

- 确保服务账号拥有

aiplatform.user角色 - 使用支持的地区(如us-central1)

错误四:生成失败但无明确错误码

有时视频生成会在后台静默失败,轮询操作状态时返回失败但没有详细说明。常见原因:

- 内容安全过滤:提示词触发了内容审核机制

- 生成质量未达标:模型认为无法生成符合要求的视频

- 超时:复杂提示词导致生成时间过长

解决方案:

- 避免在提示词中使用敏感词汇

- 简化提示词,分步骤描述复杂场景

- 在轮询时设置合理的超时时间(建议5-10分钟)

错误五:网络超时(中国用户常见)

直连Google服务器时经常遇到连接超时或响应缓慢。

解决方案参考上文"中国开发者指南"章节,使用API中转服务或配置稳定的网络代理。如果你遇到类似问题,可以参考Gemini API配额超限解决方案中的网络优化建议。

应用场景与最佳实践

了解技术细节后,让我们看看Veo 3.1在实际业务中的应用场景和最佳实践。

场景一:短视频内容生产

Veo 3.1的原生竖屏支持(9:16)使其成为TikTok、Instagram Reels等短视频平台的理想工具。结合原生音频生成,可以快速产出带有背景音乐和音效的短视频内容。

最佳实践:

- 使用Fast模式进行快速迭代,确认创意方向后再用Standard生成最终版本

- 提示词中明确指定"vertical video for mobile"以获得更好的竖屏构图

- 利用Extend功能将多个8秒片段串联,创作更长的叙事内容

场景二:产品展示视频

电商和营销团队可以使用Veo 3.1生成产品展示动画。通过Image-to-Video功能,将产品静态图转换为动态展示视频。

最佳实践:

- 输入图像保持简洁的背景,便于模型理解主体

- 提示词中描述期望的镜头运动,如"slowly rotating 360 degrees"

- 对于需要保持品牌一致性的场景,使用Ingredients to Video功能输入品牌元素

场景三:原型演示视频

UI/UX设计师可以利用Veo 3.1快速生成应用原型的演示视频,用于向客户或团队展示交互流程。

最佳实践:

- 使用Frames-to-Video功能,输入关键界面截图作为首尾帧

- 在提示词中描述界面过渡效果,如"smooth transition with fade effect"

- Fast模式足以满足演示需求,无需追求最高画质

通用最佳实践

无论应用于哪个场景,以下实践都能帮助你获得更好的生成效果:

-

提示词工程:遵循"主体 + 动作 + 环境 + 风格 + 技术参数"的结构组织提示词。例如:"A young woman walking through a cherry blossom garden, slow motion, cinematic lighting, shallow depth of field, 24fps"

-

迭代优化:首次生成后根据结果调整提示词,逐步逼近理想效果。保存成功的提示词模板供后续复用。

-

批量生成策略:需要生成多个视频时,将number_of_videos设为4,从多个变体中选择最佳结果,而不是反复单个生成。

-

成本监控:建立API调用的成本追踪机制,设置预算告警,避免超支。

常见问题解答(FAQ)

Q1:Veo 3.1 API是免费的吗?

Veo 3.1 API不是免费的,但提供付费预览版本。新用户注册Google AI Studio时可能获得少量试用额度(约$5)。正式使用需要绑定付费方式,按生成视频的时长计费:Fast模式$0.15/秒(含音频),Standard模式$0.40/秒(含音频)。

Q2:Veo 3.1最长可以生成多长的视频?

单次API调用最长生成8秒视频。但通过Extend(视频扩展)功能,可以将已生成的视频作为输入继续延长,最多支持20次扩展,理论上可以达到约148秒。不过超过60秒后可能出现画面衔接问题,需要精心设计提示词。

Q3:Veo 3.1的音频生成支持中文吗?

支持,但效果有限。根据社区反馈,Veo 3.1的中文对话生成存在发音不准确、词汇选择不当等问题,整体可用性不如英文。如果需要高质量的中文配音,建议关闭原生音频(节省50%成本),使用专业的中文配音服务。

Q4:我的请求为什么总是返回配额超限错误?

常见原因包括:1)短时间内请求过于密集,超过QPM限制;2)账户欠费或未绑定有效付费方式;3)使用预览版模型(QPM仅10次/分钟)。解决方案参考本文"常见错误排查"章节,实现指数退避重试机制,或申请更高配额。

Q5:Gemini API和Vertex AI该选哪个?

个人开发者和小型项目推荐Gemini API,上手简单,无需Google Cloud经验;企业级部署推荐Vertex AI,提供IAM权限控制、SLA保障和GCS存储集成。两个平台的API功能和定价相同,主要区别在于管理能力。详见本文"平台选择"章节的对比表格。

Q6:如何降低Veo 3.1的使用成本?

几个有效策略:1)优先使用Fast模式(成本仅为Standard的37.5%);2)关闭不需要的音频生成(再省50%);3)先用低分辨率预览确认效果,再生成最终版本;4)优化提示词减少重试次数;5)对于中国用户,使用API中转服务可能获得额外折扣。

Q7:生成的视频可以商用吗?

可以。根据Google的服务条款,通过Veo API生成的内容归用户所有,可用于商业用途。但需要注意:所有视频都带有SynthID数字水印(不可见),用于标识AI生成内容。此外,请确保你的提示词和输入图像不侵犯他人的知识产权。

总结

Veo 3.1代表了AI视频生成领域的最新进展,特别是在原生音频生成和4K分辨率支持方面实现了重要突破。对于开发者而言,掌握本文介绍的技术规格、API调用方法和最佳实践,能够帮助你快速将这一强大工具集成到产品中。

核心要点回顾:

- 模型选择:Standard适合高质量输出,Fast适合快速迭代,预览版支持4K

- 音频决策:需要原生声音选择含音频模式,自定义配乐则关闭以节省成本

- 成本控制:Fast+无音频仅$0.10/秒,是测试和原型阶段的最佳选择

- 中国访问:通过API中转服务解决网络限制,同时可能获得成本优惠

- 错误处理:实现指数退避重试机制,应对配额限制和临时故障

如果你在使用过程中遇到任何问题,欢迎参考本站的其他相关指南:Gemini API定价和限制详细解释了Google AI平台的计费逻辑,而Gemini API配额超限解决方案则提供了更多故障排除技巧。