Cómo usar GPT-5.5 en Codex: inicio con ChatGPT, límite de API key y alternativa GPT-5.4

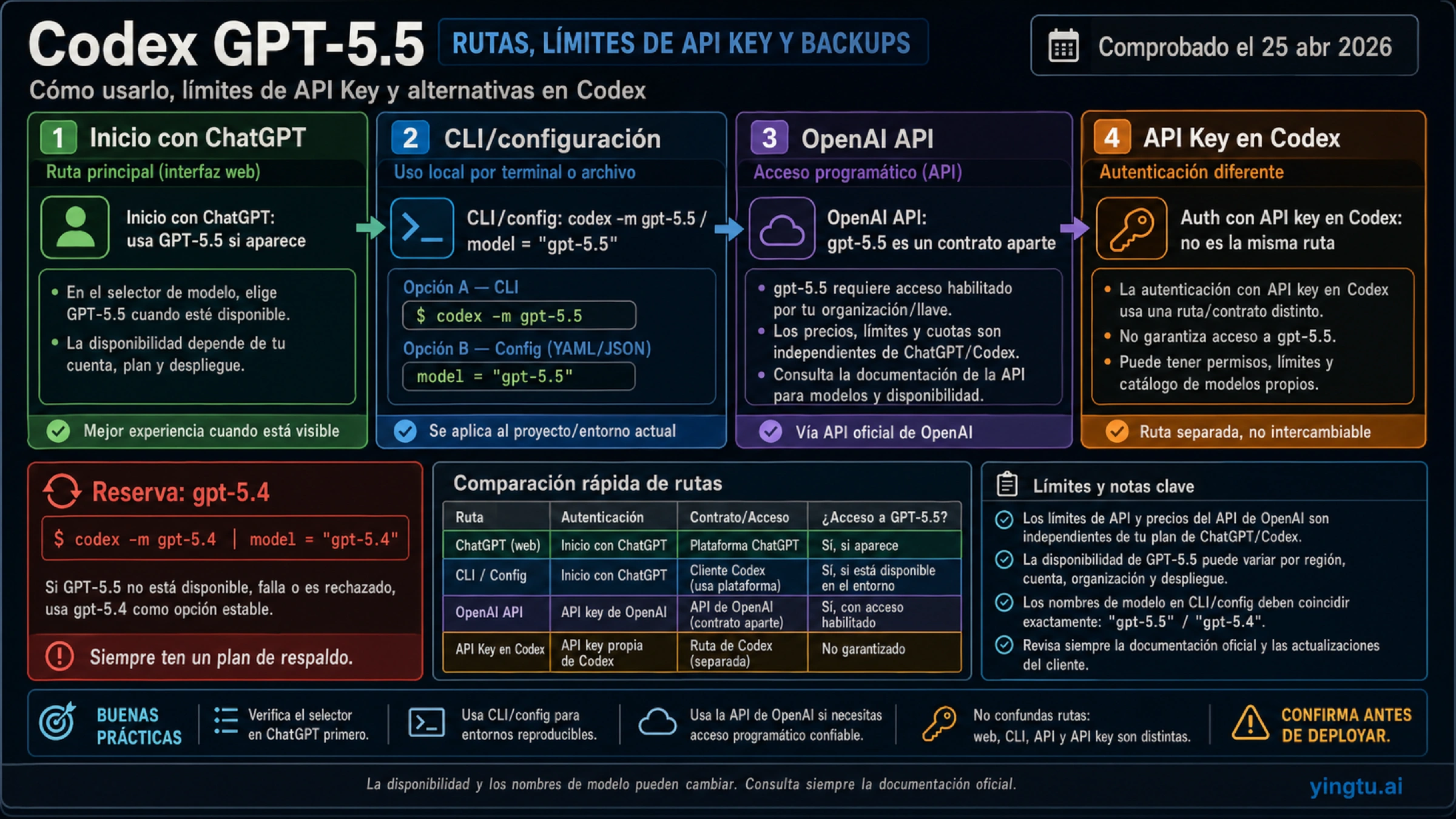

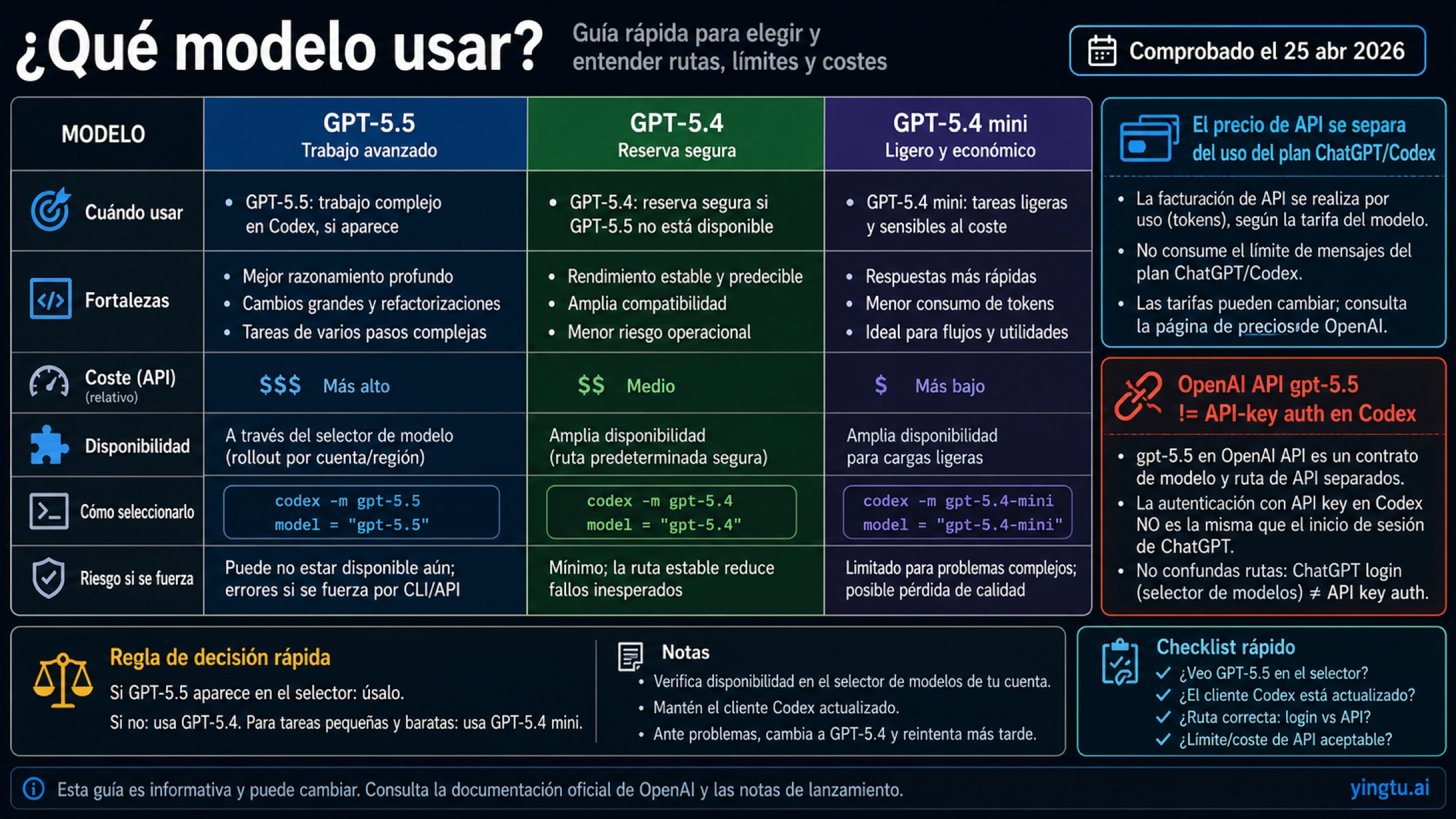

A fecha de 25 de abril de 2026, si Codex muestra GPT-5.5 después de iniciar sesión con ChatGPT, lo normal es probarlo primero para trabajo de desarrollo complejo. La parte que causa errores es otra: que gpt-5.5 exista en OpenAI API no significa que Codex lo acepte cuando se autentica con API key. En local puedes probar codex -m gpt-5.5 o fijar model = "gpt-5.5", pero si el modelo no aparece o el comando se rechaza, conviene revisar la ruta de acceso y volver a gpt-5.4 antes de perder tiempo con combinaciones de nombres.

| Lo que quieres hacer | Ruta que debes probar primero | Comprobación antes de depurar |

|---|---|---|

| Usar el mejor modelo disponible en Codex para una tarea difícil | Codex con inicio de sesión de ChatGPT, si GPT-5.5 aparece en el selector | La cuenta, el plan, el rollout y el cliente deben exponer GPT-5.5. |

| Elegir el modelo desde CLI o configuración | codex -m gpt-5.5 o model = "gpt-5.5" | No fijes un número mínimo de CLI si OpenAI no lo publica como requisito. |

| Llamar GPT-5.5 desde OpenAI API | Usa el model ID gpt-5.5 y la página de API pricing | La facturación de API no es la misma que el acceso de un plan ChatGPT/Codex. |

| Usar Codex con API key | No asumas que GPT-5.5 funciona en esa ruta | La documentación de Codex separa GPT-5.5 con ChatGPT sign-in de API-key authentication. |

| Seguir trabajando si GPT-5.5 no aparece | Vuelve a gpt-5.4 | gpt-5.4-mini sirve para tareas ligeras, no como sustituto de calidad. |

La decisión práctica no empieza por comparar modelos, sino por distinguir rutas. Primero se comprueba cómo entras a Codex, después el comando o la configuración, luego el límite de API y por último la elección entre GPT-5.5, GPT-5.4 y GPT-5.4 mini.

Qué significa GPT-5.5 en Codex

Codex no es un envoltorio que habilita todos los modelos de OpenAI API en todos los lugares al mismo tiempo. Hay app, web, CLI, extensiones de IDE, tareas en la nube, inicio de sesión con ChatGPT y autenticación con API key. Cada superficie puede tener reglas distintas de disponibilidad. Por eso puede ser cierto que gpt-5.5 sea un modelo de OpenAI API y, a la vez, que Codex no lo acepte en una sesión autenticada solo con API key.

La referencia principal es la documentación de OpenAI sobre modelos en Codex. Ahí OpenAI recomienda empezar con gpt-5.5 para la mayoría de tareas de Codex cuando el modelo aparece en el selector. También muestra ejemplos con codex -m gpt-5.5 y model = "gpt-5.5". La misma página separa dos rutas críticas: GPT-5.5 está disponible en Codex con inicio de sesión de ChatGPT, pero no en API-key authentication de Codex en este momento.

Esa separación evita una confusión frecuente. Puedes abrir la página del modelo gpt-5.5 en OpenAI API y ver que existe como modelo de API. Eso no demuestra que un cliente Codex autenticado con API key pueda usarlo. El contrato de API y el contrato de Codex no son una sola cosa.

Codex Cloud añade otra limitación. La documentación de modelos de Codex indica que el modelo predeterminado en Cloud no puede ser cambiado por el usuario actualmente. Un flag local como -m no debe interpretarse como control sobre una tarea Cloud si la propia superficie no ofrece esa elección.

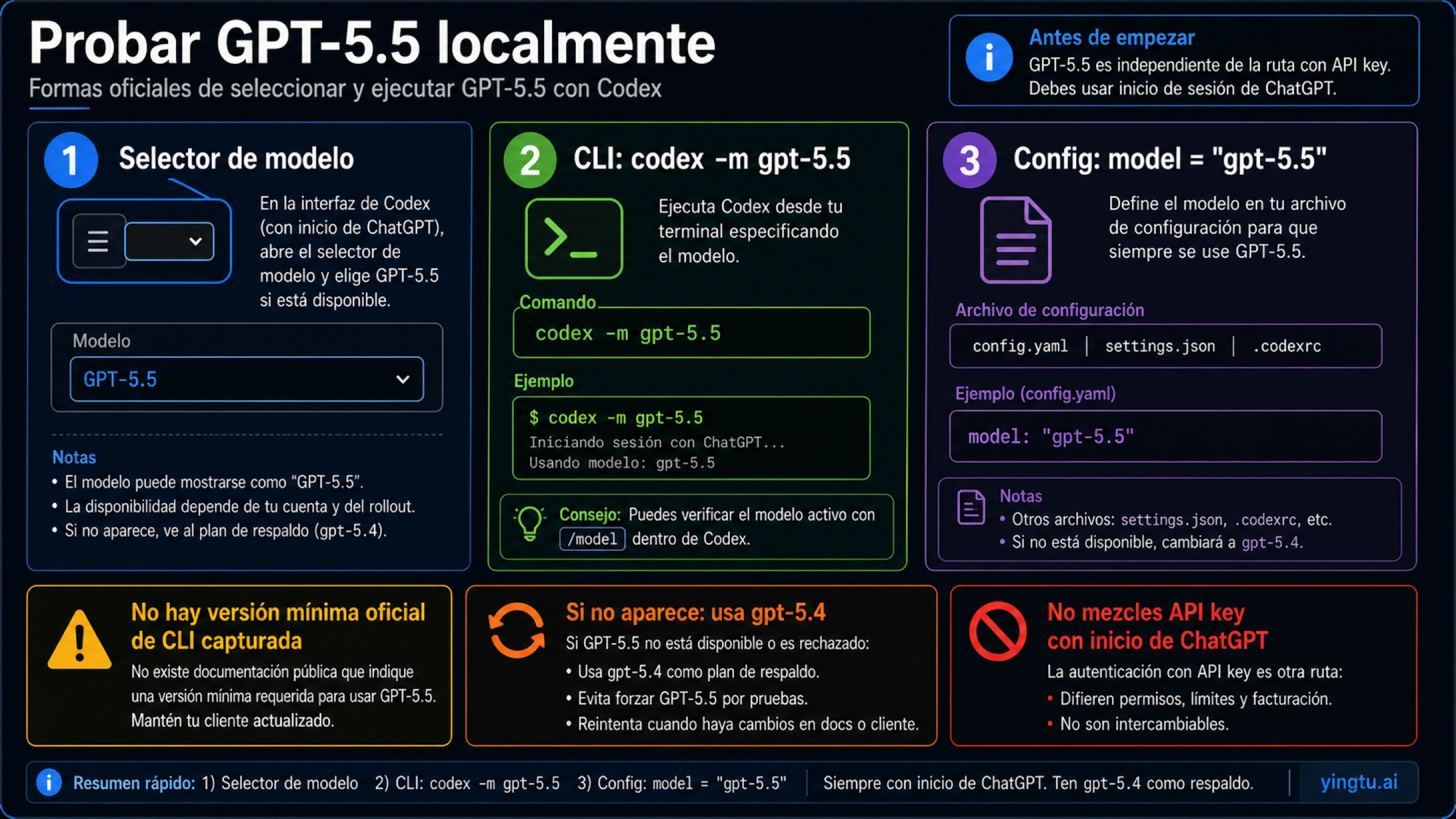

Cómo probar GPT-5.5 en local

Si usas la app de Codex, una extensión de IDE o un cliente local con selector de modelo, mira primero si GPT-5.5 aparece. Cuando aparece, tiene sentido usarlo para cambios de varios archivos, bugs difíciles, decisiones de arquitectura, interfaces con muchas restricciones, refactors con riesgo de regresión y tareas de agente que requieren plan, edición y verificación.

En CLI, la prueba directa es:

hljs bashcodex -m gpt-5.5

Si prefieres fijarlo en configuración, usa el formato que muestra la documentación:

hljs tomlmodel = "gpt-5.5"

No conviertas una observación local en requisito universal. Que tu cliente acepte -m, --model <MODEL> no significa que todas las cuentas, planes, builds, rutas de autenticación o rollouts vean GPT-5.5. El orden razonable es actualizar Codex, confirmar inicio de sesión con ChatGPT, revisar el selector y probar el comando en una tarea pequeña del repositorio.

La primera prueba debe ser acotada. No cambies toda la operación del equipo de una vez. Elige una tarea real pero reversible, como arreglar un bug pequeño con tests o aplicar un cambio de UI con verificación. Si el cliente responde con unsupported model, error de metadata o rechazo de modelo, deja de probar variantes de mayúsculas y vuelve a la ruta de autenticación.

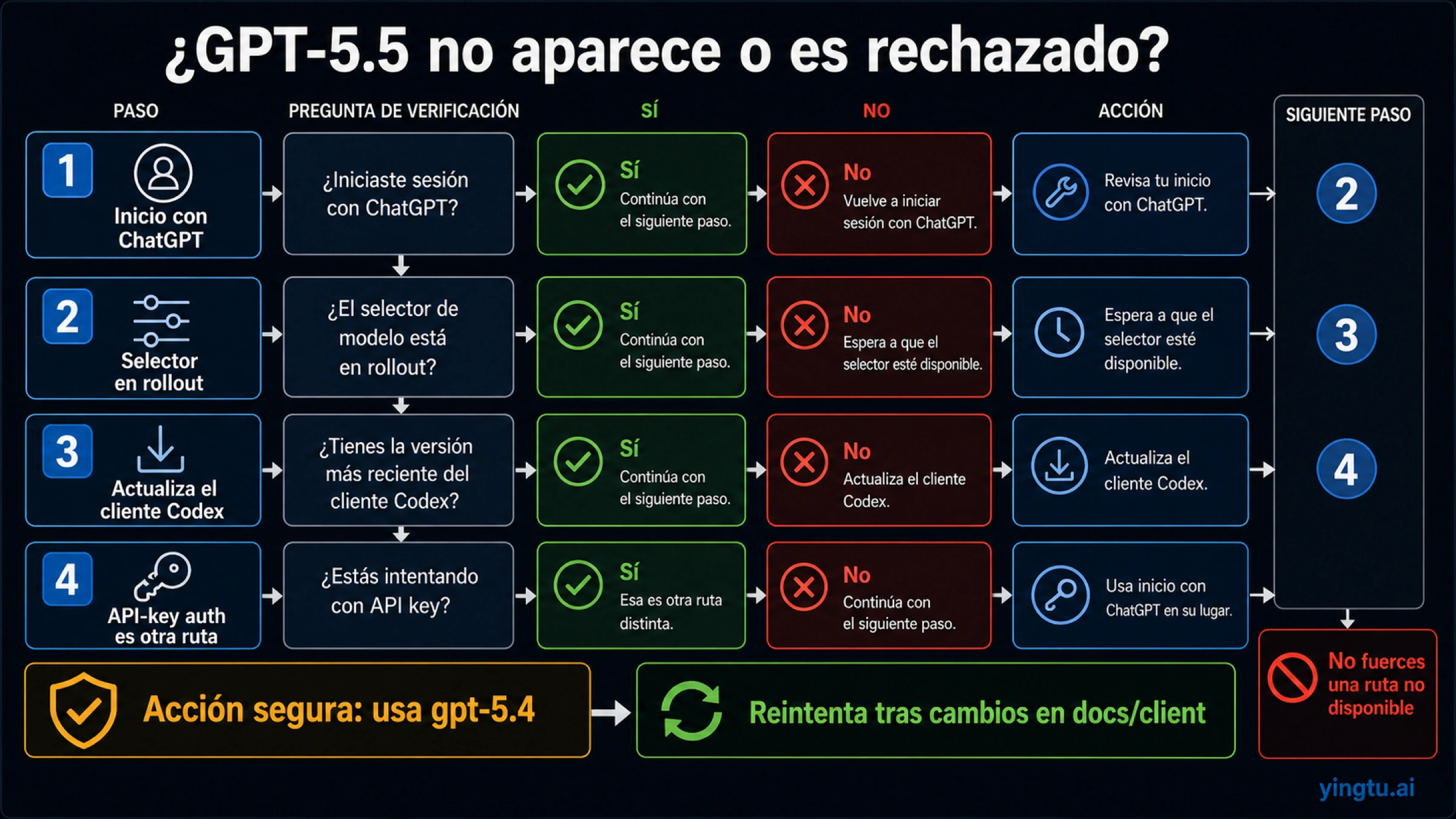

Por qué no aparece o se rechaza

En la práctica se mezclan tres preguntas: cómo se usa Codex, cuánto cuesta GPT-5.5 y si ChatGPT o la API habilitan lo mismo. Para recuperar una sesión que falla, la primera pregunta es más estrecha: la ruta actual permite GPT-5.5 o no.

| Síntoma | Causa probable | Primer paso |

|---|---|---|

| GPT-5.5 no aparece en el selector | La cuenta, el plan, el rollout o el cliente aún no lo exponen | Actualiza el cliente, vuelve a iniciar sesión con ChatGPT y revisa el selector. |

codex -m gpt-5.5 se rechaza | La ruta local no tiene acceso a ese modelo | Confirma si estás usando ChatGPT sign-in o API-key authentication y vuelve a gpt-5.4. |

La documentación de API lista gpt-5.5, pero Codex falla | API access y Codex API-key authentication son contratos distintos | No uses la página de API como prueba de soporte en Codex con API key. |

| Una tarea Cloud corre con otro modelo | Cloud no se controla igual que el CLI local | Revisa el modelo predeterminado de Codex Cloud por separado. |

| La tarea es pequeña y el coste importa más | GPT-5.5 puede ser innecesario | Usa gpt-5.4-mini solo para trabajo ligero y reversible. |

El flujo de recuperación es:

- Confirma si estás en ChatGPT sign-in o API-key authentication.

- Comprueba si el selector de Codex muestra GPT-5.5.

- Actualiza el cliente y prueba de nuevo el selector o

codex -m gpt-5.5. - Si sigue sin aparecer o se rechaza, usa

gpt-5.4. - Reserva

gpt-5.4-minipara tareas pequeñas y reversibles.

Así evitas dos errores: asumir que una ruta comunitaria desbloquea un contrato oficial, o bajar una tarea difícil a mini solo porque la ruta de GPT-5.5 no está disponible todavía.

Límite entre OpenAI API y Codex con API key

La lista de modelos de OpenAI API y la página de gpt-5.5 incluyen el modelo y sus endpoints, como Chat Completions y Responses. Eso resuelve la pregunta de API, no la pregunta de Codex con API key.

A fecha de 25 de abril de 2026, la página de OpenAI API pricing muestra estos precios estándar:

| Modelo | Input | Cached input | Output | Uso adecuado |

|---|---|---|---|---|

gpt-5.5 | $5.00 / 1M tokens | $0.50 / 1M tokens | $30.00 / 1M tokens | API de alta calidad, coding, reasoning y tareas de agente. |

gpt-5.4 | $2.50 / 1M tokens | $0.25 / 1M tokens | $15.00 / 1M tokens | Primera alternativa para Codex o trabajo serio con menor coste. |

gpt-5.4-mini | $0.75 / 1M tokens | $0.075 / 1M tokens | $4.50 / 1M tokens | Resumen, clasificación, extracción, cambios pequeños y exploración inicial. |

Estos precios son de API call. El acceso de Codex por plan de ChatGPT se comprueba en el Help Center de OpenAI, por ejemplo en Using Codex with your ChatGPT plan. Un equipo puede usar ambos productos, pero debe separar presupuesto, límites y fuente de verdad.

También hay que vigilar sesiones muy largas. Las páginas de modelo y precios indican que entradas GPT-5.5 extremadamente largas pueden entrar en reglas de full-session pricing más altas. Si vas a enviar repositorios grandes, logs o historiales extensos a la API, no estimes coste solo con la fila estándar.

Qué modelo elegir

GPT-5.5 es el primer candidato cuando aparece en Codex y la tarea es difícil. Si el fallo cuesta horas, rompe tests o exige criterio de arquitectura, el diferencial de modelo suele valer más que el ahorro. Es el caso de cambios en varios módulos, bugs de causa profunda, migraciones delicadas, UI con muchas restricciones, revisión de seguridad o trabajo donde el agente tiene que planificar y verificar.

GPT-5.4 es el primer fallback si GPT-5.5 no aparece, se rechaza o no llegó a tu cuenta. Es el sustituto que mantiene una calidad alta para trabajo real sin convertir una limitación de acceso en bloqueo operativo.

GPT-5.4 mini debe quedar para trabajo ligero: resumir archivos, clasificar issues, generar helpers pequeños, preparar una investigación inicial o ajustar texto de bajo riesgo. Si abriste Codex para una tarea difícil de ingeniería, mini no debería ser el valor predeterminado de calidad.

| Situación | Elección |

|---|---|

| GPT-5.5 aparece con ChatGPT sign-in y la tarea es compleja | gpt-5.5 |

| GPT-5.5 no aparece o se rechaza en Codex | gpt-5.4 |

| La tarea es pequeña, reversible y sensible al coste | gpt-5.4-mini |

| Necesitas una llamada de API, no una sesión Codex | Usa el model ID y la página de API pricing |

| Estás usando Codex con API key | No asumas soporte de GPT-5.5; confirma la documentación y prepara fallback |

Lista de comprobación

Antes de cambiar el modelo estándar de un equipo, revisa esto:

- Separa Codex, OpenAI API y acceso por plan de ChatGPT.

- En Codex, confirma si la sesión usa ChatGPT sign-in o API-key authentication.

- Revisa si el selector muestra GPT-5.5.

- En CLI, prueba

codex -m gpt-5.5. - En configuración, usa

model = "gpt-5.5"solo en una ruta compatible. - Si GPT-5.5 no aparece o se rechaza, vuelve a

gpt-5.4. - Usa la tabla de API pricing solo para decisiones de API.

- Antes de actualizar documentación interna, vuelve a revisar la documentación de Codex y la página de precios.

En resumen: GPT-5.5 es la primera opción para Codex cuando tu ruta lo muestra y la tarea lo justifica. Si no aparece, gpt-5.4 es la alternativa segura. Que gpt-5.5 exista en OpenAI API no prueba soporte en Codex con API key.

Preguntas frecuentes

¿Se puede usar GPT-5.5 en Codex?

Sí, si aparece en tu ruta de Codex. La documentación de Codex indica disponibilidad con ChatGPT sign-in y recomienda empezar con GPT-5.5 cuando esté en el selector para muchas tareas de Codex.

¿Cuál es el comando de CLI para GPT-5.5?

El comando es codex -m gpt-5.5. Si quieres fijarlo en configuración, usa model = "gpt-5.5". Si se rechaza, revisa autenticación y rollout antes de cambiar nombres.

¿Puedo usar GPT-5.5 en Codex con una API key de OpenAI?

No lo asumas. La documentación de Codex separa ChatGPT sign-in de API-key authentication y actualmente no presenta GPT-5.5 como disponible en la ruta de API key de Codex.

¿OpenAI API acepta gpt-5.5?

Sí. La documentación de OpenAI API lista gpt-5.5 y su página de modelo muestra endpoints como Chat Completions y Responses. Eso pertenece a API, no al contrato de Codex con API key.

¿Qué uso si GPT-5.5 no aparece?

Usa primero gpt-5.4. gpt-5.4-mini queda para tareas ligeras, baratas y reversibles.

¿Puedo forzar GPT-5.5 en Codex Cloud?

No conviene asumirlo desde un flag local. La documentación de Codex indica que el modelo predeterminado de Cloud no puede ser cambiado por el usuario actualmente.

¿El plan de ChatGPT y la facturación de API son lo mismo?

No. El acceso de Codex con tu plan se comprueba en Help Center. El coste por llamada se comprueba en API pricing.

¿Debo pasar todo mi flujo de Codex a GPT-5.5?

No de golpe. Pruébalo primero en tareas complejas, mide calidad, velocidad, comportamiento de herramientas y recuperación ante fallos, y conserva gpt-5.4 como fallback operativo.