Una solicitud de jailbreak para el generador de imágenes de Grok no es un flujo normal de prompts. Casi siempre mezcla varias tareas distintas: empujar una imagen bloqueada, encontrar un control de Grok Imagine o Spicy Mode que no aparece, integrar la generación de imágenes de xAI en un producto, evaluar seguridad o responder a una imagen dañina que ya existe. Si no separas esas tareas desde el principio, una duda legítima de acceso puede acabar convertida en un intento de desactivar protecciones.

Clasifica primero el objetivo:

| Objetivo real | Siguiente paso más seguro |

|---|---|

| Hacer pasar una solicitud de imagen bloqueada | Detente. No uses listas de prompts, wrappers ni supuestos casos de éxito como instrucciones. |

| Encontrar un modo Grok Imagine o Spicy Mode que no aparece | Revisa la app oficial, la cuenta, la región, los ajustes de contenido, la edad y el reconocimiento de la suscripción. |

| Crear un producto con generación de imágenes de xAI | Usa la API documentada con revisión de contenido, registros, reportes, eliminación y límites de consentimiento. |

| Probar el comportamiento de seguridad | Hazlo solo con autorización, alcance, registros, ejemplos no dañinos y reglas de cierre. |

| Responder a una salida dañina | Conserva la mínima evidencia necesaria, usa la ruta de reporte y evita regenerar o redistribuir el material. |

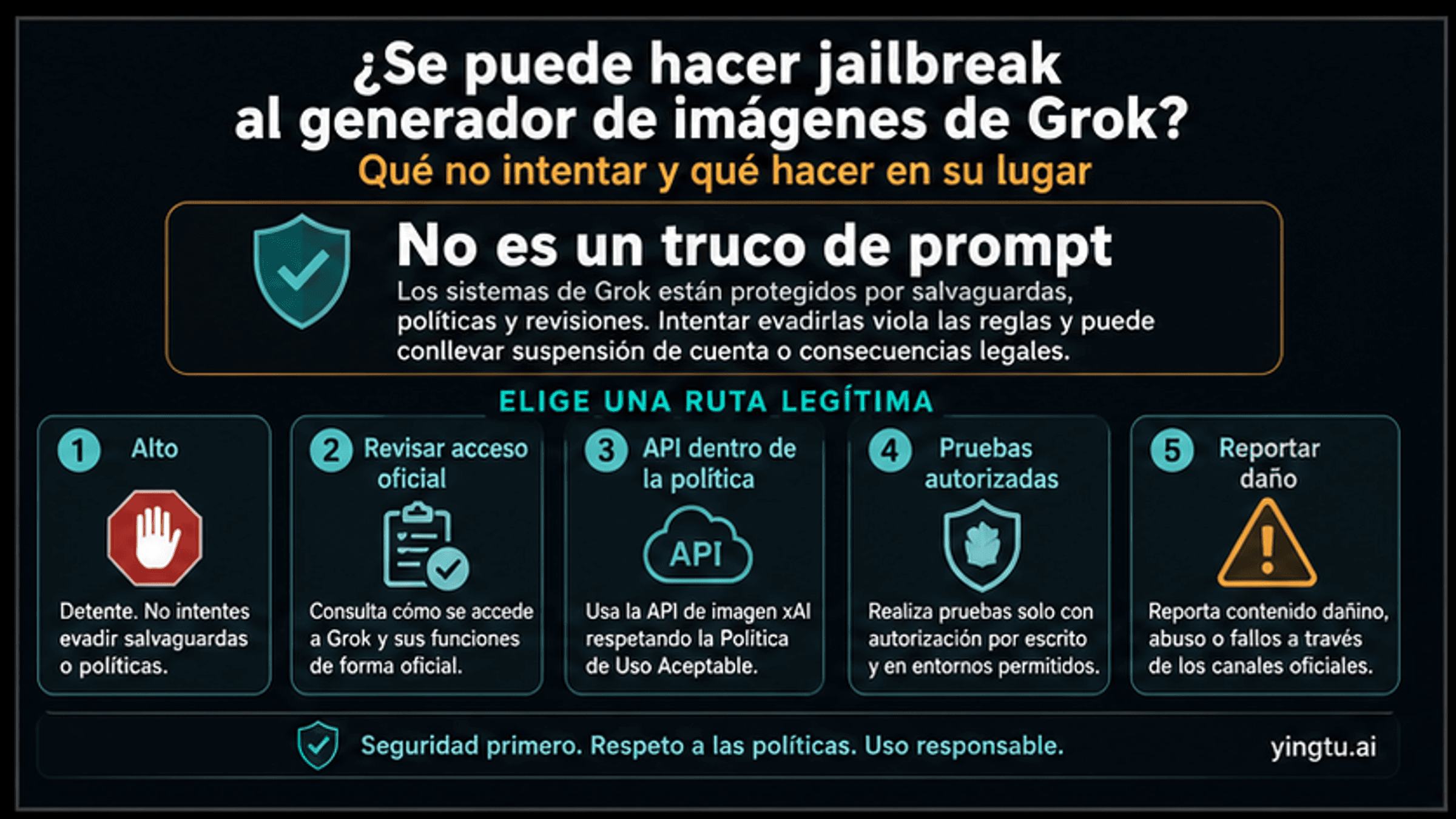

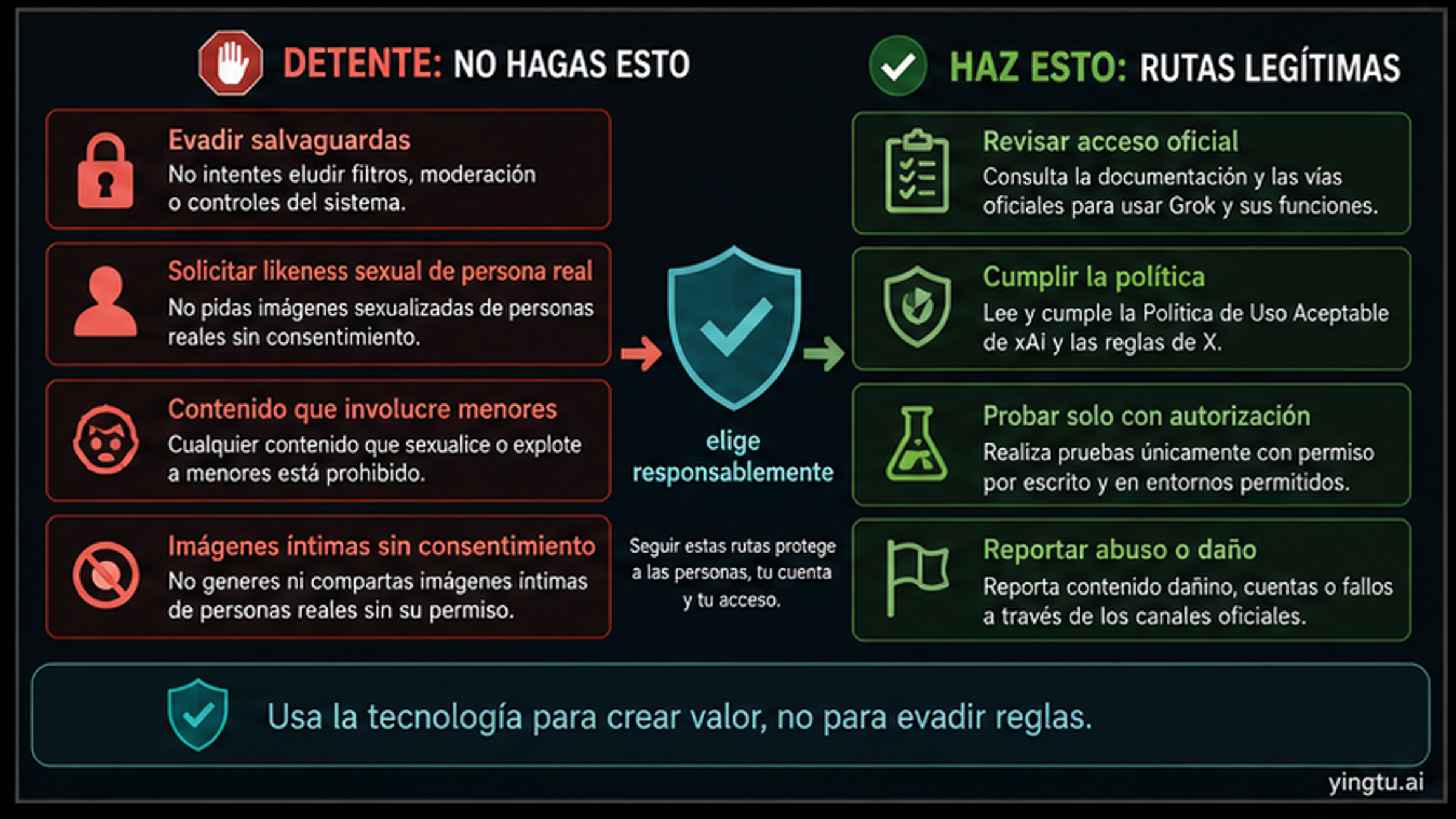

Los casos de detención son directos: no intentes evadir salvaguardas, no generes imágenes sexualizadas de personas reales, no involucres menores ni personas de edad ambigua, no crees ni difundas imágenes íntimas no consentidas y no conviertas hilos de Reddit o videos cortos en un camino de producción. Si tu problema real es que Spicy Mode no aparece, la guía correcta es Grok Imagine Spicy Mode availability guide. Si necesitas el contexto amplio sobre contenido adulto, reglas de xAI/X y controversia pública, lee Grok xAI NSFW image generation policy analysis. La ruta de jailbreak es más estrecha: debe detenerse o reclasificarse hacia una opción legítima.

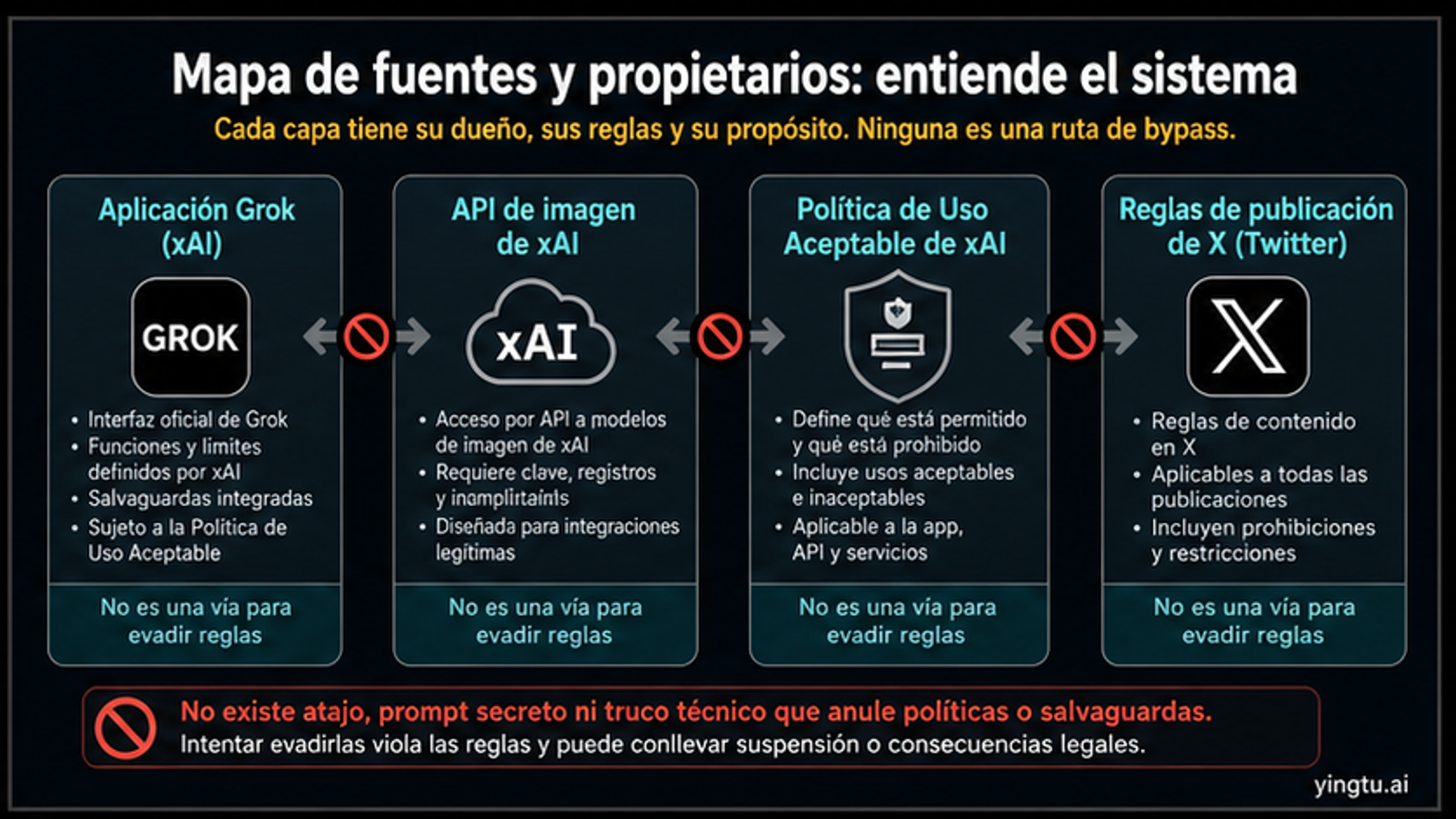

Separa primero las cuatro fuentes de reglas

La palabra Grok puede ocultar varias superficies: la app de consumidor, la experiencia dentro de X, la API para desarrolladores y las reglas de publicación. Mezclarlas produce conclusiones peligrosas: pensar que una API prueba acceso a Spicy Mode, o que una regla de publicación de X autoriza cualquier generación en Grok.

| Fuente | Qué puede demostrar | Qué no puede demostrar |

|---|---|---|

| App de Grok o X | Lo que ve la cuenta de consumidor iniciada, incluidos controles de Grok Imagine o Spicy Mode cuando aparecen | Un derecho universal, un modo oculto o equivalencia con la API |

| Documentación de la API de imágenes de xAI | Que xAI documenta generación y edición de imágenes para desarrolladores, con formatos, modelos, salidas y manejo de respuestas | Acceso a Spicy Mode del consumidor o permiso para evitar moderación |

| Acceptable Use Policy de xAI | Los límites de uso para consumidores, desarrolladores y empresas: legalidad, seguridad infantil, imagen personal, privacidad, publicidad y salvaguardas | Una lista de frases permitidas o una forma de convertir lo prohibido en aceptable |

| X Adult Content Policy | Cómo se etiqueta y publica contenido adulto consensuado en X | Permiso para que Grok genere ese contenido ni para ignorar reglas de xAI |

Al 9 de mayo de 2026, la documentación de capacidades de imagen de xAI demuestra una ruta de imagen para desarrolladores y también indica que las imágenes generadas pasan por revisión de política de contenido. Eso importa para equipos: una API puede hacer el flujo más programable, pero no elimina la capa de seguridad.

La Acceptable Use Policy de xAI es la frontera más fuerte. Prohíbe usos ilegales, violaciones de privacidad o derechos de publicidad, sexualización o explotación infantil, representaciones pornográficas de la apariencia de una persona y evasión de salvaguardas. La Adult Content Policy de X es más estrecha: gobierna material adulto consensuado y etiquetado en X. Una regla de publicación no es permiso de generación.

Qué no debes intentar

No trates una solicitud bloqueada como un rompecabezas. Puede estar bloqueada porque el contenido no está permitido, porque el sistema no puede clasificarla con seguridad, porque la cuenta no tiene la función visible o porque la propia solicitud intenta desactivar una regla. Copiar cadenas de varios turnos, roles, wrappers o promesas de “sin filtro” no hace que ninguna de esas situaciones sea más segura.

| Caso de detención | Por qué detiene el flujo | Mejor acción |

|---|---|---|

| Evasión de salvaguardas | La política de xAI exige respetar protecciones salvo pruebas autorizadas | Detenerse o pasar a un proceso de evaluación autorizado |

| Imagen sexualizada de una persona real | Se combinan consentimiento, privacidad, publicidad, acoso y riesgo de NCII | No generar, editar, publicar ni redistribuir |

| Menores o edad ambigua | La seguridad infantil y la ley crean una frontera dura | Detenerse de inmediato y reportar si ya existe material |

| Imagen íntima no consentida | Es un problema de daño personal, legal y de plataforma, no de prompt engineering | Guardar solo evidencia necesaria para reportar; no recrear |

| Rutas “sin filtro”, “sin censura” o “ilimitadas” | Suelen indicar intento de derrotar controles o uso de servicios no confiables | No usarlas como instrucciones personales ni de producto |

Esta sección es deliberadamente no operativa. La investigación de seguridad y los reportes de abuso pueden hablar de intentos de evasión, pero un artículo público no debe reproducir secuencias, fragmentos, ejemplos ni recetas. La acción útil es clasificar la meta y elegir una ruta legítima.

Rutas legítimas que siguen disponibles

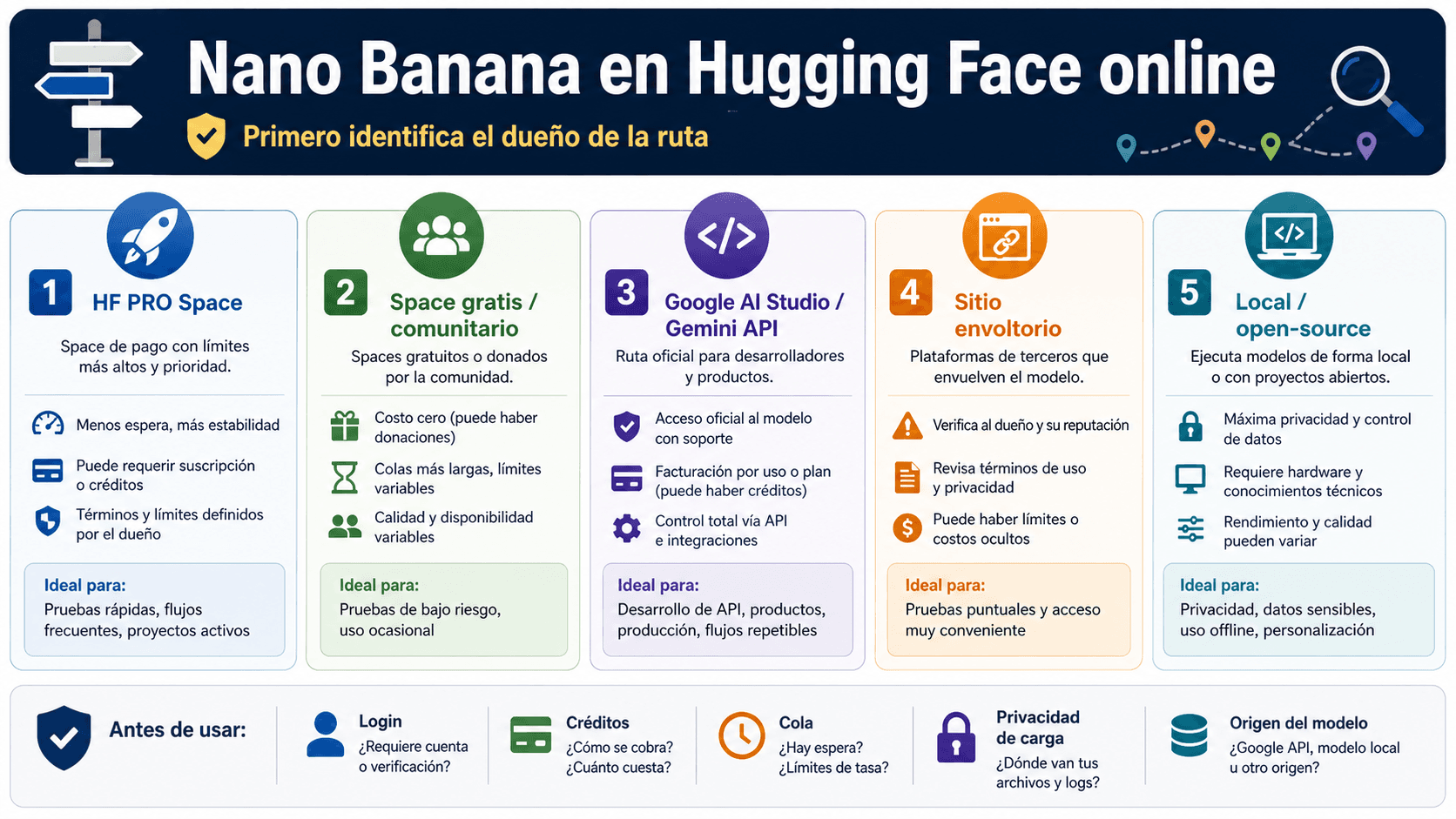

Rechazar el jailbreak no deja a todos los lectores con la misma respuesta. Depende del trabajo real.

Si el trabajo es acceso de consumidor, vuelve a la superficie oficial de Grok o X asociada a tu cuenta. Revisa app, sesión, ajustes de contenido, edad, región, suscripción y despliegue de la función. Que el control no aparezca no justifica clientes modificados, cuentas compartidas, vendedores de acceso, cookies, códigos de un solo uso ni capturas de facturación enviadas a terceros.

Si el trabajo es desarrollo, trata la API de imágenes de xAI como una superficie moderada. El producto necesita registros, revisión de contenido, reportes de usuario, eliminación, límites de consentimiento y una estrategia de rechazo. Un flujo donde el usuario sube la foto de otra persona y pide una transformación sexualizada no es una función pendiente de una mejor frase. Es un patrón de daño previsible.

Si el trabajo es prueba de seguridad, la diferencia es autorización. Un equipo de seguridad, trust and safety, evaluadores de modelo o un red team contratado puede probar comportamiento restringido dentro de un alcance definido, con registros, ejemplos no dañinos, reglas de divulgación y criterios de cierre. Una publicación social con recetas no equivale a una prueba autorizada.

Si el trabajo es responder a contenido dañino, no lo regeneres ni lo amplifiques. Guarda la mínima evidencia necesaria, usa la ruta de reporte de la plataforma y sigue procesos legales u organizativos cuando pueda haber menores, NCII, acoso, chantaje o deepfake de una persona real.

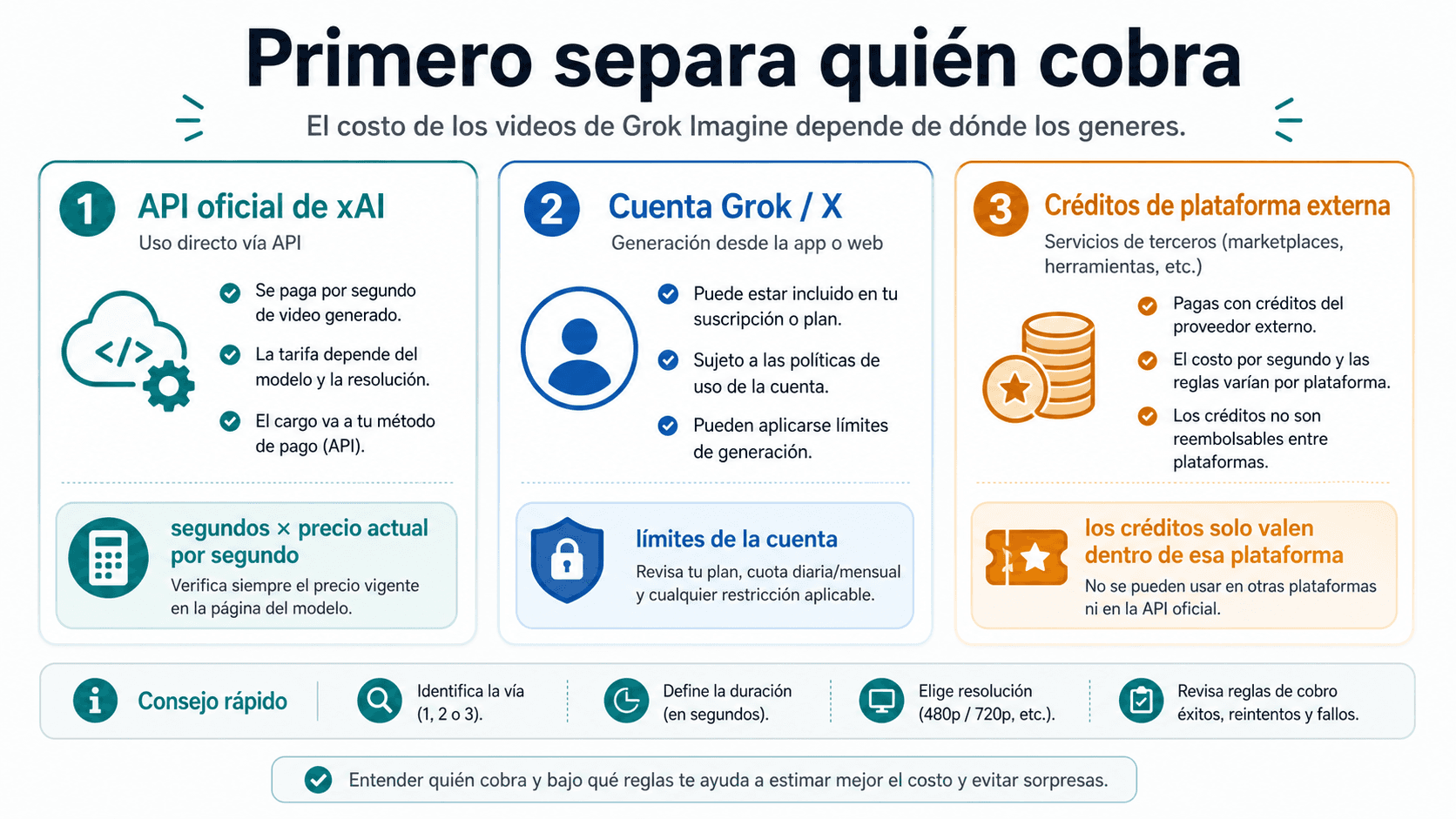

La API no es un atajo de moderación

La API de imágenes de xAI puede parecer más controlable que la app. Precisamente por eso se malinterpreta como un atajo. En realidad es un contrato para desarrolladores: formatos de solicitud, modelos, salidas, facturación e integración. No cancela la política de uso aceptable.

| Pregunta sobre la API | Respuesta segura |

|---|---|

| ¿xAI documenta generación de imágenes? | Sí. xAI documenta generación y edición de imágenes. |

| ¿Puedo mover a la API lo que la app bloquea? | No como regla. La API sigue sujeta a política y manejo de respuestas de moderación. |

| ¿Una API key demuestra acceso a Spicy Mode? | No. La cuenta de consumidor y la API son superficies distintas. |

| ¿La API sirve para editar sexualmente personas reales? | No debería usarse para eso. Consentimiento, imagen, privacidad, publicidad, acoso y NCII detienen la ruta. |

| ¿Puedo copiar precios, límites y modelos de posts antiguos? | No. Modelos, precios, planes, límites y disponibilidad deben verificarse en fuentes primarias el día que importan. |

Un equipo de producto no debería empezar por “¿podemos hacer que Grok lo genere?”. Empieza por el caso de uso, los archivos que sube el usuario, identidad y consentimiento, región, revisión legal, reporte, eliminación y explicación de rechazo. Si el valor depende de desactivar protecciones, el proyecto debe detenerse en diseño.

El riesgo ya es público

El riesgo alrededor de imágenes de Grok no es hipotético. El 16 de enero de 2026, el fiscal general de California envió a xAI una cease-and-desist letter por presuntas imágenes íntimas no consentidas tipo deepfake y material de abuso sexual infantil relacionado con Grok. Dos días antes, esa oficina anunció una investigación sobre Grok sexual AI imagery.

En el Reino Unido, Ofcom abrió una investigación formal sobre X y Grok sexualised imagery el 12 de enero de 2026. Registros posteriores señalan que X informó medidas de mitigación, pero eso debe describirse como acciones fechadas y estado de investigación, no como conclusión legal final.

La conclusión práctica es más simple: NCII, seguridad infantil, imagen sexualizada de personas reales, reporte de plataforma y retirada rápida son categorías de riesgo actuales. Quien llegó buscando un jailbreak debe ver esos límites antes que cualquier trasfondo de funciones.

Cuándo el problema es otro tema de Grok

No todas las dudas sobre imágenes de Grok pertenecen al marco de jailbreak. Muchas deben reclasificarse.

| Problema real | Mejor dueño |

|---|---|

| Spicy Mode o Grok Imagine no aparece | Grok Imagine Spicy Mode availability guide |

| La duda es política adulta o riesgo regulatorio | Grok xAI NSFW image generation policy analysis |

| La duda es generación para desarrolladores | Documentación de xAI image API más revisión interna de seguridad y cumplimiento |

| Ya existe una salida dañina | Reporte, preservación de evidencia y escalamiento legal u organizativo |

| Se necesitan precios, límites, regiones o modelos actuales | Páginas oficiales de pago, consola, documentación o política en la fecha de decisión |

Esta separación evita consejos duplicados y engañosos. La guía de acceso ayuda con visibilidad legítima. La guía de política explica el contexto amplio. La decisión sobre jailbreak es más estrecha: no seguir una ruta de evasión cuando el método o el objetivo son inseguros.

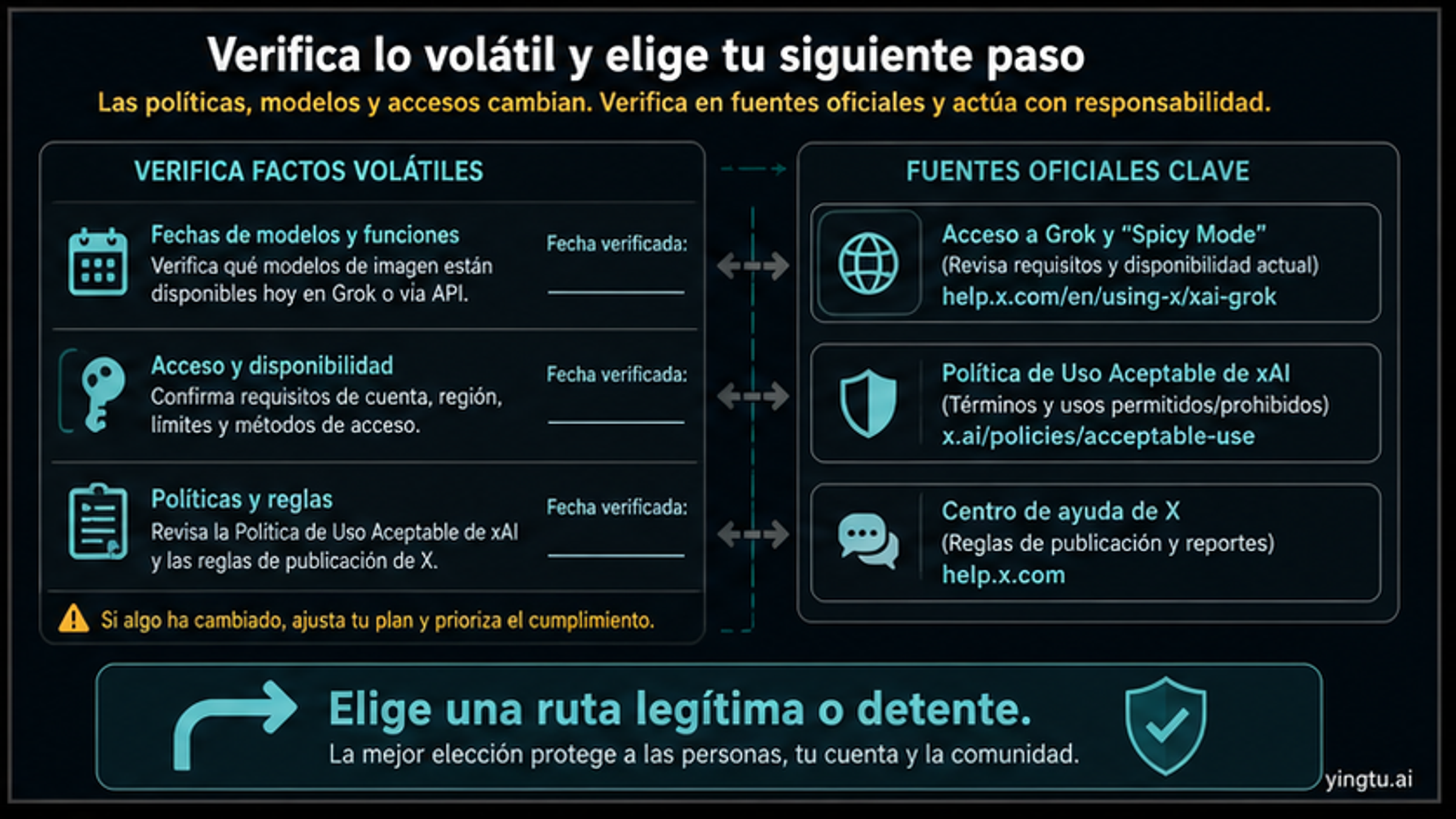

Qué cambia y qué no debería cambiar

Alrededor de Grok image generation pueden cambiar rápido los nombres de modelos, precios de API, tamaños de salida, URL temporales, visibilidad de funciones de consumidor, paquetes de suscripción, regiones, controles de cuenta, texto de moderación y estado regulatorio. Si esos datos afectan una decisión, consulta una fuente primaria ese mismo día. Si el número no cambia la acción, es mejor omitirlo.

La frontera central cambia menos. Desactivar salvaguardas no es un flujo normal de consumidor. Personas reales sexualizadas, menores, imágenes íntimas no consentidas y usos ilegales son casos de detención. Las reglas de contenido adulto de X no son permiso de generación en Grok. La API de xAI es una ruta de desarrollador, no una brecha.

Dentro de una organización, convierte esto en checklist: quién sube el material, a quién afecta la salida, si hay consentimiento, cómo reporta el usuario, cómo se elimina, en qué regiones se ofrece, quién vigila cambios de política y qué dice el producto cuando rechaza. Si la respuesta honesta depende de evadir protecciones, la idea debe detenerse.

Preguntas frecuentes

¿Existe un jailbreak seguro para imágenes de Grok?

No hay una ruta segura para uso público. Trátalo como una señal de límite y elige acceso oficial, API conforme a política, prueba autorizada, reporte o detención.

¿La API de xAI evita la moderación de Grok Imagine?

No. xAI documenta generación y edición de imágenes, pero la API sigue sujeta a política y respuestas de moderación. Es un contrato de desarrollador, no una forma de cancelar controles.

Si X permite contenido adulto, ¿Grok puede generarlo?

No necesariamente. Las reglas de X tratan material adulto consensuado y etiquetado dentro de X. La generación en Grok y el uso de servicios xAI tienen límites propios, especialmente para no consentimiento, menores, personas reales, usos ilegales y salvaguardas.

¿Qué hago si Spicy Mode no aparece?

Revisa la ruta oficial: app de Grok o X, cuenta, ajustes de contenido, edad, región, suscripción y despliegue. No conviertas la ausencia del control en motivo para usar clientes modificados, cuentas compartidas o vendedores.

¿Pueden los investigadores probar las defensas de imágenes de Grok?

Solo con alcance autorizado. Una prueba responsable requiere permiso, registros, ejemplos no dañinos, reglas de divulgación y límites claros. Las recetas públicas no son testing autorizado.

¿Qué se debe reportar?

Reporta sospechas de NCII, sexualización de menores, suplantación, acoso o abuso de la imagen de una persona real por la vía de la plataforma o la vía legal correspondiente. Conserva solo evidencia necesaria y evita redistribuir el contenido.