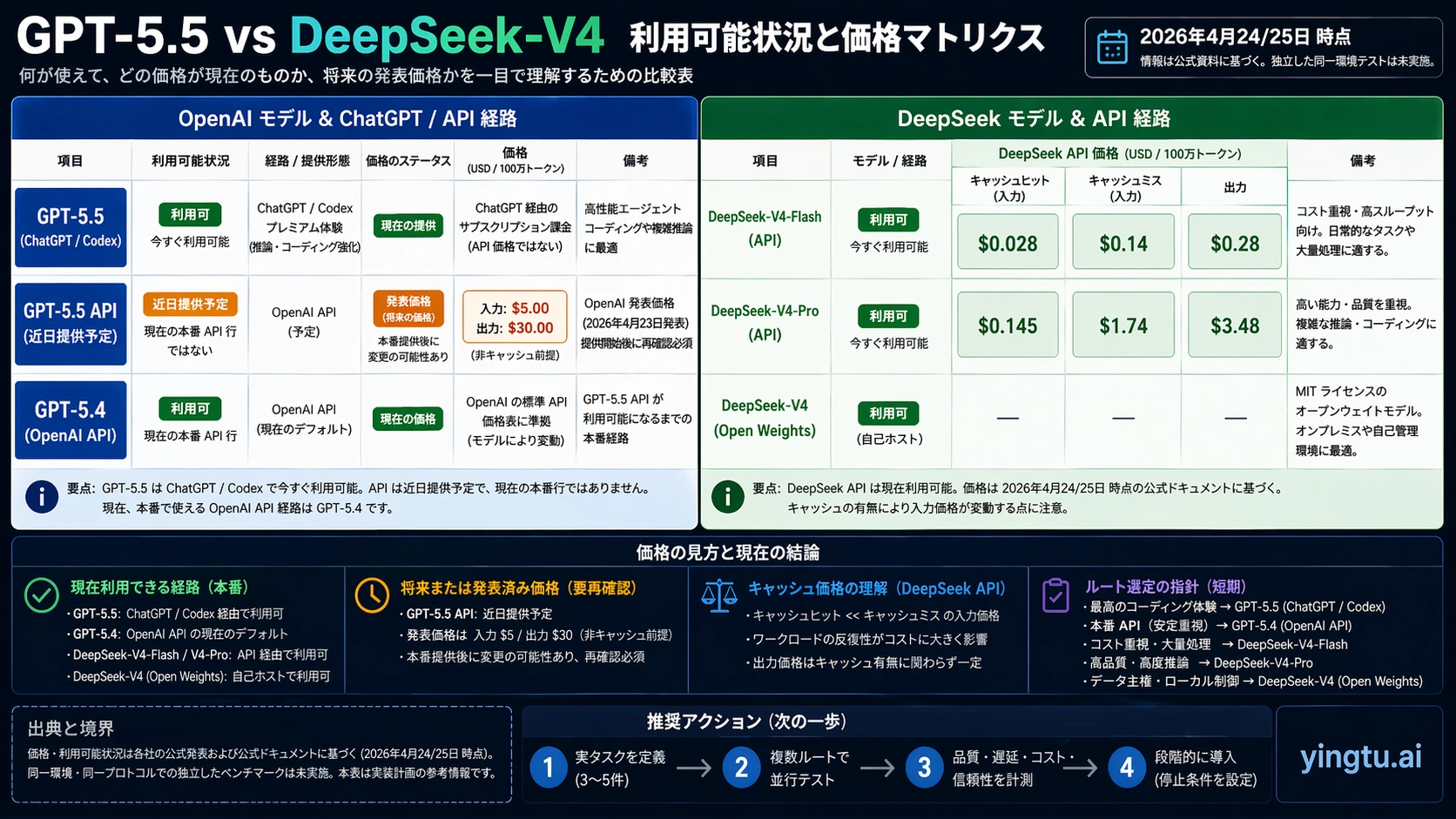

2026年4月24/25日時点では、GPT-5.5 と DeepSeek-V4 は同じ種類の API 選択肢ではありません。ChatGPT や Codex の中で高度なコーディング、エージェント実行、推論を行うなら GPT-5.5 を先に試します。すでに OpenAI API で本番運用するなら GPT-5.4 を現在の基準にします。API コスト、1M コンテキスト、オープンウェイト、またはセルフホストを重視するなら DeepSeek-V4-Flash または DeepSeek-V4-Pro を先に評価します。

| ルート | 先に試すべき場面 | 待つべき場面 |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | OpenAI 製品面で最も強いコーディング、Agent、推論体験が必要。 | 今日から通常の production API として使う必要がある。 |

| GPT-5.4 in OpenAI API | OpenAI API ワークロードを今出荷しており、安定した現行モデルが必要。 | 次世代ルートの評価だけで、GPT-5.5 API を待てる。 |

| DeepSeek-V4-Flash / V4-Pro API | 低コスト、長いコンテキスト、DeepSeek 側の能力検証が必要。 | OpenAI ネイティブのツール、企業サポート、既存品質基準が優先。 |

| DeepSeek-V4 オープンウェイト | ローカル制御、MIT ライセンス、プライバシー、自社推論実験が必要。 | GPU、配信、監視、MLOps を持ちたくない。 |

公開ベンチマークは、どのテストを先に設計するかを決める材料です。万能な勝者ラベルではありません。本番トラフィックを置き換える前に、同じ実タスクを候補ルートへ流し、品質、レイテンシ、コスト、tool の挙動、エラー復旧、データ境界を測定してください。

まず勝者ではなくルートを選ぶ

日本語の情報面では、DeepSeek-V4 の「高いコスト効率」「オープンモデル」「100万コンテキスト」が大きく扱われやすい一方で、GPT-5.5 の ChatGPT/Codex 経路と OpenAI API 経路の違いは見落とされがちです。開発者に必要なのは、モデル名の順位ではなく、今どの経路をテストでき、どの経路を本番の基準にできるかです。

GPT-5.5 は、現時点では OpenAI 製品面と一体で評価するべきモデルです。Codex、ChatGPT、アカウント、エディタやターミナルの文脈、レビューの流れまで含めて価値が出ます。DeepSeek-V4 は別の強みを持ちます。Flash/Pro の hosted API、低いトークン価格、1M コンテキスト、オープンウェイト、自社管理の可能性です。この二つを一つの「どちらが賢いか」だけで比べると、API 可用性と運用リスクを読み違えます。

最初の判断は次の表で十分です。

| ワークロード | 最初の候補 | 理由 |

|---|---|---|

| Codex 内での修正、リポジトリ調査、Agent 型の作業 | GPT-5.5 | モデルだけでなく OpenAI の作業環境ごと評価できる。 |

| 既存の OpenAI API 本番アプリ | GPT-5.4 | GPT-5.5 API が live docs に出るまでの現行基準。 |

| 大量の抽出、分類、要約、前処理 | DeepSeek-V4-Flash | 自動検証と組み合わせると accepted output cost を下げやすい。 |

| 難しい推論、コード、長文合成 | DeepSeek-V4-Pro | Flash より品質評価に向き、価格差もまだ大きい。 |

| ローカル管理、データ境界、自社推論 | DeepSeek-V4 オープンウェイト | hosted API ではなくインフラ選択として評価できる。 |

日本語読者にとって大事なのは、DeepSeek-V4 を一つの行にまとめないことです。Flash、Pro、オープンウェイトでは、コストも品質も運用責任も違います。同じように、GPT-5.5 も ChatGPT/Codex 経路と API 経路を分ける必要があります。

利用可能性と価格:今使えるものを分ける

OpenAI の GPT-5.5 発表は、GPT-5.5 を ChatGPT と Codex 向けの新しいプレミアムモデルとして説明しています。API 価格も予告されていますが、OpenAI の latest model guideでは、2026年4月24/25日時点で GPT-5.4 が現在の OpenAI API ルートとして残っています。したがって、GPT-5.5 は今すぐ OpenAI ネイティブ作業で評価できますが、通常の production API ルートとして扱うのは早すぎます。

DeepSeek 側はより直接的です。DeepSeek API pricingには deepseek-v4-flash と deepseek-v4-pro が並んでいます。OpenAI 互換、Anthropic 互換の endpoint も用意されているため、既存クライアントを完全に書き換えずに小さな比較テストを始めやすい構造です。ただし deepseek-chat や deepseek-reasoner のような alias は、将来の変更に備えて production では明示的な V4 モデル ID に寄せる方が安全です。

| ルート | 現在の状態 | 2026年4月24/25日時点の価格シグナル |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | OpenAI の該当製品面で利用可能。 | 製品サブスクリプションやワークスペース経路。通常 API 課金ではない。 |

| GPT-5.5 API | coming soon として予告。 | 予告価格:入力 $5、出力 $30 / 1M tokens。 |

| GPT-5.5 Pro API | coming soon として予告。 | 予告価格:入力 $30、出力 $180 / 1M tokens。 |

| GPT-5.4 API | 現在の OpenAI API fallback。 | 本番前に OpenAI の現在の価格と docs を確認。 |

| DeepSeek-V4-Flash API | DeepSeek API docs に掲載。 | cache hit $0.028、cache miss $0.14、output $0.28 / 1M tokens。 |

| DeepSeek-V4-Pro API | DeepSeek API docs に掲載。 | cache hit $0.145、cache miss $1.74、output $3.48 / 1M tokens。 |

| DeepSeek-V4 open weights | 公式モデルカードで確認可能。 | トークン課金ではなく GPU、配信、監視、運用人件費になる。 |

価格差は非常に大きいですが、それだけで production の答えは出ません。DeepSeek-V4-Flash は大量処理と自動検証に向きます。DeepSeek-V4-Pro は難しい推論やコードで再試行を減らせるかを見るモデルです。GPT-5.5 は高く見えても、Codex 内でレビュー時間や失敗回数を減らすなら、作業全体のコストは下がる可能性があります。

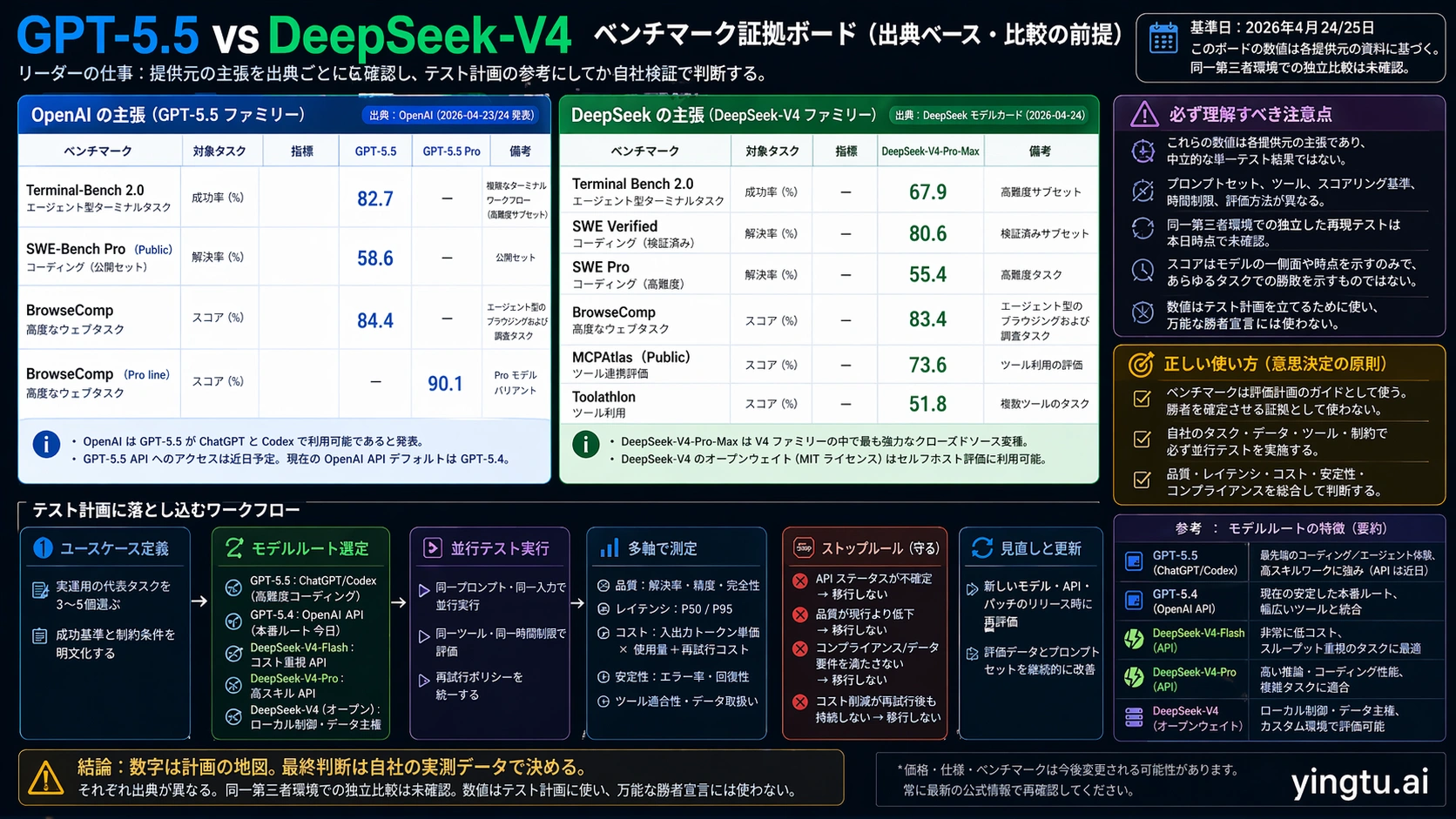

ベンチマークは出典付きで読む

OpenAI は GPT-5.5 について、Terminal-Bench 2.0、SWE-Bench Pro public、BrowseComp などの coding、browsing、agentic work のスコアを発表しています。DeepSeek は DeepSeek-V4-Pro model cardで、DeepSeek-V4-Pro-Max の Terminal-Bench 2.0、SWE Verified、SWE Pro、BrowseComp、MCPAtlas Public、Toolathlon などを示しています。

ここで重要なのは、出典が違うことです。OpenAI の行と DeepSeek の行は、同じ中立機関が同じ環境で同時に走らせた総合ランキングではありません。ベンチマークをそのまま勝敗表にすると、ツール環境、モード、コンテキスト長、採点ルールの違いを消してしまいます。

| 領域 | 公開値から読めること | 自社で確認すべきこと |

|---|---|---|

| コード | GPT-5.5 は OpenAI 側の coding/terminal 信号が強い。DeepSeek-V4-Pro もソフトウェア系で候補に入る。 | multi-file patch、テスト修復、依存関係、レビュー負荷。 |

| tool / agent | 両方に tool や browsing の証拠があるが、環境は同一ではない。 | tool arguments、再試行、部分失敗後の復旧、JSON validity。 |

| 長いコンテキスト | DeepSeek-V4 は 1M context を強く打ち出す。GPT-5.5 API も 1M context を予告。 | 後半情報の回収、矛盾指示、長い prompt での実コスト。 |

| 運用 | 公開値は rate limit、p95 latency、監査要件を見せにくい。 | latency、timeout、拒否率、ログ、データ境界。 |

本番判断では accepted output cost を見ます。つまり、検証に通った出力だけにかかった総コストです。安いモデルでも、再試行と人間の修正が多ければ高くなります。

DeepSeek-V4 は Flash、Pro、オープンウェイトで分ける

DeepSeek-V4-Flash は、量が多く、失敗を自動検出できる処理に向きます。抽出、分類、短い要約、RAG 前処理、ルーティング、フォーマット変換などです。低価格なので、二段階検証や候補生成を足しても accepted output cost を抑えやすくなります。

DeepSeek-V4-Pro は、Flash では薄くなる可能性がある難しい処理に向きます。コード変更、長文合成、複数 tool の計画、複雑な推論、エージェント的な復旧です。Pro は Flash より高いですが、失敗回数と手直しを減らすなら総額は安くなる場合があります。

オープンウェイト は別の判断です。MIT ライセンスや公式モデルカードは大きな意味を持ちますが、hosted token billing が消える代わりに GPU、serving、batching、security、monitoring、更新、障害対応が必要になります。プライバシー、データローカリティ、カスタム推論が主要目的でないなら、まず hosted API で品質を見た方が速いです。

1M コンテキストも慎重に見ます。長いコンテキストを入れるだけでは不十分です。無関係な情報、後半に置いた重要条件、矛盾する要件、最終回答の引用チェックを入れてください。20K tokens でよく見えるモデルが、800K tokens でも同じとは限りません。

ワークフロー別の推奨

Codex や ChatGPT 内で高難度の coding、repo repair、Agent debug をするなら GPT-5.5 を先に試します。ここではモデル単体ではなく、OpenAI の作業面、review flow、権限、エディタ/ターミナル連携まで含めた価値を見ます。

既存の OpenAI API アプリでは、GPT-5.4 を基準にします。将来 GPT-5.5 を差し替えられるよう model routing は抽象化しておくべきですが、公式 API docs に出る前に GPT-5.5 API を本番契約に入れるべきではありません。

大量の API 呼び出しでは、DeepSeek-V4-Flash を先に見ます。重要なのは raw token price ではなく、検証を通った出力の単価です。Flash が format、tool、推論で落ちる部分だけを V4-Pro に上げます。

難しい推論や coding を API で比較するなら、今は DeepSeek-V4-Pro と GPT-5.4 API を並べます。GPT-5.5 API が公開されたら、同じタスクと同じ採点表に追加します。採点は accepted patch、passing tests、valid JSON、tool-call success、人間の review 時間で行うべきです。

データ境界やセルフホストが第一なら、DeepSeek-V4 open weights を小さく試します。ただし、それはモデル評価であると同時にインフラ評価です。運用できないなら、モデルが良くても本番には向きません。

移行前の二重実行プラン

移行テストは小さく始めます。代表的な 3 から 5 個のタスクを選びます。コード修正、長い文書からの回答、構造化抽出、tool call、高頻度 batch などです。各タスクには入力、期待出力、採点表、retry policy、失敗時の重大度、コスト計算方法を先に書きます。

| テストライン | 使う場面 | 測るもの |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | OpenAI 製品面が成果に直結する。 | 完了品質、節約された人手、code review 結果、UI/flow 適合。 |

| GPT-5.4 API | 現在の OpenAI API baseline。 | 既存品質、コスト、latency、tool、structured output、regression。 |

| DeepSeek-V4-Flash API | 大量処理と低コストが重要。 | pass rate、retry rate、format validity、cache behavior、accepted cost。 |

| DeepSeek-V4-Pro API | DeepSeek 側の強い品質を見たい。 | accuracy、reasoning stability、tool behavior、long-context recall。 |

| DeepSeek-V4 open weights | local control が第一条件。 | GPU cost、throughput、latency、security、monitoring。 |

停止ルールも先に決めます。JSON が壊れる、tool arguments が抜ける、後半の証拠を無視する、危険なコード変更を出す、人間の review が増えすぎる場合は移行しません。新しいルートは shadow traffic または低リスク batch で観察し、ログ、監視、監査フィールドがそろってから割合を増やします。

よくある質問

GPT-5.5 は今 API で使えますか?

OpenAI は GPT-5.5 API と価格を予告していますが、2026年4月24/25日時点の API ガイドでは GPT-5.4 が現在の OpenAI API ルートです。GPT-5.5 は ChatGPT/Codex の現在ルート、API は今後のルートとして扱います。

DeepSeek-V4 は Flash と Pro のどちらから試すべきですか?

低リスク、大量処理、自動検証があるなら Flash です。複雑な推論、コード、tool、長いコンテキストなら Pro です。ローカル制御やデータ境界が主目的なら open weights を別プロジェクトとして試します。

DeepSeek-V4 は安いので本番でも有利ですか?

必ずしもそうではありません。安いことはテストする理由になりますが、採用理由ではありません。再試行、手直し、review 時間、下流障害を含めた accepted output cost で見ます。

ベンチマークだけで勝者を決められますか?

決められません。公開値はテスト設計のヒントです。移行判断には、同じ入力、同じ rubric、同じ運用環境での比較が必要です。

いつ判断を更新すべきですか?

GPT-5.5 が OpenAI API docs に出た時、DeepSeek が価格や alias を変えた時、独立した同環境テストが出た時、自社ワークロードが変わった時です。これは固定ランキングではなく、利用可能性、品質、コスト、運用リスクに従うルート選択です。