Grok画像生成のジェイルブレイクは、「うまいプロンプトを探す」話ではありません。その検索の裏にある目的は、拒否された画像を出したい、Grok ImagineやSpicy Modeが見えない、xAIの画像APIを開発に使いたい、安全性を検証したい、またはすでに有害な画像に遭遇した、という別々の問題に分かれます。最初にこの分岐をしないまま投稿や動画の断片を試すと、アクセス確認の問題まで安全回避の問題に変わってしまいます。

まず目的を分類してください。

| 目的 | 安全な次の行動 |

|---|---|

| ブロックされた画像リクエストを通したい | 停止する。投稿、プロンプト集、ラッパーサービスを手順として使わない。 |

| Grok ImagineやSpicy Modeの入口が見えない | 公式アプリ、アカウント、地域、年齢、コンテンツ設定、サブスク認識を確認する。 |

| xAI画像生成をプロダクトに組み込みたい | 文書化されたAPIを使い、ポリシー、ログ、通報、削除、同意確認を設計する。 |

| 安全性を検証したい | 許可、範囲、記録、非有害なテスト素材、停止条件がある環境でのみ行う。 |

| 有害な出力を見つけた | 必要最小限の証拠を残し、通報ルートを使い、再生成や拡散をしない。 |

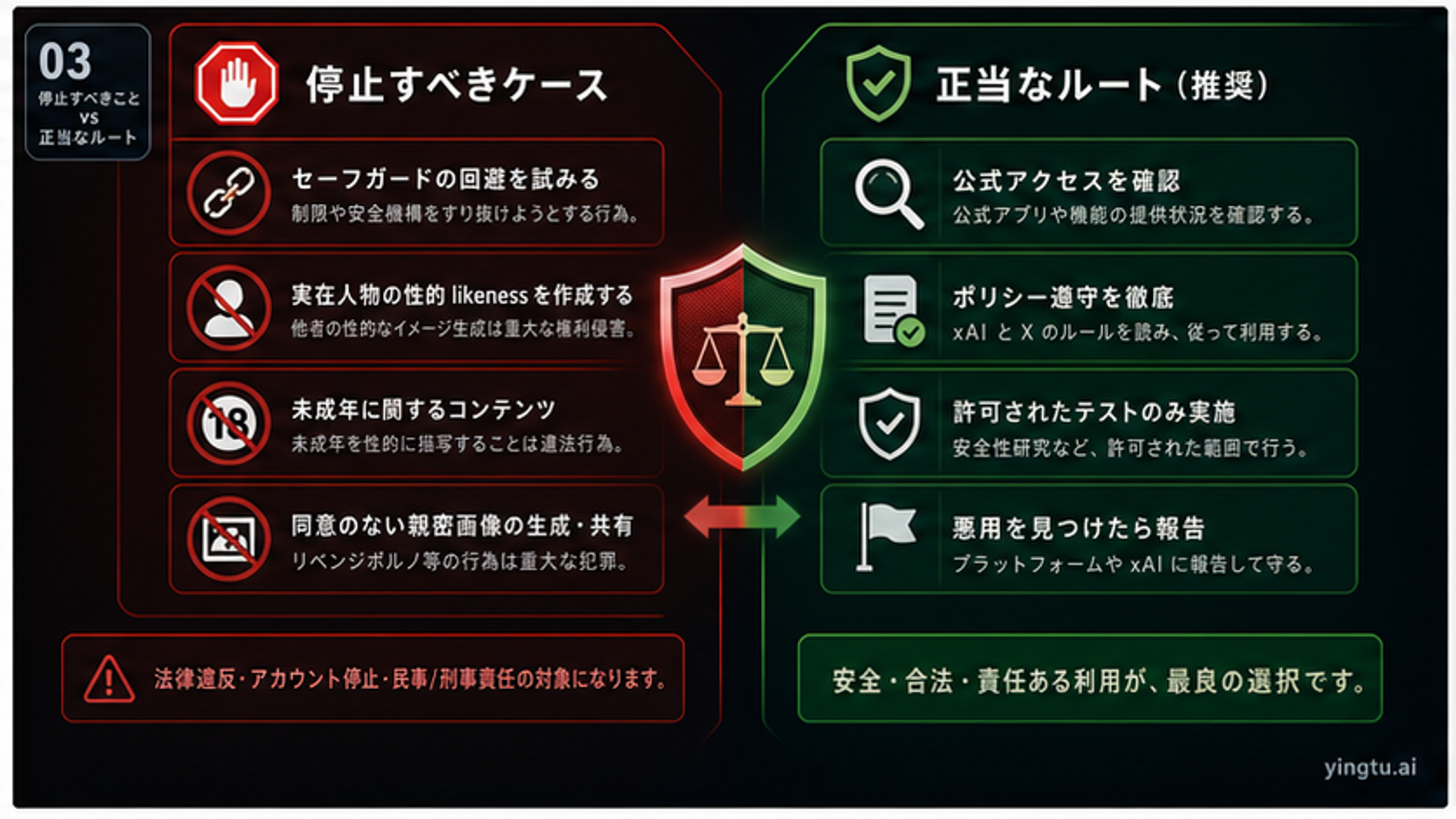

停止すべき場面は明確です。安全機構の無効化を試さない。実在人物を性的に加工しない。未成年者や年齢不明の人物を含めない。同意のない親密画像を作らない、広めない。Redditや短尺動画で見た「できた」という話を制作や業務の経路にしない。入口が見えないだけなら Grok Imagine Spicy Mode availability guide が扱う問題です。より広い成人向け画像ポリシーや規制背景は Grok xAI NSFW image generation policy analysis に渡してください。ジェイルブレイクという危険な入口は、停止または合法ルートに振り分ける対象です。

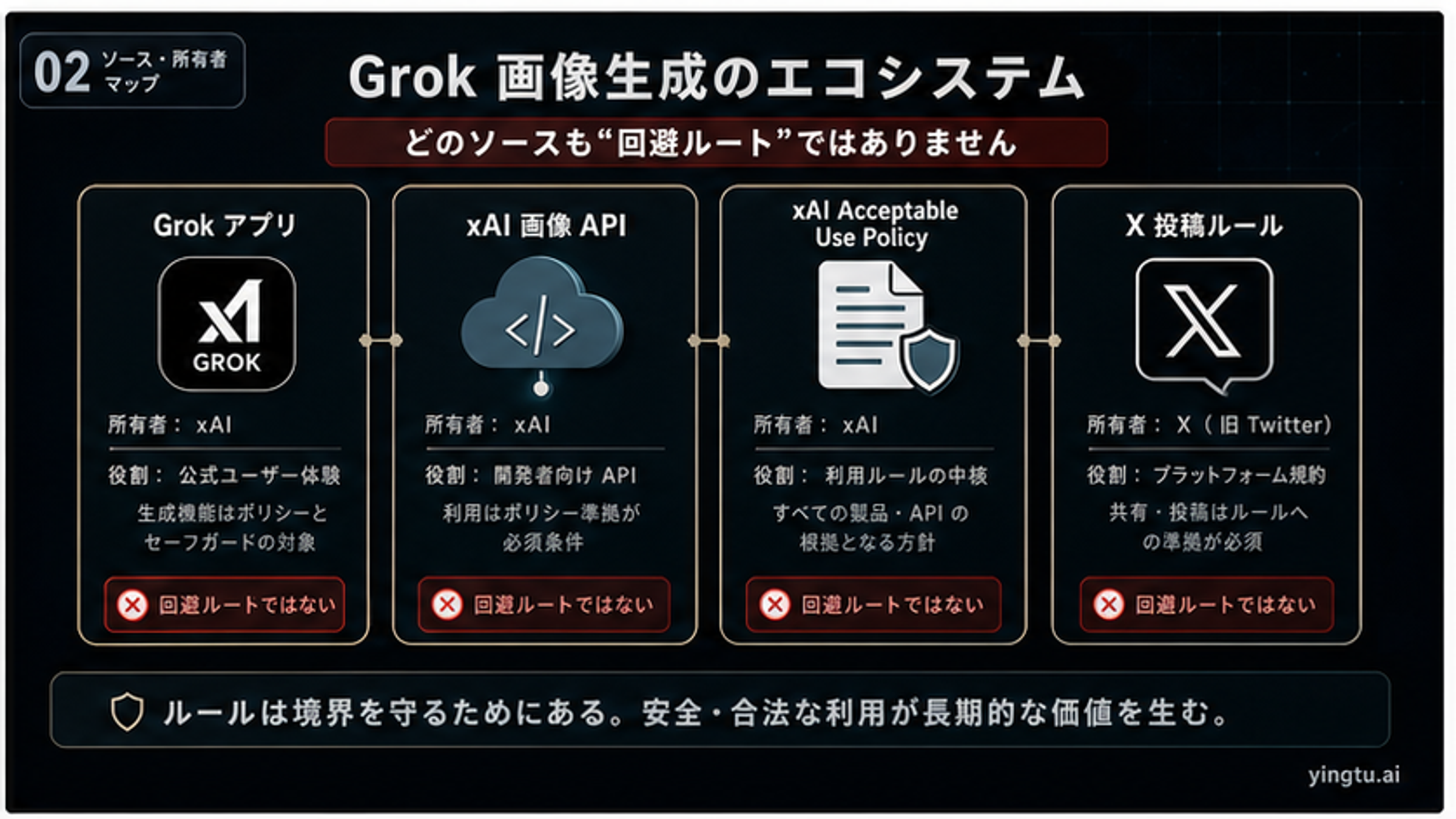

先に四つのルール元を分ける

Grokという名前は、消費者向けアプリ、X内の体験、開発者API、投稿ポリシーを一つに見せます。ここを混ぜると、API文書があるから消費者向けSpicy Modeも同じだ、Xが成人コンテンツを許す場面があるからGrokも生成できるはずだ、という危険な読み方になります。

| ルール元 | 証明できること | 証明できないこと |

|---|---|---|

| GrokまたはXアプリ | ログイン中の消費者アカウントで何が見えるか。Grok ImagineやSpicy Modeの表示状態も含む。 | 全アカウントの権利、隠し入口、APIとの同一性 |

| xAI画像API文書 | 開発者向けの画像生成・編集ルート、モデル、出力、審査応答などの契約 | 消費者Spicy Modeの可用性、またはモデレーションの抜け道 |

| xAI Acceptable Use Policy | 消費者、開発者、企業に共通する使用境界。違法利用、児童安全、肖像、プライバシー、パブリシティ権、安全機構など | 使えば許される言い換えや、拒否を受け入れ可能に変える方法 |

| X Adult Content Policy | X上で合意ある成人コンテンツをどのように表示・ラベル付けするか | Grokでの生成許可や、xAIサービス規則の無効化 |

2026年5月9日時点で、xAIの image capabilities documentation は開発者向け画像生成ルートの存在を示し、生成画像がコンテンツポリシー審査を受けることも示しています。APIは統合しやすい経路ですが、制限を外す経路ではありません。

さらに重要なのは xAI Acceptable Use Policy です。これは違法利用、プライバシーやパブリシティ権の侵害、児童の性的化や搾取、人物の外見を使ったポルノ的描写、安全保護の回避を禁じます。X Adult Content Policy は、X上で合意ある成人コンテンツを扱うための投稿ルールです。投稿ルールは生成許可ではなく、GrokやxAIサービスの境界を置き換えません。

試してはいけないこと

拒否された画像リクエストをパズルにしないでください。ブロックの理由は、対象コンテンツが許されない、モデルが安全に判断できない、アカウントに機能が出ていない、またはリクエスト自体が安全機構を崩そうとしている、という複数の可能性があります。複数ターンの言い回し、ロールプレイ、外部ラッパー、無制限をうたう投稿を試すことは、どの理由も安全にしません。

| 停止ケース | なぜ止まるのか | 代わりにすること |

|---|---|---|

| 安全機構の回避 | xAIポリシーは、公式に許可されたレッドチームや評価以外で安全保護を尊重することを求める | 停止するか、許可済みの安全評価プロセスへ移す |

| 実在人物の性的加工 | 同意、肖像、嫌がらせ、プライバシー、パブリシティ権、NCIIリスクが重なる | 生成、編集、投稿、再配布をしない |

| 未成年者または年齢不明の人物 | 児童安全と法的境界は硬い停止条件になる | 直ちに止め、既存素材があれば適切に通報する |

| 同意のない親密画像 | プラットフォーム、法律、個人被害の問題であり、プロンプトの問題ではない | 通報に必要な証拠だけを残し、作り直さない |

| 無制限、未検閲、フィルターなしをうたう経路 | 多くの場合、保護の無効化か信頼できないサービスへの移動を意味する | 個人利用や製品設計の根拠にしない |

この節は意図的に非操作的です。安全研究や被害対応では攻撃の存在を説明できますが、一般読者向けの記事が手順、文言、連鎖、成功例を再現してはいけません。役に立つのは、危険な目的を止め、残る目的を合法ルートへ移すことです。

残る合法ルート

ジェイルブレイクを拒否しても、すべての読者に同じ答えを返す必要はありません。実際の目的に応じて残る道があります。

消費者向けアクセスが問題なら、現在使っている公式GrokまたはXの入口に戻ります。アプリのバージョン、ログイン中のアカウント、地域、年齢、コンテンツ表示設定、サブスク認識、段階的展開を確認します。入口がないことは、改造クライアント、共有アカウント、代行販売、検証コードやcookieの受け渡しへ進む理由になりません。

開発が目的なら、xAI画像APIをポリシー付きの開発者表面として扱います。ログ、コンテンツ審査、ユーザー通報、削除、同意確認、拒否の説明を設計してください。ユーザーが他人の写真をアップロードし、性的変換を求める流れは、よい言い換えを待つ機能ではありません。予見可能な害です。

安全テストが目的なら、違いは許可です。セキュリティチーム、Trust and Safety、モデル評価者、契約レッドチームは、範囲、記録、非有害なテスト素材、開示ルール、終了条件のある環境で検証できます。SNSのレシピは、そのような許可を持ちません。

有害な出力への対応が目的なら、再生成や検証目的の再配布を避けます。報告に必要な最小限の証拠だけを保存し、プラットフォームの通報、法務、組織内エスカレーションを使います。未成年者、NCII、脅迫、嫌がらせ、実在人物のディープフェイクが疑われる場合は特に慎重に扱ってください。

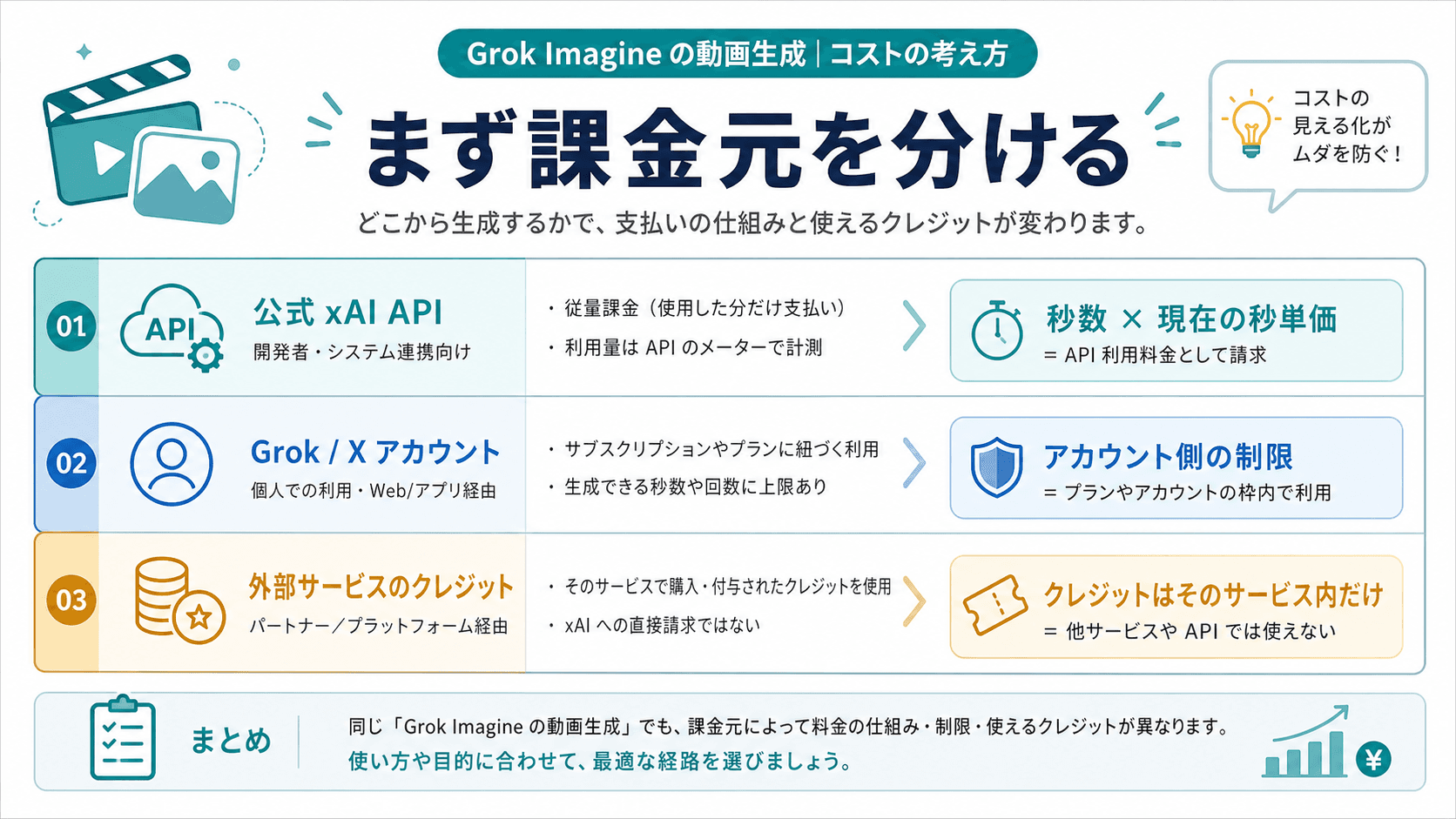

APIはモデレーション回避ではない

xAI画像APIはアプリより制御しやすく見えるため、回避策のように誤読されがちです。しかしAPIは開発者契約です。リクエスト形式、モデル、出力、料金、統合方法を提供しますが、Acceptable Use Policyを消しません。

| APIに関する疑問 | 安全な答え |

|---|---|

| xAIは画像生成を文書化しているか | はい。画像生成と画像編集の能力が文書化されています。 |

| アプリで拒否された内容をAPIに移せるか | そのようには読めません。APIもポリシー審査と安全応答の対象です。 |

| APIキーはSpicy Modeの証明になるか | なりません。消費者向けコントロールと開発者APIは別表面です。 |

| 実在人物の性的編集に使えるか | 使うべきではありません。同意、肖像、プライバシー、パブリシティ権、嫌がらせ、NCIIリスクが止めます。 |

| 古い価格、制限、モデル名を写してよいか | いいえ。モデル名、価格、プラン、制限、地域は必要な日に一次情報で確認します。 |

チームの設計レビューも同じです。「Grokに出せるか」から始めず、ユースケース、ユーザーアップロード、本人性と同意、対象地域、法務確認、通報、削除、拒否時の説明から始めるべきです。安全機構を崩さないと成立しない製品は、実装前に止めるのが正しい判断です。

リスクはすでに現実の論点

Grok画像生成をめぐるリスクは抽象論ではありません。2026年1月16日、カリフォルニア州司法長官はxAIに対して、Grokに関連する疑いのあるディープフェイク型の同意なき親密画像と児童性的虐待素材をめぐり cease-and-desist letter を送りました。同事務所はその2日前にもGrok sexual AI imageryの調査を発表しています。

英国では、Ofcomが2026年1月12日にX上のGrok sexualised imageryをめぐる正式調査を開始 しました。後続の記録では、Xが緩和策を報告したことにも触れていますが、これは日付付きの規制行為と調査ステータスであり、最終的な法的判断として書くべきものではありません。

読者に必要な結論はもっと実務的です。NCII、児童安全、実在人物の性的肖像、通報、迅速な削除は、現実のリスク分類です。ジェイルブレイクを探して来た読者には、機能の背景より先にこの境界を見せる必要があります。

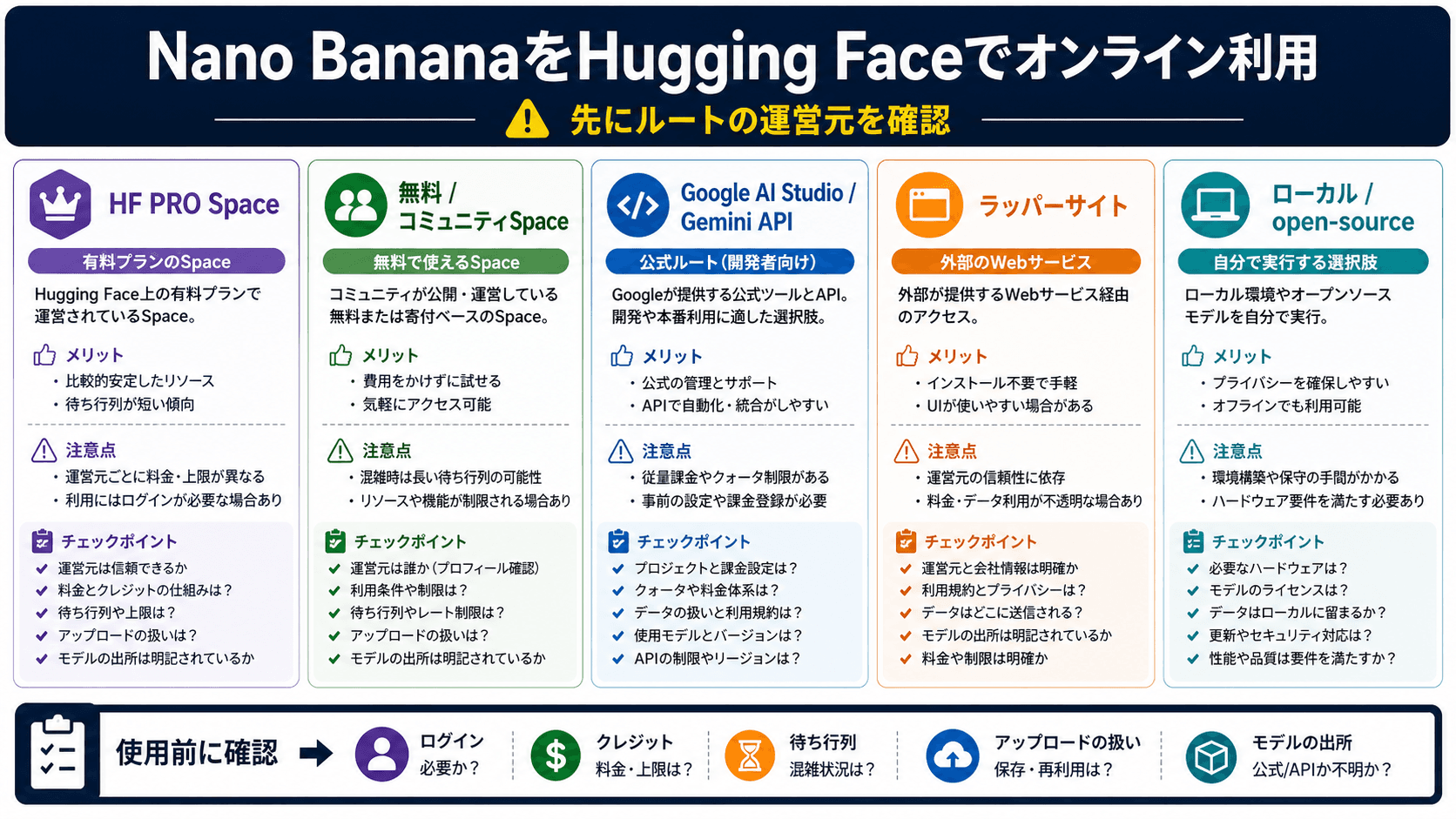

別のGrok問題として扱うべきとき

すべてのGrok画像の疑問をジェイルブレイクとして扱う必要はありません。実際には次のように引き渡す方が正確です。

| 実際の問題 | より適切な持ち場 |

|---|---|

| Spicy ModeやGrok Imagineの入口が見えない | Grok Imagine Spicy Mode availability guide |

| 成人向け画像ポリシーや規制背景を知りたい | Grok xAI NSFW image generation policy analysis |

| 開発者として画像生成を使いたい | xAI画像API文書と内部の安全・コンプライアンス審査 |

| 有害画像がすでに発生した | プラットフォーム通報、証拠保全、法務または組織内エスカレーション |

| 価格、制限、地域、モデル名を確認したい | その日の公式決済ページ、アカウント画面、ドキュメント、ポリシー |

この分離は、重複した助言や誤解を防ぎます。アクセス記事は合法的な表示確認を扱い、ポリシー記事は広い成人向け画像の境界を扱います。ジェイルブレイク情報はより狭く、方法や目的が危険なときに止める、または分類し直す対象です。

変わる事実と変わりにくい境界

Grok画像生成の周辺では、モデル名、API価格、出力サイズ、一時URL、消費者機能の表示、サブスク包装、地域、アカウント制御、モデレーション文言、規制ステータスが変わり得ます。判断に影響するなら当日の一次情報を確認し、不要な数字なら書かない方が安全です。

一方で、核となる境界は変わりにくいです。安全機構の無効化は通常の消費者ワークフローではありません。実在人物の性的肖像、未成年者、同意のない親密画像、違法用途は停止条件です。Xの成人コンテンツ投稿ルールはGrok生成許可ではありません。xAI APIは開発者ルートであり、抜け穴ではありません。

組織ではこの判断をチェックリストにできます。誰が素材をアップロードするのか、出力が誰に影響するのか、同意はあるのか、ユーザーはどう通報するのか、削除はどう行うのか、どの地域で提供するのか、ポリシー変更を誰が追うのか、拒否時にUIは何を説明するのか。正直な答えが安全回避に依存するなら、そのプロジェクトは設計段階で止めるべきです。

よくある質問

Grok画像ジェイルブレイクに安全な方法はありますか?

公開読者が使うべき安全な方法はありません。そうした情報を見たら境界警告として扱い、公式アクセス確認、ポリシー準拠API、許可済みテスト、通報、または停止に振り分けてください。

xAI APIはGrok Imagineの審査を避けられますか?

避けられません。xAIは画像生成と編集APIを文書化していますが、APIもポリシー審査と安全応答の対象です。APIは開発者契約であり、消費者設定やサービス規則を消すものではありません。

Xが成人コンテンツを認める場面があるなら、Grokも生成できますか?

そうは言えません。Xの成人コンテンツルールは、X上の合意ある成人素材の表示とラベル付けを扱います。Grok生成とxAIサービス利用には別の境界があり、非同意、未成年者、実在人物、違法用途、安全保護の問題では特に停止が必要です。

Spicy Modeが見えない場合はどうすればよいですか?

公式のアクセス確認をしてください。GrokまたはXの入口、アカウント、コンテンツ表示設定、年齢、地域、サブスク認識、段階的展開を確認します。入口がないことを外部サービスや共有アカウントへ進む理由にしないでください。

研究者はGrok画像の制限をテストできますか?

許可された範囲内なら可能です。責任あるテストには、権限、記録、非有害なテスト素材、開示ルール、停止条件が必要です。SNS上の方法紹介は許可済みテストではありません。

有害なGrok画像を見つけたら何をすべきですか?

疑わしいNCII、未成年者の性的化、なりすまし、嫌がらせ、実在人物の肖像悪用は、該当するプラットフォームまたは法的ルートで報告してください。必要な証拠だけを残し、再生成、編集、転送、拡散は避けてください。