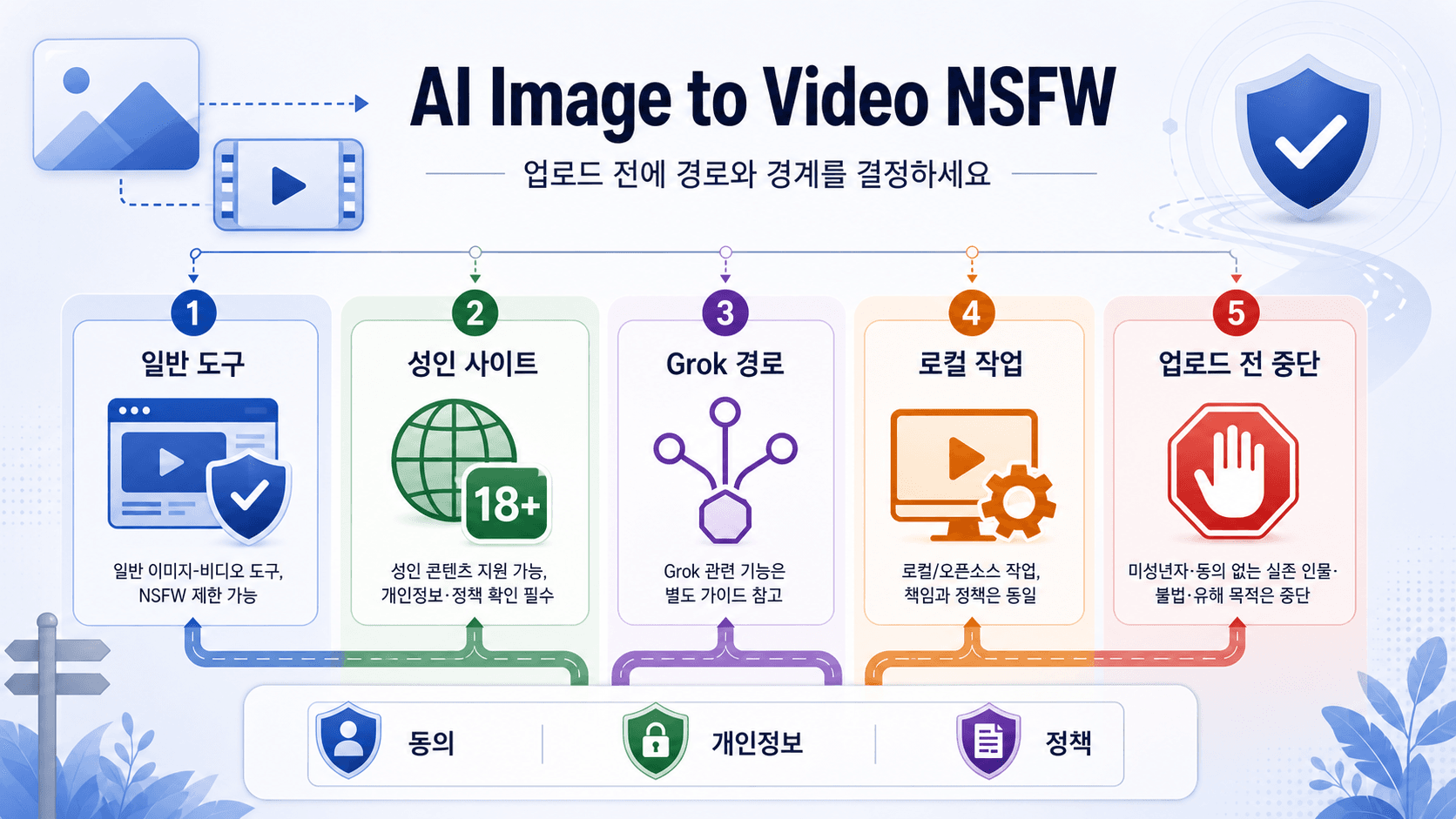

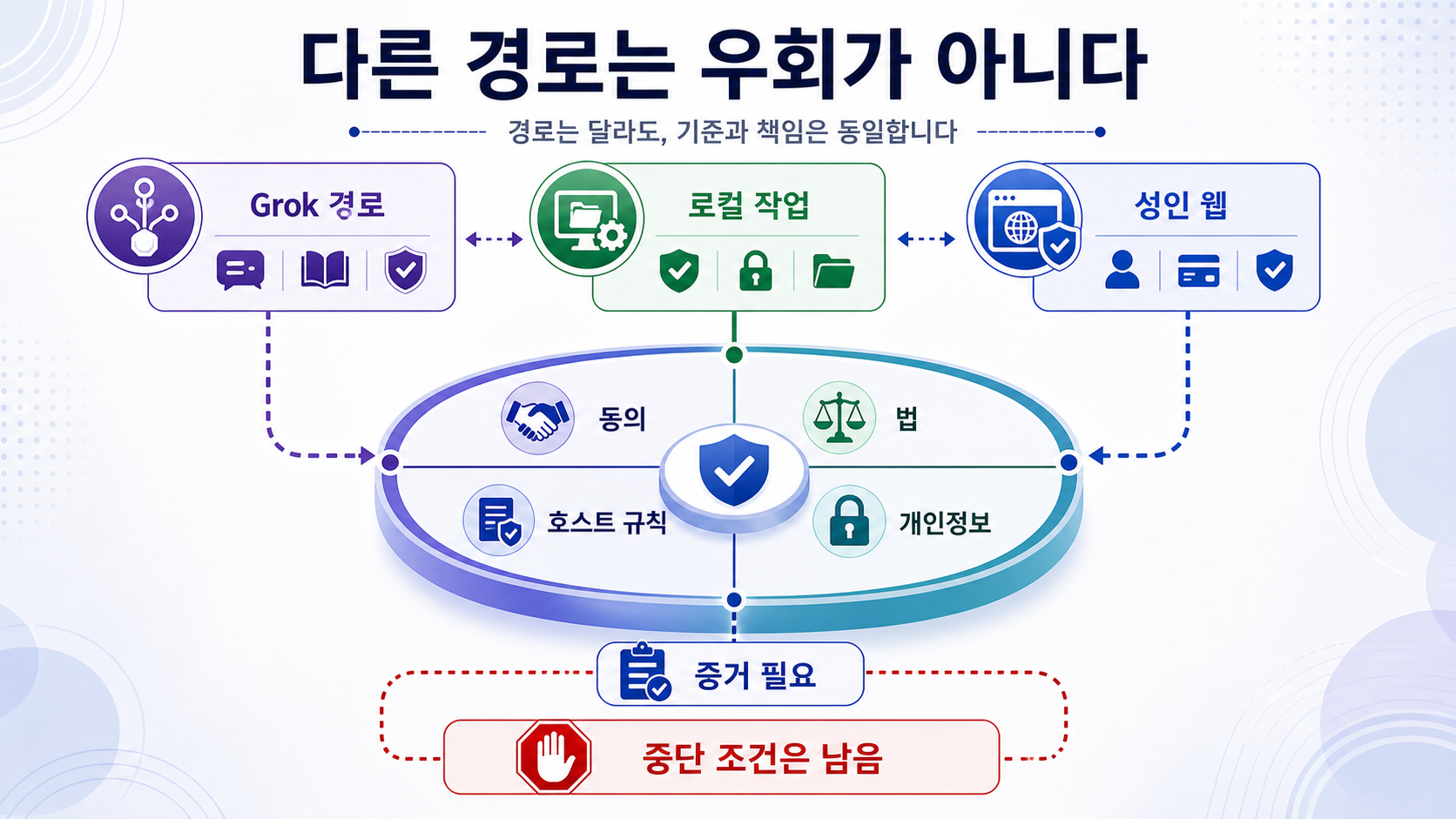

2026년 5월 8일 기준으로 AI 이미지-투-비디오 NSFW 작업은 “어떤 도구가 뚫리느냐”로 정리할 수 없다. 일반 이미지-투-비디오 생성기는 노골적이거나 민감한 성적 요청을 제한하는 경우가 많고, 성인용 사이트는 더 적은 필터를 광고할 수 있으며, 로컬 환경은 파일 통제를 늘릴 수 있다. 그러나 첫 판단은 생성기가 아니라 업로드할 원본 이미지다.

성인 인증이나 19세 이상 접근 안내가 있는 서비스라도, 그 자체가 원본 이미지 사용 허가는 아니다. 어떤 성인용 도구가 “NSFW”, “무제한”, “필터 없음”, “이미지에서 동영상”을 내세우더라도, 그 문구는 수요와 기능 주장일 뿐 안전, 동의, 삭제, 게시 허용을 증명하지 않는다. 따라서 버튼을 누르기 전에 원본과 경로를 분리해야 한다. 이 순서가 흔들리면 가장 민감한 파일이 먼저 노출된다. 되돌리기 어려운 업로드가 먼저 일어나기 때문이다.

특히 “이미지를 동영상으로 만든다”는 표현은 작업을 가볍게 보이게 한다. 하지만 성적 맥락에서는 원본 이미지의 얼굴, 신체, 촬영 장소, 메타데이터, 업로드 기록, 결제 계정, 생성된 썸네일이 모두 연결될 수 있다. 최종 영상이 공개되지 않더라도 업로드 순간부터 개인정보와 동의 문제가 시작된다. 그래서 먼저 원본 이미지가 통과할 수 있는지 확인하고, 그다음에 경로를 고르는 순서가 필요하다.

| 경로 | 맞는 경우 | 문제가 되는 지점 | 업로드 전 확인 |

|---|---|---|---|

| 일반 이미지-투-비디오 | 안전한 애니메이션, 제품 영상, 아바타, 비노골적 모션 테스트 | NSFW, 실제 인물, 사적 이미지는 거절될 수 있음 | 현재 정책, 계정 위험, 비NSFW 버전으로 해결 가능한지 |

| 성인용 사이트 | 가상의 성인 캐릭터 또는 명확히 동의된 성인 소재 | 저장, 삭제, 공개 갤러리, 결제, 학습 사용, 신고 처리 | 약관, 개인정보 처리, 삭제 범위, 동의 증거 |

| Grok | Grok Imagine, Spicy Mode, xAI 정책이 실제 질문일 때 | 소비자 앱, API, X 게시 규칙이 서로 다름 | Grok 전용 가이드와 xAI 정책을 별도로 확인 |

| 로컬 또는 open-source | 파일과 인프라를 직접 관리하는 실험 | 로컬 처리도 동의, 나이, 법, 라이선스, 게시 책임을 없애지 않음 | 이미지 권리, 연령, 인물성, 모델 카드, 배포 계획 |

| 시작하지 않기 | 동의 없는 실제 인물, 미성년자, 사적 이미지, NCII, 괴롭힘, 우회 목적 | 단순한 미지원이 아니라 피해 또는 불법 위험 | 생성하지 말고 피해가 있으면 증거 보존 후 신고 |

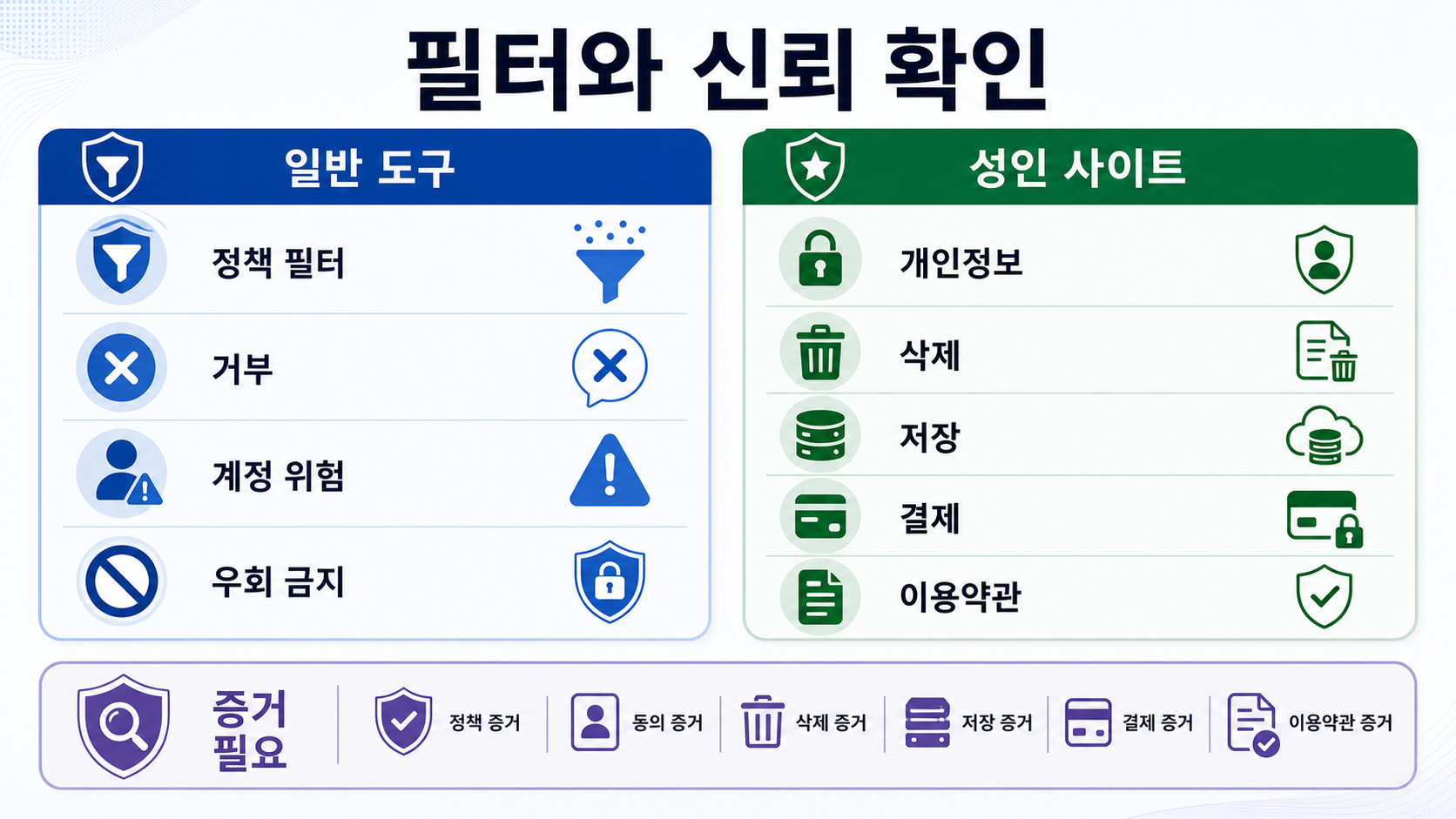

“비공개”, “무료”, “무제한”, “무수정”, “필터 없음”은 검증해야 할 주장이다. 실제 계약은 현재 약관, 삭제 조건, 저장 방식, 신고 창구, 성인 인증 방식, 원본 이미지 처리 방식에서 결정된다.

도구보다 원본 이미지를 먼저 확인한다

이미지-투-비디오는 텍스트 프롬프트보다 더 민감하다. 사용자가 실제 파일을 업로드하기 때문이다. 그 파일에는 얼굴, 몸, 메타데이터, 사적인 공간, 촬영 맥락, 특정 사람을 떠올리게 하는 특징이 포함될 수 있다. 따라서 첫 질문은 “어느 사이트가 통과시키는가”가 아니라 “이 이미지를 이 목적에 맞게 업로드하고 저장하고 성적 영상으로 변환해도 되는가”다.

업로드 전 게이트는 간단해야 한다.

| 원본 이미지 | 위험 해석 | 행동 |

|---|---|---|

| 직접 만든 가상 성인 캐릭터 또는 완전 합성 이미지 | 신원 위험은 낮지만 약관과 나이 표현은 남음 | 해당 카테고리가 허용되고 개인정보 조건이 명확할 때만 진행 |

| 모델, 파트너, 출연자가 이 용도에 명시 동의한 이미지 | 동의는 업로드, 저장, 편집, 출력, 공유까지 구체적이어야 함 | 동의 기록을 보관하고 삭제 범위가 모호한 사이트는 피함 |

| 동의 없는 실제 인물 | 초상, 개인정보, 괴롭힘, NCII 위험이 겹침 | 중단 |

| 미성년자 또는 나이가 불분명한 사람 | 아동 안전 경계 | 중단하고 피해가 있으면 신고 경로로 이동 |

| 사적이거나 친밀한 이미지 | 비동의 친밀 이미지가 될 위험 | 업로드, 테스트, 공유 금지 |

| 필터를 피하려는 요청 | 보호장치 우회 | 표현을 바꾸지 말고 작업 중단 |

이 단계에서 실패한 이미지는 도구를 바꾼다고 안전해지지 않는다. 오히려 통과가 쉬운 사이트를 찾는 과정에서 원본 이미지가 저장되거나, 결제 계정과 연결되거나, 미리보기와 로그로 남거나, 제3자에게 노출될 수 있다.

일반 영상 생성기가 NSFW 요청을 막는 이유

일반 이미지-투-비디오 도구는 브랜드, 교육, 제품 소개, SNS 콘텐츠, 아바타, 크리에이터 작업 등 넓은 사용자를 대상으로 한다. 그래서 노골적 성적 콘텐츠, 비동의 친밀 이미지, 아동 성적 착취, 타인의 이미지나 음성이나 신체의 무단 사용, 괴롭힘, 보호장치 우회를 제한한다.

Runway의 Usage Policy는 sexually explicit content, adult nudity, non-consensual intimate imagery의 생성 또는 수정, 허가 없는 타인의 이미지나 영상이나 음성 사용을 금지한다. HeyGen의 ethics와 moderation policy도 인물 허가와 성적 콘텐츠 경계를 드러낸다.

모델 제공자 정책에서도 같은 구조가 보인다. OpenAI의 usage policies는 성폭력, 비동의 친밀 콘텐츠, 아동 성적 착취, 특정 likeness 오용, 보호장치 우회를 금지한다. Google의 Generative AI prohibited-use policy는 아동 착취, non-consensual intimate imagery, 개인정보 또는 IP 침해, safety filters 우회, 성적 만족을 위한 음란 콘텐츠를 금지한다.

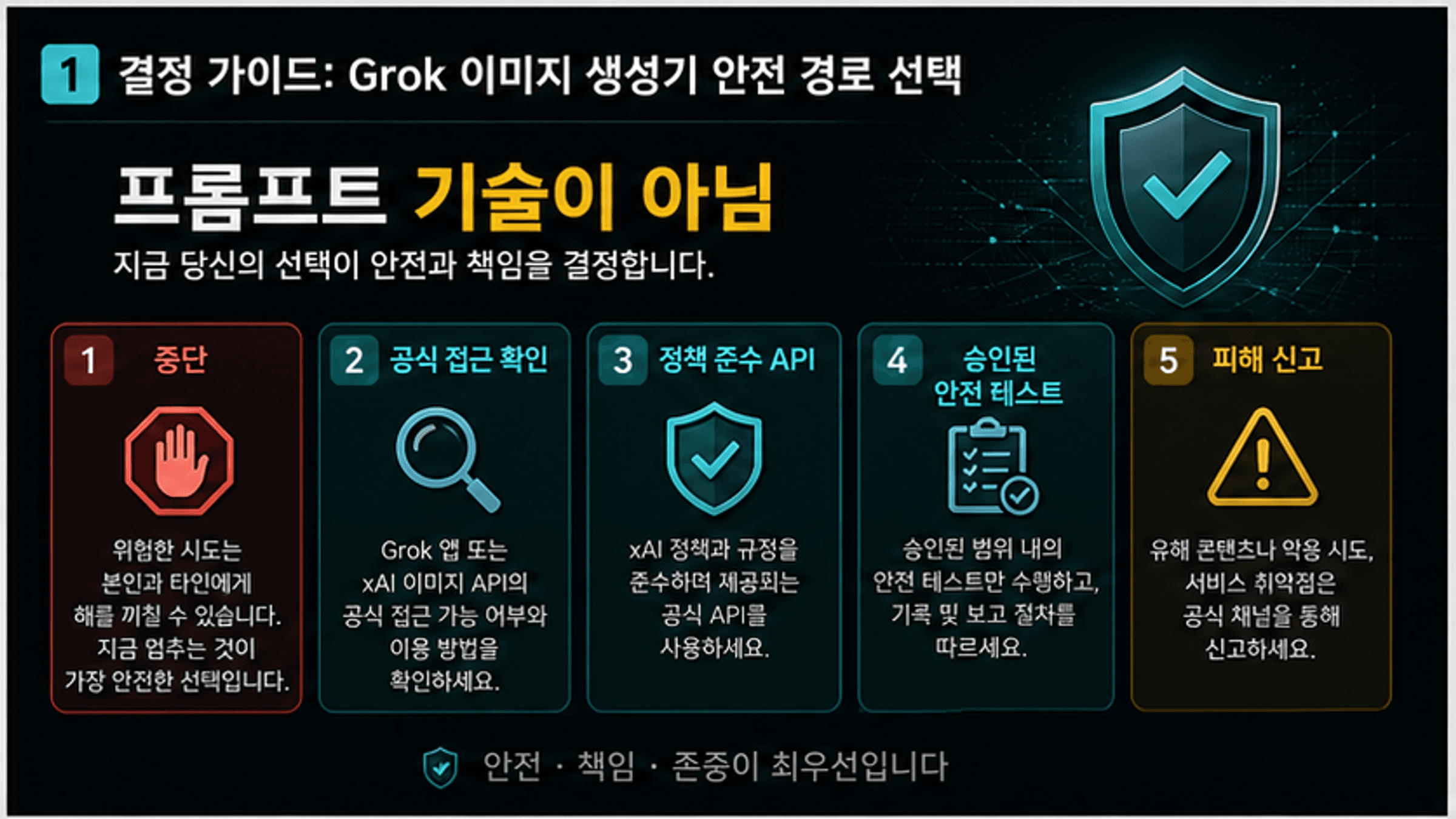

따라서 일반 도구의 거절은 불편한 오류가 아니라 경계 신호다. 요청이 노골적 성적 콘텐츠인지, 실제 인물인지, 동의가 없는지, 나이가 문제인지, 사적 이미지인지, 필터 우회인지 분류해야 한다. 필터가 의도를 못 알아듣게 표현을 바꾸는 것은 문제를 해결하는 것이 아니라 위험한 방향으로 이동하는 것이다.

성인용 사이트는 신뢰 점검이 먼저다

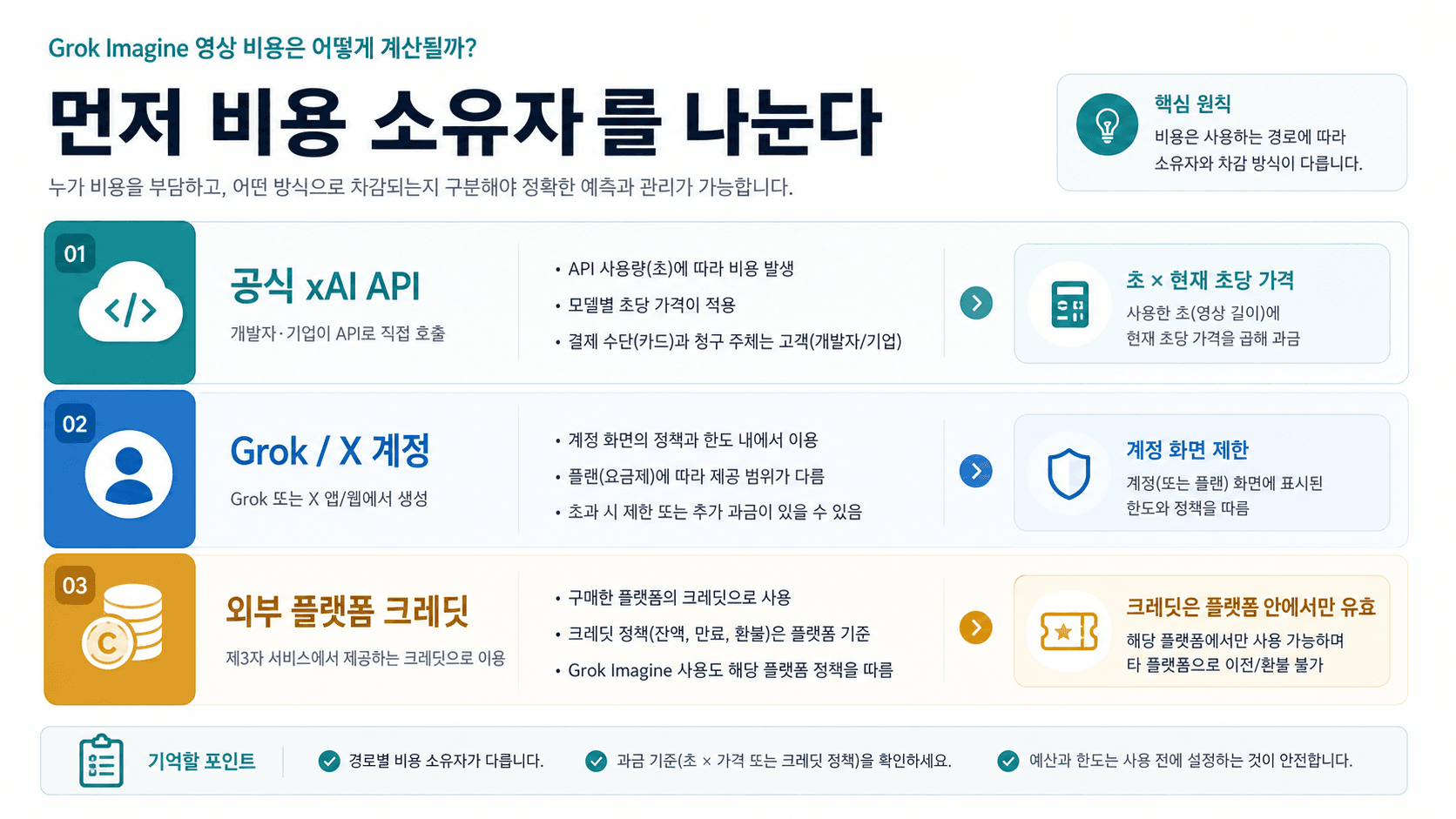

성인용 사이트는 요청과 가장 직접적으로 맞아 보인다. 하지만 이 경로에서는 광고 문구보다 계약이 중요하다. “NSFW AI 비디오”, “이미지에서 동영상”, “무제한 무료”, “Uncensored”, “필터 없음” 같은 문구는 원본이 어디에 저장되는지, 누가 볼 수 있는지, 결과가 공개 갤러리에 노출되는지, 학습에 쓰이는지, 삭제가 어디까지 되는지, 신고를 어떻게 처리하는지 설명하지 않는다.

업로드 전에는 다음을 확인한다.

| 문구 | 확인할 내용 | 이유 |

|---|---|---|

| 비공개 | 저장 기간, 직원 접근, 공개 갤러리 기본값, 학습 사용 | 성인 원본 이미지는 합법이라도 민감하다 |

| 언제든 삭제 | 원본, 생성 영상, 썸네일, 로그, 백업 삭제 범위 | 삭제 버튼이 전체 삭제를 뜻하지 않을 수 있다 |

| 필터 없음 | 금지 목록, 신고 창구, 미성년자와 NCII 대응 | 약한 필터는 악용 대응도 약할 수 있다 |

| 무료 | 크레딧, 워터마크, 해상도, 대기열, 내보내기 제한 | 무료 체험과 최종 무료는 다르다 |

| 실제 인물 | 명시 동의, likeness, NCII, 나이 정책 | 실제 인물은 가장 위험한 영역이다 |

| 익명 또는 로컬 | 무엇이 기기에 남고 무엇이 서버로 나가는지 | 개인정보 보호는 말이 아니라 구조로 결정된다 |

사이트가 이 기본 질문에 답하지 않으면, 유출되거나 재사용되었을 때 문제가 되는 이미지를 업로드하지 않는 것이 낫다. 합법적이고 동의된 가상 성인 작업이라도 저장과 삭제 조건이 불명확하면 다른 경로를 선택해야 한다.

또한 성인 인증이 있다는 사실은 입력 이미지가 모두 허용된다는 뜻이 아니다. 만 19세 이상만 접근 가능한 화면이라도, 동의 없는 실제 인물, 사적인 친밀 이미지, 미성년자로 보이는 인물, 괴롭힘 목적의 변환은 중단해야 한다. 연령 게이트는 이용자 접근을 나누는 장치일 뿐, 원본 이미지의 권리와 명시 동의를 대신 확인해 주지 않는다.

Grok은 별도 가지로 둔다

Grok은 Grok Imagine과 Spicy Mode 때문에 성인용 생성 논의에 자주 등장한다. 그러나 AI 이미지-투-비디오 NSFW 전체를 Grok 하나로 설명하면 오해가 생긴다. Grok 소비자 앱, xAI API, X 게시 규칙, xAI 정책은 각각 별도 계약이다.

질문이 Spicy Mode가 계정에 보이는지, 왜 사라졌는지, X 민감 미디어 설정이 관련되는지라면 Grok Imagine Spicy Mode availability guide를 보는 것이 맞다. xAI 정책, 실제 인물, 미성년자, NCII, moderation 경계를 확인하려면 Grok xAI NSFW image generation policy guide가 더 맞다.

xAI의 Acceptable Use Policy는 privacy와 publicity rights 침해, 사람 likeness의 pornographic depictions, 아동 성적 착취, safeguard circumvention을 금지한다. 그래서 Grok은 “더 자유로운 정답”이 아니라 독자적인 접근 조건과 정책을 가진 제품 경로다.

로컬과 open-source도 책임을 없애지 않는다

로컬 워크플로는 원본 이미지를 성인용 웹사이트에 올리지 않아도 된다는 점에서 매력적이다. 합법적이고 동의된 가상 소재를 다루는 경우에는 파일 통제, 격리, 삭제 관리에 도움이 될 수 있다. 하지만 로컬 실행은 동의 없는 실제 사람 사진을 성적으로 움직여도 된다는 허가가 아니다.

로컬 작업에서는 사용자가 사실상 운영자가 된다. 원본 이미지, 중간 프레임, 실패한 출력, 캐시, 로그, 공유 폴더, 클라우드 동기화, 백업이 어디에 남는지 직접 관리해야 한다. 성인용 웹사이트보다 외부 노출이 적어 보이더라도 가족 공용 기기, 회사 관리 기기, 자동 백업 폴더, 공개 저장소에 작업 흔적이 남으면 별도의 개인정보 문제가 된다. 로컬은 안전을 보장하는 마법이 아니라 책임이 사용자에게 이동하는 선택지다.

| 로컬 경로의 장점 | 남는 경계 |

|---|---|

| 원본 파일이 내 하드웨어에 남을 수 있음 | 이미지 권리와 명시 동의는 여전히 필요 |

| 일부 코드, 노드, 모델 카드를 확인할 수 있음 | 라이선스, host rules, 지역 법률은 남는다 |

| 성인용 사이트 저장과 결제 위험을 줄일 수 있음 | 보관, 삭제, 유출 방지를 직접 책임져야 한다 |

| 가상 소재 실험을 분리하기 쉬움 | 실제 인물, 미성년자, NCII 중단 조건은 그대로다 |

이 부분을 모델 이름, 프롬프트, 우회 방법 목록으로 만들면 안 된다. 필요한 결론은 더 간단하다. 로컬 처리는 합법적이고 동의된 소재에서 개인정보 노출을 줄일 수 있지만, 동의와 권리의 대체물이 아니다.

오래된 NSFW 목록은 빠르게 낡는다

NSFW 이미지-투-비디오 목록은 일반 소프트웨어 리뷰보다 빨리 낡는다. 무료 크레딧, 워터마크, 지역 제한, 대기열, 필터, 모델 접근, 삭제, 공개 갤러리, Grok 상태가 자주 바뀐다. 오래된 순위표나 자동 번역된 소개 글은 현재 확인의 출발점이지, 안전을 보장하는 자료가 아니다.

| 주장 | 믿을 수 있는 조건 | 더 안전한 표현 |

|---|---|---|

| 필터 없음 | 현재 약관과 집행 방식이 뒷받침할 때 | “필터가 적다고 광고하지만 규칙 확인 필요” |

| 비공개 | 원본, 영상, 로그, 직원 접근, 학습 사용을 설명할 때 | “업로드 전 저장과 삭제를 확인” |

| 무료 | 크레딧, 워터마크, 해상도, 대기열, export가 보일 때 | “무료 체험일 수 있으며 완료까지 무료는 아님” |

| 무제한 | 플랜과 fair use가 명확히 말할 때 | “한도는 플랜, 대기열, 악용 방지에 따라 바뀜” |

| 실제 사진 가능 | 정책이 동의된 구체적 사용을 허용할 때 | “실제 인물은 명시 동의가 필요” |

이미 유해한 AI 성적 콘텐츠가 만들어졌다면 도구 비교를 멈춰야 한다. URL, 계정, 시간, 플랫폼, 화면 증거를 보존하되 다시 공유하지 않는다. 미성년자가 관련되면 NCMEC의 generative AI guidance 같은 아동 안전 자료가 더 중요하다. 미국의 non-consensual intimate imagery에는 TAKE IT DOWN Act 요약이 도움이 될 수 있지만, 지역 법률은 별도로 확인해야 한다.

피해 대응에서는 설명을 위해 문제 영상을 다시 올리거나 전달하지 않는 것도 중요하다. 증거는 URL, 계정명, 게시 시간, 플랫폼명, 신고 번호, 원본 알림을 보존하는 방식으로 남긴다. 협박, 금전 요구, 학교나 직장으로의 확산, 미성년자 관련 정황이 있으면 일반 커뮤니티 조언보다 플랫폼 신고, 신뢰할 수 있는 지원 단체, 필요한 경우 법률 전문가와 빠르게 연결하는 것이 낫다.

반대로 피해가 아니라 창작 프로젝트라면, 기록해야 할 것도 달라진다. 어떤 원본을 사용했는지, 동의 범위가 어디까지인지, 어떤 서비스나 로컬 환경을 썼는지, 결과물을 어디에 게시할 예정인지, 삭제 요청이 들어오면 어떻게 처리할지 미리 정해 둔다. 이 기록은 콘텐츠를 홍보하기 위한 자료가 아니라 나중에 권리나 동의 문제가 생겼을 때 작업을 중단하거나 삭제할 수 있게 해 주는 운영 메모다. 특히 공동 작업자에게 파일을 넘길 때도 같은 기준을 적용한다.

자주 묻는 질문

일반 이미지-투-비디오 도구로 NSFW 영상을 만들 수 있나.

일반 이미지를 움직이는 것은 가능할 수 있지만, 많은 서비스가 노골적 성적 콘텐츠, 동의 없는 실제 인물, NCII, 아동 안전 위험, 필터 우회를 막는다. 거절은 우회할 힌트가 아니라 경계 신호다.

성인용 사이트가 더 안전한가.

자동으로 안전하지 않다. 가상 또는 완전히 동의된 성인 소재에는 맞을 수 있지만, 약관, 개인정보 처리, 저장, 삭제, 신고 경로가 명확해야 한다.

결과를 비공개로 두면 실제 사람 사진을 써도 되나.

안 된다. 성적 영상화에는 그 목적에 대한 명시 동의가 필요하다. 비공개라는 말은 likeness, 개인정보, NCII, 괴롭힘, 법적 위험을 없애지 않는다.

가상 캐릭터나 AI 생성 이미지면 다른가.

신원 위험은 낮아질 수 있지만, 나이 표현, 서비스 약관, 공개 규칙, 성인 카테고리 허용 여부는 여전히 확인해야 한다.

로컬 생성은 합법성을 보장하나.

보장하지 않는다. 로컬 처리는 파일 위치를 바꿀 뿐, 동의, 나이, 개인정보, 권리, 라이선스, host rules, 지역 법률을 없애지 않는다.

“무수정”이나 “필터 없음”을 믿어도 되나.

믿는 것이 아니라 검증해야 한다. 현재 약관, 저장, 삭제, 결제, 신고 창구, 금지 항목을 확인할 수 없다면 민감한 이미지를 업로드하지 않는다.

가장 먼저 할 일은 무엇인가.

원본 이미지를 분류한다. 가상 캐릭터이거나 명시 동의가 있는 성인 소재라면 일반 도구, 성인용 사이트, Grok, 로컬 환경 중 어떤 계약이 맞는지 확인한다. 동의 없는 실제 인물, 미성년자, 사적 이미지, NCII, 괴롭힘, 보호장치 우회가 조금이라도 포함되면 생성 경로를 찾지 말고 멈춘다.