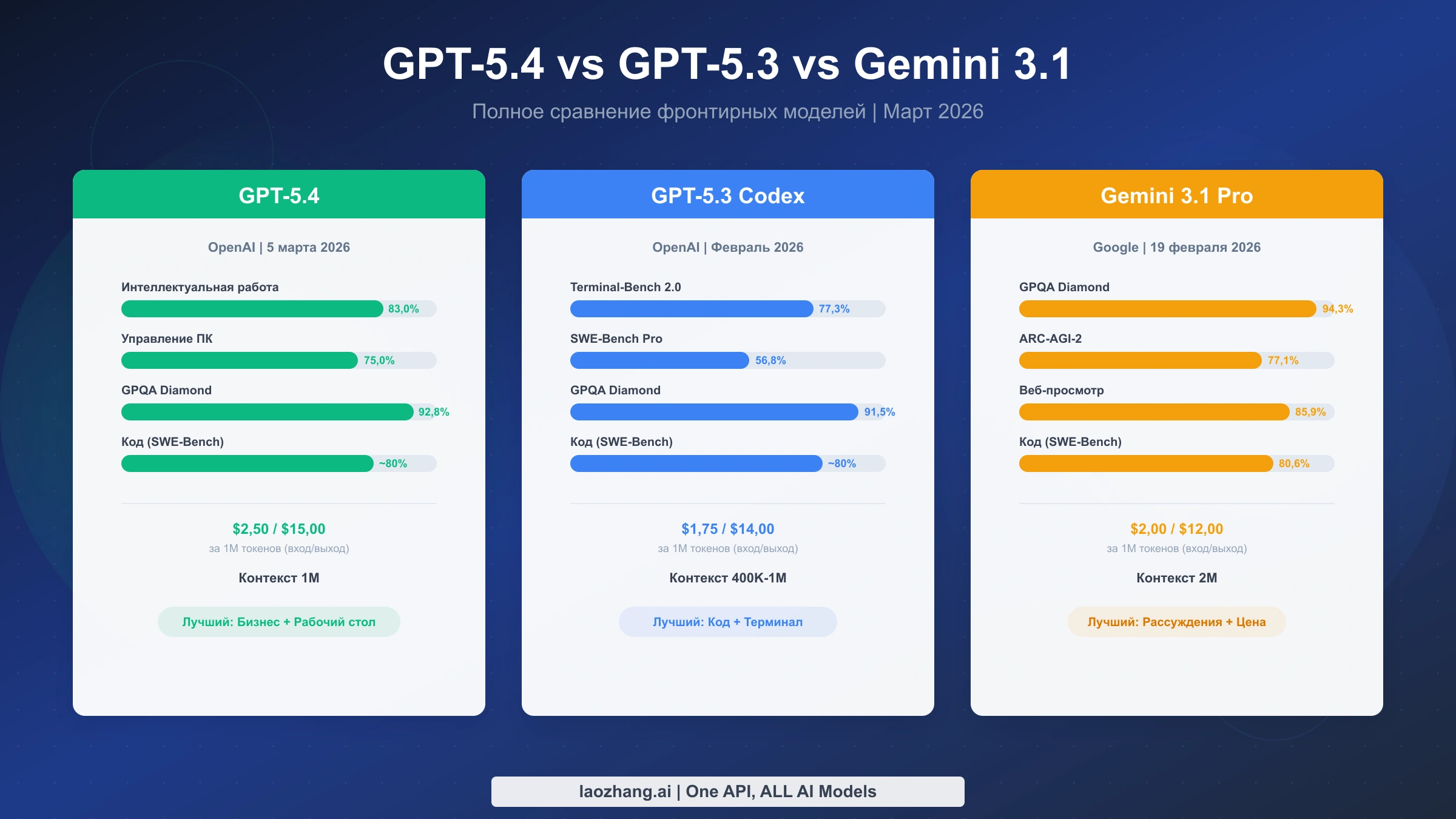

GPT-5.4 был запущен 5 марта 2026 года, став первой ИИ-моделью, превзошедшей экспертов-людей по бенчмаркам интеллектуальной работы. В сочетании с доминированием GPT-5.3 Codex в терминальных рабочих процессах и контекстным окном Gemini 3.1 Pro на 2 миллиона токенов разработчики теперь стоят перед настоящим выбором из трёх вариантов. Это руководство сравнивает все результаты бенчмарков, тарифные планы и API-функции, чтобы помочь вам выбрать подходящую модель для конкретных задач.

Ландшафт ИИ в марте 2026 года изменил всё

Ландшафт ИИ-моделей кардинально изменился в начале 2026 года. Всего за четыре недели были запущены три фронтирные модели, которые совместно переопределили возможности больших языковых моделей. Понимание этого контекста необходимо, прежде чем переходить к сравнению бенчмарков, потому что конкурентная динамика между OpenAI и Google никогда не была такой напряжённой.

OpenAI выпустила GPT-5.3 Codex в начале февраля 2026 года как специализированную модель для программирования, созданную для терминальных и CLI-рабочих процессов. Она представила новую парадигму, при которой модель работает непосредственно в среде разработчика, а не через чат-интерфейсы. GPT-5.3 Codex набрала 77,3% на Terminal-Bench 2.0 — бенчмарке, измеряющем способность модели выполнять реальные задачи командной строки в различных операционных системах, менеджерах пакетов и системах сборки. Это было не просто постепенное улучшение предыдущих моделей — это фундаментальный сдвиг к моделям, которые понимают инструменты разработчиков на нативном уровне.

Google ответила 19 февраля 2026 года выпуском Gemini 3.1 Pro, расширяя границы рассуждений и обработки контекста. С контекстным окном на 2 миллиона токенов и результатом 94,3% на GPQA Diamond (бенчмарк научных рассуждений аспирантского уровня) Gemini 3.1 Pro утвердилась как основная модель для наукоёмких задач. Google также выпустила Gemini 3.1 Flash-Lite всего за $0,25 за миллион входных токенов, создав бюджетный тариф, который значительно дешевле конкурентов для высоконагруженных приложений.

Затем 5 марта 2026 года OpenAI представила GPT-5.4, которая стала первой моделью, превзошедшей экспертов-людей на бенчмарке интеллектуальной работы GDPval с результатом 83,0%. GPT-5.4 также представила нативные возможности управления компьютером, набрав 75,0% на OSWorld, что означает способность управлять настольными приложениями, навигировать в веб-браузерах и координировать многоэтапные рабочие процессы между программными инструментами. Для предприятий, стремящихся автоматизировать сложные цифровые процессы, эта возможность представляет собой определяющий момент для всей категории. Если вы знакомы со сравнением предыдущего поколения, разрыв в производительности между поколениями значительно увеличился по всем категориям бенчмарков.

Ключевой вывод из этой стремительной серии запусков состоит в том, что ни одна модель не доминирует по всем параметрам. GPT-5.4 лидирует в интеллектуальной работе и автоматизации рабочего стола. Gemini 3.1 Pro превосходит в научных рассуждениях и предлагает самое большое контекстное окно при самой низкой цене за токен. GPT-5.3 Codex остаётся лучшим выбором для терминальных рабочих процессов разработки. Выбор правильной модели в марте 2026 года требует точного понимания того, что именно вам нужно.

Сравнение бенчмарков — каждый важный показатель

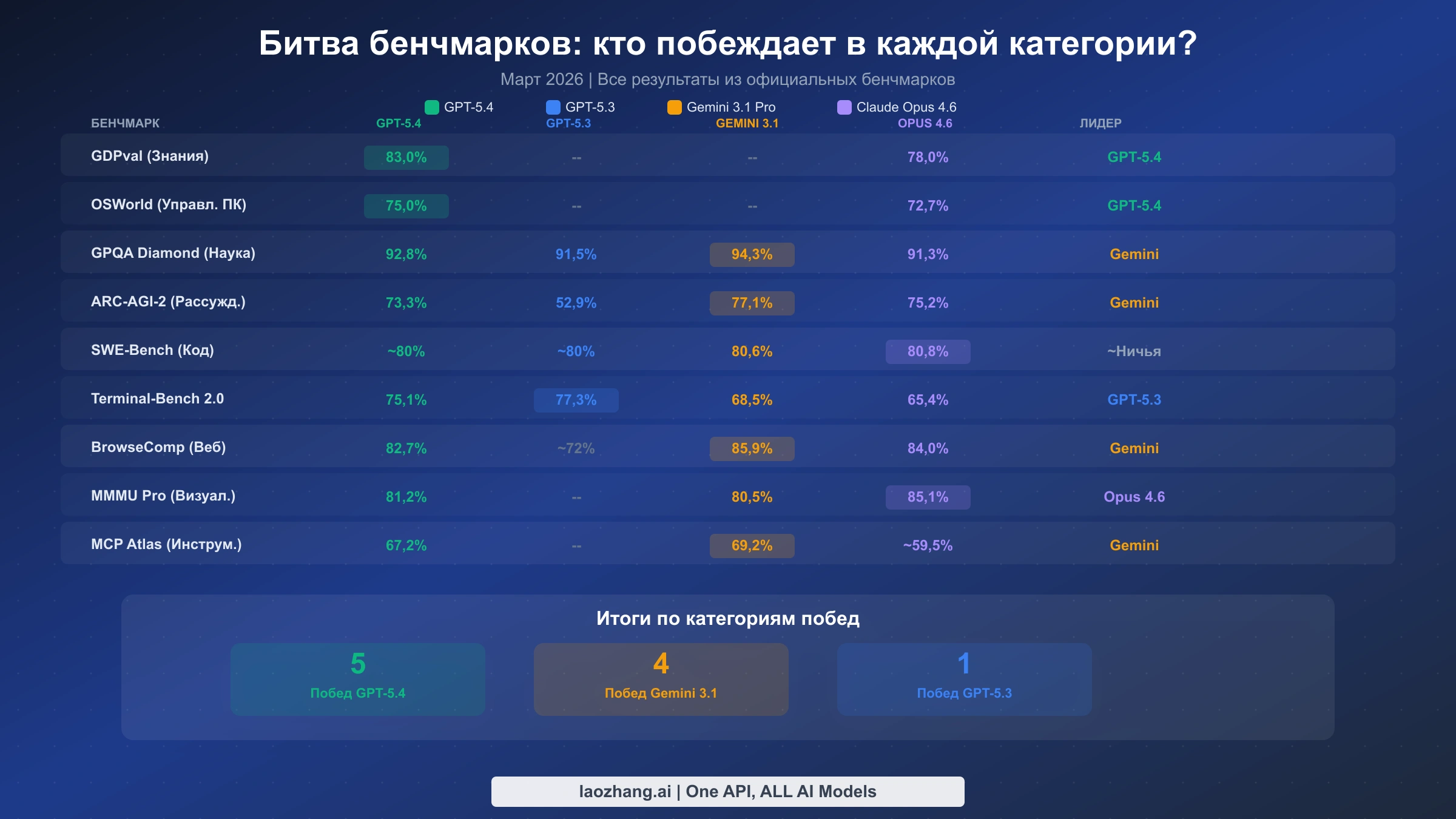

Сырые результаты бенчмарков рассказывают лишь часть истории, но понимание того, что на самом деле измеряет каждый бенчмарк и почему определённые модели преуспевают, раскрывает практические последствия для ваших рабочих задач. Таблица ниже представляет наиболее полное доступное сравнение, охватывающее 11 бенчмарков в области рассуждений, программирования, управления компьютером и агентных возможностей.

| Бенчмарк | Что измеряет | GPT-5.4 | GPT-5.4 Pro | GPT-5.3 Codex | Gemini 3.1 Pro |

|---|---|---|---|---|---|

| GPQA Diamond | Наука аспирантского уровня | 92,8% | 94,4% | 91,5% | 94,3% |

| ARC-AGI-2 | Новаторские рассуждения | 73,3% | 83,3% | 52,9% | 77,1% |

| GDPval | Интеллектуальная работа | 83,0% | - | - | - |

| OSWorld | Управление компьютером | 75,0% | - | - | - |

| SWE-Bench Verified | Генерация кода | ~80% | - | ~80% | 80,6% |

| SWE-Bench Pro | Продвинутое программирование | 57,7% | - | 56,8% | 54,2% |

| Terminal-Bench 2.0 | CLI/терминальные задачи | 75,1% | - | 77,3% | 68,5% |

| BrowseComp | Веб-просмотр | 82,7% | 89,3% | ~72% | 85,9% |

| MMMU Pro | Мультимодальное понимание | 81,2% | - | - | 80,5% |

| MCP Atlas | Координация инструментов | 67,2% | - | - | 69,2% |

| Toolathlon | Мультиинструментальные агенты | 54,6% | - | 51,9% | - |

Бенчмарки рассуждений демонстрируют любопытное разделение. Gemini 3.1 Pro лидирует в GPQA Diamond с 94,3%, незначительно опережая GPT-5.4 с 92,8%, что означает, что модель Google обрабатывает научные вопросы аспирантского уровня с немного более высокой точностью. Однако GPT-5.4 Pro сокращает этот разрыв до 94,4%, что свидетельствует о том, что премиальный тариф OpenAI соответствует возможностям рассуждений Google. На ARC-AGI-2, тестирующем действительно новаторские паттерны рассуждений, которые нельзя решить через запоминание, GPT-5.4 Pro доминирует с 83,3% против 77,1% у Gemini, что указывает на более сильную способность к обобщению при столкновении с незнакомыми типами задач.

Бенчмарки программирования показывают почти паритет с важными нюансами. На SWE-Bench Verified все три модели группируются около 80%, что означает способность решать примерно одинаковую долю реальных задач с GitHub. Различия проявляются в специализированных задачах: GPT-5.3 Codex лидирует на Terminal-Bench 2.0 с 77,3% против 75,1% у GPT-5.4, подтверждая, что Codex сохраняет преимущество в рабочих процессах командной строки даже после выпуска GPT-5.4. На SWE-Bench Pro, тестирующем более сложные многофайловые изменения, GPT-5.4 немного впереди с 57,7% против 56,8% у GPT-5.3 и 54,2% у Gemini.

Управление компьютером и агентные возможности представляют собой наиболее существенное различие. Результаты GPT-5.4 — 75,0% на OSWorld и 83,0% на GDPval — не имеют аналогов, поскольку ни GPT-5.3, ни Gemini 3.1 Pro не предлагают нативных возможностей управления компьютером. Если ваш рабочий процесс включает автоматизацию настольных приложений, навигацию по сложным веб-интерфейсам или координацию множества программных инструментов, GPT-5.4 в настоящее время является единственным жизнеспособным вариантом среди этих трёх моделей. Тем временем Gemini 3.1 Pro лидирует в MCP Atlas (координация инструментов) с 69,2% против 67,2% у GPT-5.4, что свидетельствует о том, что модель Google немного лучше справляется со структурированными конвейерами вызова инструментов.

Итог по бенчмаркам: GPT-5.4 побеждает в 5 категориях (интеллектуальная работа, управление компьютером, продвинутое программирование, мультимодальность, мультиинструментальность), Gemini 3.1 Pro побеждает в 4 (научные рассуждения, стандартное программирование, веб-просмотр, координация инструментов), а GPT-5.3 Codex побеждает в 1 (терминальные задачи). Ни одна модель не доминирует.

Детальный анализ цен — реальная стоимость каждой модели

Понимание ценообразования фронтирных моделей в 2026 году выходит далеко за рамки сравнения тарифов на входные и выходные токены. Доплаты за длинный контекст, скидки на кэшированные токены и тарифы пакетной обработки создают сложный ландшафт затрат, где самая дешёвая модель на бумаге может оказаться не самой дешёвой для вашей реальной рабочей нагрузки.

Базовые цены и тарифы для длинного контекста

Следующая таблица показывает полную картину ценообразования, включая как базовые тарифы, так и доплаты за длинный контекст, которые многие обзоры полностью упускают.

| Модель | Вход / 1M токенов | Выход / 1M токенов | Длинный контекст (вход) | Длинный контекст (выход) |

|---|---|---|---|---|

| Gemini 3.1 Flash-Lite | $0,25 | $1,50 | Н/Д | Н/Д |

| GPT-5.3 Instant | ~$0,30 | ~$1,20 | Н/Д | Н/Д |

| GPT-5.3 Codex | $1,75 | $14,00 | Н/Д | Н/Д |

| Gemini 3.1 Pro | $2,00 | $12,00 | $4,00 (>200K) | $18,00 (>200K) |

| GPT-5.4 | $2,50 | $15,00 | $5,00 (>272K) | $22,50 (>272K) |

| GPT-5.4 Pro | $30,00 | $180,00 | Н/Д | Н/Д |

Разница между самым дешёвым вариантом (Gemini 3.1 Flash-Lite по $0,25/M вход) и самым дорогим (GPT-5.4 Pro по $30,00/M вход) составляет ошеломляющие 120 раз. Это означает, что запуск одного и того же промпта через GPT-5.4 Pro стоит в 120 раз больше, чем через Flash-Lite. Для команд, обрабатывающих миллионы токенов ежедневно, эта разница выливается в тысячи долларов в месяц. Доплаты за длинный контекст заслуживают особого внимания, потому что многие команды сталкиваются с ними неожиданно. GPT-5.4 удваивает стоимость входных данных с $2,50 до $5,00 за миллион токенов, когда промпт превышает 272 000 токенов, а стоимость выходных данных возрастает с $15,00 до $22,50. Gemini 3.1 Pro аналогично увеличивает тариф с $2,00 до $4,00 за миллион входных токенов после 200 000, а выходные — с $12,00 до $18,00. Если вы регулярно работаете с большими кодовыми базами, объёмными документами или обширными историями переписки, эти доплаты могут удвоить ваши реальные затраты на API и фундаментально изменить то, какая модель предлагает лучшее соотношение цена-качество для вашего конкретного паттерна использования.

Сценарии реальных затрат

Чтобы перевести эти цифры в практическую плоскость, рассмотрим три типичных паттерна использования, представляющих разные масштабы операций. Индивидуальный разработчик, выполняющий 100 запросов на кодирование в день, каждый из которых в среднем содержит 2 000 входных и 1 000 выходных токенов, потратит примерно $0,52 в месяц на GPT-5.3 Codex, $0,42 на Gemini 3.1 Pro или $0,53 на GPT-5.4. При таком масштабе разница в стоимости пренебрежимо мала, и именно возможности модели, а не цена, должны определять ваш выбор. Вы можете запускать все три модели одновременно менее чем за $2 в месяц, поэтому индивидуальным разработчикам следует сосредоточиться на поиске модели, дающей наилучший результат для конкретных задач, а не на оптимизации затрат.

Для команды среднего размера, обрабатывающей 10 миллионов входных и 2 миллиона выходных токенов в день, ежемесячные расходы существенно различаются: GPT-5.3 Codex — около $1 365/месяц, Gemini 3.1 Pro — около $1 320/месяц, GPT-5.4 — около $1 650/месяц. При таком объёме более низкая цена выходных токенов Gemini начинает создавать реальную экономию, особенно для приложений с длинными ответами. Разрыв в $330/месяц между Gemini и GPT-5.4 может показаться скромным, но за год он составляет почти $4 000 — достаточно, чтобы профинансировать значительную часть бюджета на облачную инфраструктуру команды.

Операции корпоративного масштаба, обрабатывающие 100 миллионов токенов ежедневно, стоят перед самым жёстким выбором. При таком объёме разница между Gemini 3.1 Pro ($40 800/месяц) и GPT-5.4 ($52 500/месяц) составляет почти $140 000 в год. Платформы вроде laozhang.ai, агрегирующие API различных моделей, могут помочь оптимизировать расходы путём маршрутизации разных типов запросов к наиболее экономичной модели, потенциально экономя 20-30% благодаря интеллектуальному выбору модели. Оптимизация затрат становится ещё более значительной при учёте пакетных и кэшированных тарифов: OpenAI предлагает скидку примерно 50% на кэшированные входные данные для повторяющихся промптов и 50% на пакетную обработку API для задач, не требующих мгновенного ответа, а Google предоставляет аналогичные скидки на кэширование контекста для приложений Gemini, многократно обращающихся к одним и тем же документам.

Скрытые факторы затрат, которые упускают большинство обзоров

Помимо основных ценовых показателей, на реальные затраты влияет ряд факторов, которые редко упоминаются в сравнительных статьях. Стоимость выходных токенов часто является доминирующей статьёй расходов, потому что фронтирные модели склонны генерировать многословные ответы, а выходные токены стоят в 5-8 раз дороже входных у всех провайдеров. Запрос, стоящий $0,005 за входные токены, может обойтись в $0,03-0,04 за выходные, что означает, что соотношение выходных и входных данных кардинально влияет на то, какая модель окажется дешевле для вашего приложения. Приложения, требующие кратких ответов (классификация, извлечение данных, решения «да/нет»), обнаружат, что затраты относительно похожи, тогда как приложения, требующие длинных текстов (отчёты, документация, код), выиграют от тарифа Gemini на выходные данные в $12,00/M по сравнению с $15,00/M у GPT-5.4.

Лимиты частоты запросов также налагают скрытые затраты через вынужденное усложнение архитектуры. Если ваше приложение часто упирается в лимиты, вам придётся либо реализовывать системы очередей, либо приобретать доступ более высокого уровня, либо распределять трафик между несколькими API-ключами. Для приложений, допускающих обработку не в реальном времени, пакетные API предлагают самую эффективную оптимизацию затрат — фактически вдвое снижая стоимость токена на обеих платформах. Команды, которые ещё не оценили пакетную обработку для своих неинтерактивных задач, упускают значительную экономию.

GPT-5.3 vs GPT-5.4 — стоит ли обновляться?

Для команд, уже использующих GPT-5.3 Codex в продакшене, запуск GPT-5.4 ставит немедленный вопрос: стоит ли обновляться? Ответ целиком зависит от того, какие возможности вы реально используете и решает ли GPT-5.4 проблемы, с которыми вы сейчас сталкиваетесь.

Что GPT-5.4 добавляет по сравнению с GPT-5.3

Наиболее значительное дополнение — нативная возможность управления компьютером. GPT-5.4 может работать с настольными приложениями, навигировать в веб-браузерах, заполнять формы и координировать многоэтапные рабочие процессы между программными инструментами, набирая 75,0% на OSWorld. У GPT-5.3 нет эквивалентной возможности, что означает: если ваш сценарий использования включает любую форму автоматизации рабочего стола или веб-взаимодействия, GPT-5.4 — это необходимое обновление, а не опциональное.

GPT-5.4 также представляет значительно больший лимит выходных данных. С максимальным выходом в 128K токенов по сравнению со стандартным лимитом GPT-5.3, GPT-5.4 может генерировать целые кодовые базы, комплексные отчёты или объёмные документы за один вызов API. Для приложений, требующих генерации длинных текстов — инструментов документации, генераторов кода или составителей отчётов — эта расширенная выходная ёмкость устраняет необходимость в цепочках многоходовой генерации.

Производительность в интеллектуальной работе значительно улучшилась. GPT-5.4 набирает 83,0% на GDPval — это первая модель, превзошедшая экспертов-людей на этом бенчмарке. Для корпоративных приложений, связанных с синтезом исследований, комплексным анализом или рассуждениями по множеству источников, это представляет качественное повышение надёжности результатов.

Где GPT-5.3 всё ещё выигрывает

Терминальные и CLI-рабочие процессы остаются сильнейшей областью GPT-5.3 Codex. Его результат 77,3% на Terminal-Bench против 75,1% у GPT-5.4 может показаться небольшим разрывом, но на практике GPT-5.3 Codex был специально создан для терминальных сред. Он понимает семантику оболочки, соглашения менеджеров пакетов и конфигурации систем сборки на более глубоком уровне, потому что его обучение и тонкая настройка были сфокусированы именно на этих рабочих процессах. Если ваш основной сценарий использования — разработка в терминале, нет убедительной причины переходить на GPT-5.4.

Ценообразование также благоприятствует сохранению GPT-5.3. При $1,75 за миллион входных токенов против $2,50 GPT-5.3 Codex стоит на 30% дешевле за входной токен. Для высоконагруженных приложений для программирования, обрабатывающих тысячи промптов ежедневно, эта 30-процентная экономия накапливается в значительное снижение расходов со временем. Учитывая, что результаты SWE-Bench Verified по сути одинаковы (~80% для обеих моделей), вы получаете сопоставимое качество генерации кода по более низкой цене.

Структура принятия решения об обновлении

Обновляйтесь до GPT-5.4, если: вам нужны возможности управления компьютером или автоматизации рабочего стола, ваше приложение генерирует очень длинные ответы (>32K токенов), вам нужны максимально сильные рассуждения для интеллектуальной работы, или вы создаёте агентные рабочие процессы, координирующие множество инструментов и приложений.

Оставайтесь на GPT-5.3 Codex, если: ваша основная нагрузка — разработка в терминале, экономия средств — критически важное ограничение, вам не нужны возможности управления компьютером, или ваши текущие результаты удовлетворяют требованиям качества и вы хотите избежать рисков миграции.

Рассмотрите использование обеих моделей: многие команды используют GPT-5.3 Codex для запросов на программирование и GPT-5.4 для сложных рассуждений и агентных задач. Использование сервиса агрегации API, поддерживающего обе модели, может упростить эту мультимодельную стратегию.

Сравнение API-функций и опыта разработчика

Помимо чистой производительности, практический опыт интеграции этих моделей в приложения различается по важным параметрам. Контекстные окна, лимиты частоты запросов, форматы вывода и специальные функции — всё это влияет на то, какая модель подходит для вашей архитектуры.

Контекстные окна и лимиты вывода

| Параметр | GPT-5.4 | GPT-5.3 Codex | Gemini 3.1 Pro |

|---|---|---|---|

| Максимальный контекст | 1 050 000 токенов | 400K-1M токенов | 2 000 000 токенов |

| Максимальный вывод | 128 000 токенов | Стандартный | 64 000 токенов |

| Порог длинного контекста | 272K токенов | - | 200K токенов |

| Дата отсечки знаний | 31 августа 2025 | - | - |

Контекстное окно Gemini 3.1 Pro на 2 миллиона токенов почти вдвое превышает ёмкость GPT-5.4 и представляет его сильнейшее техническое преимущество. Для приложений, которым необходимо обрабатывать целые кодовые базы, объёмные юридические документы или обширные истории переписки, эта дополнительная ёмкость контекста — не просто приятное дополнение; она фундаментально меняет то, что возможно в рамках одного вызова API. Кодовая база полнофункционального приложения, которая могла бы потребовать разбивки на части и множественных вызовов с GPT-5.4, может полностью поместиться в контекстном окне Gemini, обеспечивая более связный анализ и генерацию. Если вы работаете с лимитами частоты запросов Gemini API, понимание ограничений пропускной способности наряду с этими контекстными окнами необходимо для планирования продакшена.

Лимит вывода GPT-5.4 в 128K — самый большой среди этих моделей, позволяющий генерировать целые файлы, комплексную документацию или детальные многосекционные отчёты без необходимости промптов-продолжений. Это особенно ценно для задач генерации кода, где разбиение вывода на несколько вызовов API может привести к несогласованностям или потере контекста.

Специальные возможности

Управление компьютером GPT-5.4 представляет уникальную возможность, которой в настоящее время нет ни у одного конкурента. Через API GPT-5.4 может получать скриншоты, идентифицировать элементы UI, генерировать клики мышью и ввод с клавиатуры, а также навигировать по сложным многоэтапным рабочим процессам в настольных и веб-приложениях. Это открывает новую категорию приложений, включая автоматизированное тестирование, заполнение форм, извлечение данных из устаревших систем и автоматизацию рабочих процессов между приложениями.

Gemini 3.1 Deep Think обеспечивает нативное пошаговое рассуждение, которое можно активировать через API. При включении модель тратит дополнительные вычислительные ресурсы на сложные задачи, жертвуя задержкой ради точности. Это особенно эффективно для математических доказательств, научных рассуждений и многоэтапных логических выводов, где модели выгодно «продумать» задачу шаг за шагом.

Терминальная интеграция GPT-5.3 Codex предлагает оптимизированные API для терминальных рабочих процессов, включая генерацию shell-команд, отладку систем сборки и управление пакетами. Модель понимает форматы вывода терминала и может интеллектуально выстраивать цепочки команд, что делает её идеальной для разработки CLI-инструментов и приложений для повышения продуктивности разработчиков.

Совместимость API и миграция

Все три модели поддерживают стандартные API чат-завершений с форматом сообщений system/user/assistant, что делает базовую миграцию между провайдерами несложной для стандартных сценариев использования. Если ваше приложение использует только взаимодействие «текст на вход — текст на выход» с системными промптами и историей переписки, переключение между GPT-5.4, GPT-5.3 Codex и Gemini 3.1 Pro требует минимальных изменений кода, помимо обновления конечной точки API и идентификатора модели. Эта совместимость означает, что команды могут экспериментировать со всеми тремя моделями, используя существующую архитектуру приложения, прежде чем выбрать основного провайдера.

Однако специализированные функции, такие как управление компьютером (GPT-5.4), расширенное мышление (Gemini 3.1) и оптимизация терминала (GPT-5.3), используют специфичные для провайдера параметры API, которые не переносятся напрямую между платформами. API управления компьютером GPT-5.4 требует отправки скриншотов в виде изображений в формате base64 и парсинга структурированных ответов с действиями, чему нет эквивалента в API Gemini. Аналогично, режим Deep Think от Gemini использует специфичные для Google параметры конфигурации для управления глубиной рассуждений и бюджетом токенов. Команды, рассматривающие мультимодельные стратегии, должны создавать абстрактные слои, обрабатывающие специфичные для провайдера функции и при этом поддерживающие единый интерфейс для стандартных чат-операций. Эти архитектурные инвестиции быстро окупаются, потому что позволяют маршрутизировать разные типы запросов к оптимальной модели без необходимости изменений на уровне приложения каждый раз, когда вы хотите протестировать новую модель или скорректировать логику маршрутизации.

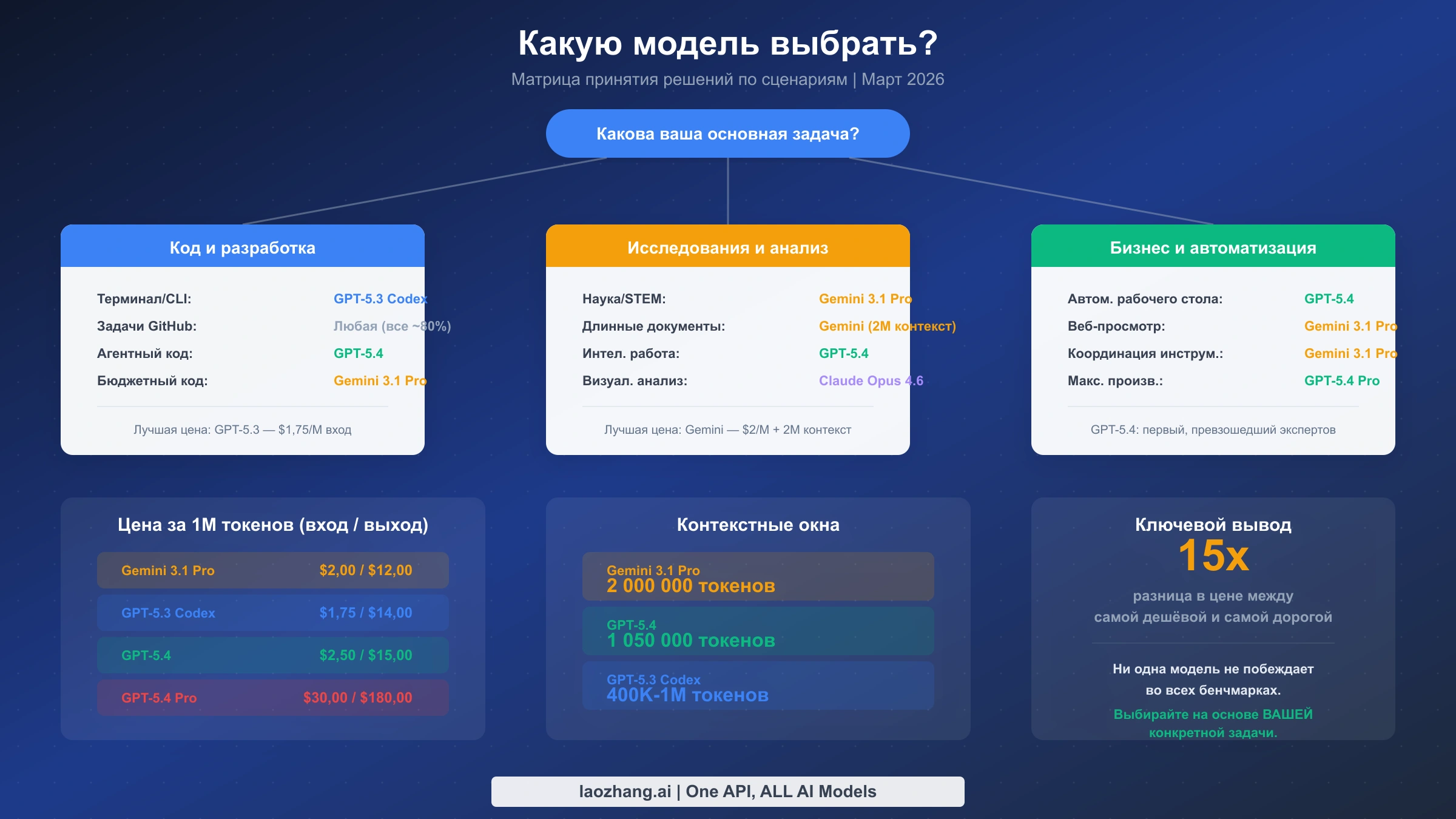

Какая модель для какой задачи — матрица принятия решений

Вместо того чтобы объявлять одну «лучшую» модель, наиболее полезный подход — сопоставление конкретных рабочих задач с моделью, которая справляется с ними лучше всего. Матрица принятия решений ниже охватывает наиболее распространённые сценарии использования, организованные по типу рабочего процесса, и даёт чёткую рекомендацию для каждого сценария на основе данных бенчмарков и анализа ценообразования из предыдущих разделов.

Программирование и разработка — самая конкурентная категория, где все три модели показывают сильные результаты, но преуспевают в разных поддоменах. Для терминальной и CLI-разработки GPT-5.3 Codex остаётся лучшим выбором, потому что его результат 77,3% на Terminal-Bench отражает целенаправленную оптимизацию для сред оболочки, а при $1,75/M входных токенов он предлагает лучшее соотношение цена-качество для высоконагруженных задач программирования. Для агентных задач программирования, включающих многофайловые изменения, рефакторинг на уровне проекта или генерацию кода с написанием тестов, GPT-5.4 выходит вперёд с 57,7% на SWE-Bench Pro и лимитом вывода в 128K, позволяющим генерировать полные реализации за один ответ. Для бюджетного программирования, где стоимость важнее пиковой производительности, Gemini 3.1 Pro за $2,00/M входных данных обеспечивает сопоставимые результаты SWE-Bench (80,6%) по конкурентной цене, а Gemini 3.1 Flash-Lite за $0,25/M входных данных предоставляет адекватное качество для простых задач программирования за долю стоимости. Практический вывод: большинству команд разработки следует поддерживать как минимум две интеграции моделей — GPT-5.3 Codex для повседневной терминальной работы и GPT-5.4 или Gemini для более сложных многофайловых задач.

Исследования и анализ — область, где Gemini 3.1 Pro устанавливает своё самое явное преимущество благодаря сочетанию возможностей рассуждения и ёмкости контекста. Для научных и STEM-исследований результат Gemini 94,3% на GPQA Diamond делает его безоговорочным лидером, особенно в сочетании с контекстным окном на 2 миллиона токенов, способным вместить целые научные статьи, наборы данных или комплексные обзоры литературы в одном промпте. Для анализа длинных документов — юридических контрактов, нормативных документов или обширной технической документации — преимущество контекста Gemini является решающим, потому что вы можете обработать документы до 2 миллионов токенов за один вызов, тогда как GPT-5.4 ограничивается 1,05 миллиона. Это означает, что 500-страничный юридический документ, требующий разбивки на части и множественных API-вызовов с GPT-5.4, может быть проанализирован целостно с Gemini, обеспечивая более связный и контекстуально осведомлённый анализ. Для общей интеллектуальной работы и комплексного многоисточникового анализа результат GPT-5.4 83,0% на GDPval демонстрирует превосходные способности к рассуждению, особенно в задачах, требующих синтеза информации из нескольких областей, где глубокое контекстуальное понимание перевешивает объём контекста.

Корпоративные задачи и автоматизация — категория, где GPT-5.4 имеет наиболее очевидное преимущество благодаря своим уникальным возможностям управления компьютером. Для автоматизации рабочего стола GPT-5.4 — единственная из трёх моделей с нативной возможностью, набирающая 75,0% на OSWorld. Если вашему предприятию нужно автоматическое заполнение форм, кросс-приложенческие рабочие процессы или взаимодействие с устаревшими системами через графические интерфейсы, GPT-5.4 — это необходимость, а не предпочтение, потому что ни одна другая модель в этом сравнении не может управлять настольными приложениями через скриншоты и UI-взаимодействие. Для веб-просмотра и извлечения данных Gemini 3.1 Pro набирает 85,9% на BrowseComp, превосходя 82,7% у GPT-5.4, что делает его лучшим выбором для задач сбора информации в масштабе веба. Для координации инструментов в многоэтапных агентных конвейерах со структурированным вызовом функций Gemini лидирует с 69,2% на MCP Atlas против 67,2% у GPT-5.4, что свидетельствует о немного лучшей оркестрации сложных инструментов моделью Google. Для максимальной производительности независимо от стоимости GPT-5.4 Pro за $30/M входных данных показывает наивысшие результаты в рассуждениях (94,4% GPQA) и решении новаторских задач (83,3% ARC-AGI-2), что делает его премиальным выбором для критически важных приложений, где точность оправдывает 12-кратную надбавку по сравнению со стандартным GPT-5.4.

Бюджетные приложения заслуживают особого внимания, потому что 120-кратный разрыв цен между моделями означает, что интеллектуальная маршрутизация может значительно снизить расходы без ущерба для качества. Командам с высоконагруженными, чувствительными к стоимости задачами следует реализовать многоуровневый подход: направлять простые задачи классификации, извлечения и форматирования к Gemini 3.1 Flash-Lite ($0,25/M), стандартные разговорные и умеренно сложные задачи к GPT-5.3 Instant (~$0,30/M), а сложные рассуждения — к наиболее подходящей фронтирной модели в зависимости от типа задачи. Эта стратегия может снизить общие затраты на API на 60-80% по сравнению с использованием одной фронтирной модели для всех задач, потому что подавляющее большинство продакшен-запросов на самом деле не требуют фронтирного уровня интеллекта. Платформы агрегации API, такие как laozhang.ai, упрощают эту мультимодельную маршрутизацию, предоставляя единую конечную точку API, которая автоматически выбирает оптимальную модель на основе сложности запроса и бюджетных ограничений, устраняя необходимость создания и поддержки собственной логики маршрутизации.

Как получить доступ к этим моделям экономично

Доступ к фронтирным ИИ-моделям через официальные API прост, но оптимизация затрат при работе с несколькими провайдерами требует продуманной архитектуры. Каждый провайдер предлагает разные тарифные планы, программы скидок и способы доступа, которые могут существенно повлиять на общие расходы. Хорошая новость — и OpenAI, и Google сделали свои новейшие модели доступными через стандартные конечные точки API с минимальными препятствиями, поэтому технический барьер входа ниже, чем когда-либо.

API-платформа OpenAI предоставляет прямой доступ к GPT-5.4 и GPT-5.3 Codex через стандартную конечную точку чат-завершений на platform.openai.com. Платформа предлагает пакетную обработку API со скидкой примерно 50% для задач, допускающих 24-часовой срок выполнения, что делает её привлекательным вариантом для задач, не требующих мгновенного ответа, — генерации контента, обработки данных или офлайн-анализа. Кэшированные входные токены получают скидку примерно 50% при повторяющихся промптах, что выгодно приложениям с постоянными системными промптами или примерами few-shot. Для команд, оценивающих возможности управления компьютером GPT-5.4, OpenAI предоставляет специализированный API, принимающий скриншоты на вход и возвращающий структурированные команды действий, обеспечивая автоматизацию рабочего стола через удобный программный интерфейс.

Google AI Studio и Vertex AI предоставляют доступ к Gemini 3.1 Pro и Flash-Lite через стандартные конечные точки генеративного ИИ от Google. Бесплатный тариф Google по-прежнему предлагает щедрые лимиты частоты запросов для разработки и тестирования, что делает его наиболее доступным вариантом для индивидуальных разработчиков, исследующих эти модели перед переходом на платное использование. Для продакшен-нагрузок Vertex AI предлагает скидки за обязательства использования и SLA корпоративного уровня, гарантирующие время безотказной работы и предоставляющие выделенные каналы поддержки. Функция кэширования контекста Gemini заслуживает особого упоминания, потому что она может значительно снизить затраты для приложений, многократно обращающихся к одним и тем же базовым документам, инструкциям или системным промптам. Вместо оплаты полного тарифа за одни и те же 100K токенов системного промпта при каждом вызове API, кэширование контекста позволяет оплатить кэшированный контент один раз, а затем обращаться к нему за малую долю стоимости при последующих вызовах.

Для команд, которым нужен доступ к моделям и от OpenAI, и от Google, а также к Claude и другим провайдерам, платформы агрегации API предоставляют единую конечную точку, упрощающую мультимодельные архитектуры. Вместо управления отдельными API-ключами, биллинговыми аккаунтами и SDK для каждого провайдера, сервисы агрегации вроде laozhang.ai позволяют получить доступ ко всем моделям через единый OpenAI-совместимый API, часто по конкурентным тарифам. Такой подход также обеспечивает интеллектуальную маршрутизацию моделей, при которой разные типы запросов автоматически направляются к наиболее экономичной модели, отвечающей требованиям качества. Например, приложение клиентской поддержки может маршрутизировать простые ответы на FAQ через Flash-Lite, техническое решение проблем через GPT-5.3 Codex, а сложные многоэтапные рассуждения через GPT-5.4 — всё через одну конечную точку API. Такая стратегия мультимодельной маршрутизации может снизить общие расходы на 20-40% без ущерба для качества выходных данных по каждому отдельному типу запросов.

Итог — делаем выбор в 2026 году

Ландшафт ИИ-моделей в марте 2026 года предлагает настоящий выбор, а не единственный доминирующий вариант. После анализа 11 бенчмарков, шести тарифных планов и десятков API-функций для GPT-5.4, GPT-5.3 Codex и Gemini 3.1 Pro наиболее ясный вывод состоит в том, что правильная модель целиком зависит от вашей конкретной рабочей нагрузки. Вот итоговая рекомендация, основанная на всём, что рассмотрено в этом руководстве.

Выбирайте GPT-5.4, если вам нужны возможности управления компьютером, максимальная производительность в интеллектуальной работе или наибольшее окно вывода (128K токенов). GPT-5.4 — наиболее универсальная модель в этом сравнении: она лидирует в 5 из 11 категорий бенчмарков, предлагает нативную автоматизацию рабочего стола, которой нет у конкурентов, и обеспечивает сильнейшие рассуждения общего назначения по $2,50/M входных данных. Для предприятий, создающих агентные рабочие процессы с координацией множества инструментов и приложений, GPT-5.4 — явный лидер и первая модель, которая действительно заменяет определённые категории ручной цифровой работы.

Выбирайте GPT-5.3 Codex, если разработка в терминале — ваш основной сценарий использования и экономия средств имеет значение. При $1,75/M входных данных с 77,3% на Terminal-Bench он обеспечивает лучшее соотношение цена-качество для приложений разработческих инструментов. GPT-5.3 Codex был специально создан для командной строки, и даже после выпуска GPT-5.4 он сохраняет преимущество в конкретной области, для которой был спроектирован. Команды, чей весь рабочий процесс вращается вокруг терминальных сред, систем сборки и управления пакетами, получат больше пользы от специализированной оптимизации Codex, чем от более широкого, но менее глубокого охвата задач программирования у GPT-5.4.

Выбирайте Gemini 3.1 Pro, если вам нужен максимальный контекст (2M токенов), сильнейшие научные рассуждения (94,3% GPQA) или лучшее соотношение цена-производительность для задач общего назначения при $2,00/M входных данных. Сочетание самого большого контекстного окна в отрасли, самой низкой стоимости выходных данных среди фронтирных моделей ($12,00/M) и наивысших результатов в научных рассуждениях делает его оптимальным выбором для исследований, анализа документов и любых рабочих процессов, обрабатывающих большие объёмы текста. Бесплатный тариф Google и Flash-Lite по $0,25/M также делают экосистему Gemini наиболее доступной точкой входа для разработчиков, исследующих возможности фронтирного ИИ.

Рассмотрите мультимодельную стратегию для достижения лучших результатов. 120-кратный разрыв в ценах между самой дешёвой моделью (Flash-Lite по $0,25/M) и самой дорогой (GPT-5.4 Pro по $30,00/M) означает, что интеллектуальная маршрутизация запросов между моделями может существенно снизить затраты при сохранении качества для каждого отдельного запроса. Эпоха единственной «лучшей ИИ-модели» окончательно завершена. Победителями в 2026 году станут команды, научившиеся использовать правильную модель для каждой задачи, сопоставляя характеристики нагрузки с сильными сторонами модели, а не полагаясь на одного провайдера для всех задач.

Часто задаваемые вопросы

GPT-5.4 лучше, чем Gemini 3.1 Pro?

GPT-5.4 лидирует в интеллектуальной работе (83,0% GDPval), управлении компьютером (75,0% OSWorld) и продвинутом программировании (57,7% SWE-Bench Pro). Gemini 3.1 Pro лидирует в научных рассуждениях (94,3% GPQA Diamond), веб-просмотре (85,9% BrowseComp) и предлагает большее контекстное окно (2M против 1M токенов) по более низкой цене ($2,00 против $2,50/M входных). Ни одна из них не является универсально лучшей; правильный выбор зависит от того, приоритетнее ли для вас корпоративная автоматизация и интеллектуальная работа (GPT-5.4) или исследования и экономичность (Gemini).

В чём разница между GPT-5.3 и GPT-5.4?

GPT-5.4 добавляет нативные возможности управления компьютером (75% OSWorld), максимальный вывод 128K токенов и более сильную производительность в интеллектуальной работе (83% GDPval). GPT-5.3 Codex сохраняет небольшое преимущество в терминальном программировании (77,3% против 75,1% Terminal-Bench) и стоит на 30% дешевле за входной токен ($1,75 против $2,50/M). GPT-5.4 — лучший выбор для корпоративной автоматизации и агентных рабочих процессов, тогда как GPT-5.3 остаётся оптимальным для разработки в терминале.

Какая ИИ-модель самая дешёвая в 2026 году?

Gemini 3.1 Flash-Lite предлагает самую низкую стоимость — $0,25/M входных токенов и $1,50/M выходных токенов. Среди фронтирных моделей GPT-5.3 Codex ($1,75/M вход) — самая дешёвая, затем Gemini 3.1 Pro ($2,00/M вход), далее GPT-5.4 ($2,50/M вход). GPT-5.4 Pro — самая дорогая модель при $30,00/M входных данных. Использование бесплатных тарифов GPT API может помочь снизить расходы на этапах разработки и тестирования.

Может ли GPT-5.4 управлять компьютером?

Да. GPT-5.4 — первая модель в этом сравнении с нативной возможностью управления компьютером, набравшая 75,0% на OSWorld. Она может делать скриншоты, идентифицировать элементы UI, генерировать клики мышью и ввод с клавиатуры, а также навигировать по многоэтапным рабочим процессам в настольных и веб-приложениях. Ни GPT-5.3, ни Gemini 3.1 Pro в настоящее время не предлагают аналогичных функций управления компьютером через свои API.

Стоит ли использовать несколько ИИ-моделей или ограничиться одной?

Для большинства продакшен-приложений мультимодельная стратегия обеспечивает лучшее сочетание качества и стоимости. Направляйте терминальные задачи программирования к GPT-5.3 Codex, научные рассуждения — к Gemini 3.1 Pro, корпоративную автоматизацию — к GPT-5.4, а простые запросы — к бюджетным моделям вроде Flash-Lite. Такой подход может снизить расходы на 60-80% по сравнению с использованием одной фронтирной модели для всех задач.