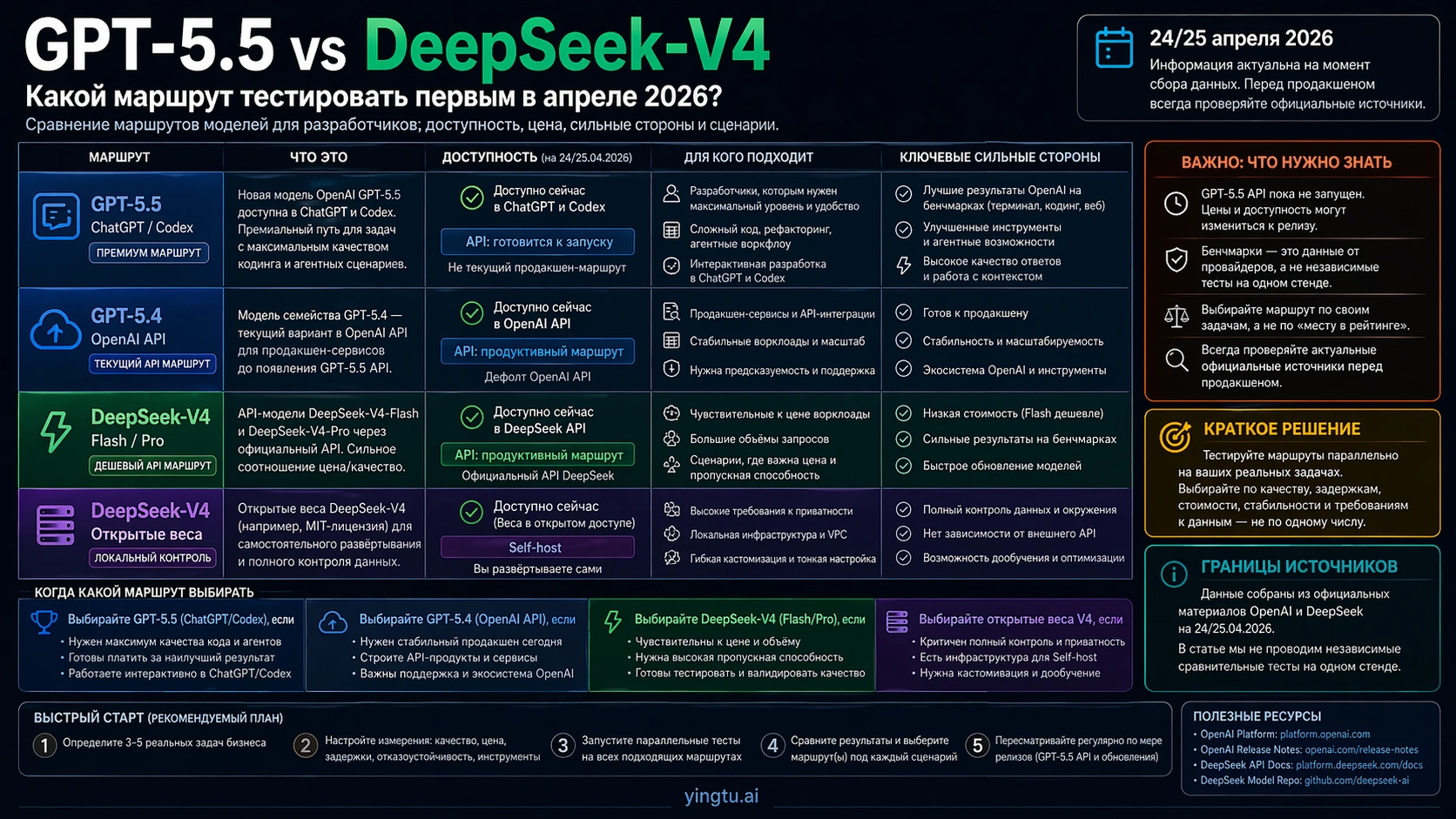

На 24/25 апреля 2026 года GPT-5.5 и DeepSeek-V4 нельзя сравнивать как две одинаковые API-строки. Если работа идет в ChatGPT или Codex, первым тестируйте GPT-5.5. Если уже нужно выпускать OpenAI API-пайплайн, держите GPT-5.4 как текущую базу. Если важны стоимость API, 1M контекста, self-hosting или открытые веса, первым тестом становится DeepSeek-V4-Flash или DeepSeek-V4-Pro.

| Маршрут | Когда тестировать первым | Когда не спешить |

|---|---|---|

| GPT-5.5 в ChatGPT/Codex | Нужен самый сильный OpenAI-native опыт для кода, агентных задач и рассуждений. | Нужна обычная производственная API-модель уже сегодня. |

| GPT-5.4 в OpenAI API | Приложение уже строится на OpenAI API и нужен стабильный доступный baseline. | Вы оцениваете следующую frontier-модель и можете ждать GPT-5.5 API. |

| DeepSeek-V4-Flash или V4-Pro API | Нужны низкая стоимость, длинный контекст или проверка DeepSeek-стека. | Нужны OpenAI-native инструменты, поддержка предприятия или уже проверенная база качества. |

| Открытые веса DeepSeek-V4 | Нужны локальный контроль, MIT-лицензия, приватность или self-hosted эксперименты. | Нет команды для inference-инфраструктуры, MLOps и мониторинга. |

Бенчмарки полезны как карта тестов, но опасны как универсальный ярлык победителя. Перед заменой трафика прогоните те же задачи через выбранные маршруты и измерьте качество, задержку, стоимость, поведение tools, восстановление после ошибок и границы данных.

Практический ответ: сначала маршрут, потом победитель

Русскоязычные обсуждения быстро уходят в формулу "OpenAI дорого, Китай демпингует". В стоимости действительно есть большой разрыв, но для разработчика этого мало. Вопрос не в том, кто звучит громче в заголовке, а в том, какой маршрут можно использовать сейчас, что можно поставить в продакшен, а что пока должно оставаться гипотезой.

GPT-5.5 сегодня ценен прежде всего внутри OpenAI-продуктов. Codex, ChatGPT, аккаунт, интеграции, review-петля и модель работают как один опыт. DeepSeek-V4 силен другим: дешевый hosted API, раздельные Flash/Pro варианты, длинный контекст, открытые веса и возможность локального контроля. Это не симметричная замена одной строки на другую.

Первые тесты можно разложить так:

| Задача | Первый маршрут | Почему |

|---|---|---|

| Кодинг и agent workflow в Codex | GPT-5.5 | Модель оценивается вместе с продуктовой средой OpenAI. |

| Производственный OpenAI API | GPT-5.4 | Это текущая API-база до появления GPT-5.5 в live API docs. |

| Массовая классификация, извлечение, суммаризация | DeepSeek-V4-Flash | Цена позволяет добавить проверки и retry без взрывного счета. |

| Сложный код, рассуждение, long-context синтез | DeepSeek-V4-Pro | Это более сильный DeepSeek-маршрут при все еще низкой цене. |

| Локальная инфраструктура и приватность | DeepSeek-V4 open weights | Контроль важнее удобства hosted API. |

Главная ошибка - сравнивать GPT-5.5 API с DeepSeek-V4 API так, будто оба маршрута уже одинаково доступны. Пока OpenAI не показывает GPT-5.5 как обычную API-модель, разработчику нужна четырехполосная схема: GPT-5.5 для ChatGPT/Codex, GPT-5.4 для OpenAI API сегодня, DeepSeek hosted API для цены и DeepSeek open weights для локального контроля.

Доступность и цена: что можно использовать сейчас

Анонс GPT-5.5 от OpenAI описывает модель как новый премиальный слой для ChatGPT и Codex. Там же указаны будущие цены API, но руководство OpenAI по latest models на 24/25 апреля 2026 года все еще оставляет GPT-5.4 текущим OpenAI API маршрутом. Поэтому GPT-5.5 сейчас можно планировать как сильный продуктовый маршрут, но нельзя обещать как обычный API production target.

У DeepSeek другая картина. В официальной странице pricing уже есть deepseek-v4-flash и deepseek-v4-pro. Документация также описывает OpenAI-compatible и Anthropic-compatible endpoint patterns, что снижает стоимость первого интеграционного теста. Alias вроде deepseek-chat и deepseek-reasoner могут быть удобны, но production-конфигу лучше фиксировать явные V4 ID.

| Маршрут | Текущий статус | Ценовой сигнал на 24/25 апреля 2026 |

|---|---|---|

| GPT-5.5 в ChatGPT/Codex | Доступен в перечисленных OpenAI поверхностях. | Подписка или workspace-доступ, не обычный token billing. |

| GPT-5.5 API | Объявлен как coming soon. | Будущая цена: $5 input и $30 output за 1M tokens. |

| GPT-5.5 Pro API | Объявлен как coming soon. | Будущая цена: $30 input и $180 output за 1M tokens. |

| GPT-5.4 API | Текущий OpenAI API fallback. | Проверять по текущим OpenAI docs перед релизом. |

| DeepSeek-V4-Flash API | Есть в DeepSeek API docs. | Cache hit $0.028, cache miss $0.14, output $0.28 за 1M tokens. |

| DeepSeek-V4-Pro API | Есть в DeepSeek API docs. | Cache hit $0.145, cache miss $1.74, output $3.48 за 1M tokens. |

| DeepSeek-V4 open weights | Есть official model-card artifacts. | Token price заменяется GPU, serving, monitoring и staff time. |

Да, разрыв выглядит драматично. Но цена сама по себе не означает победу. DeepSeek-V4-Flash хорош для задач, где приемка автоматизируется. DeepSeek-V4-Pro нужно тестировать там, где качество важнее минимального тарифа. GPT-5.5 может стоить дороже, но внутри Codex экономить время команды за счет меньшего числа циклов правки и review.

Бенчмарки: источник важнее красивой таблицы

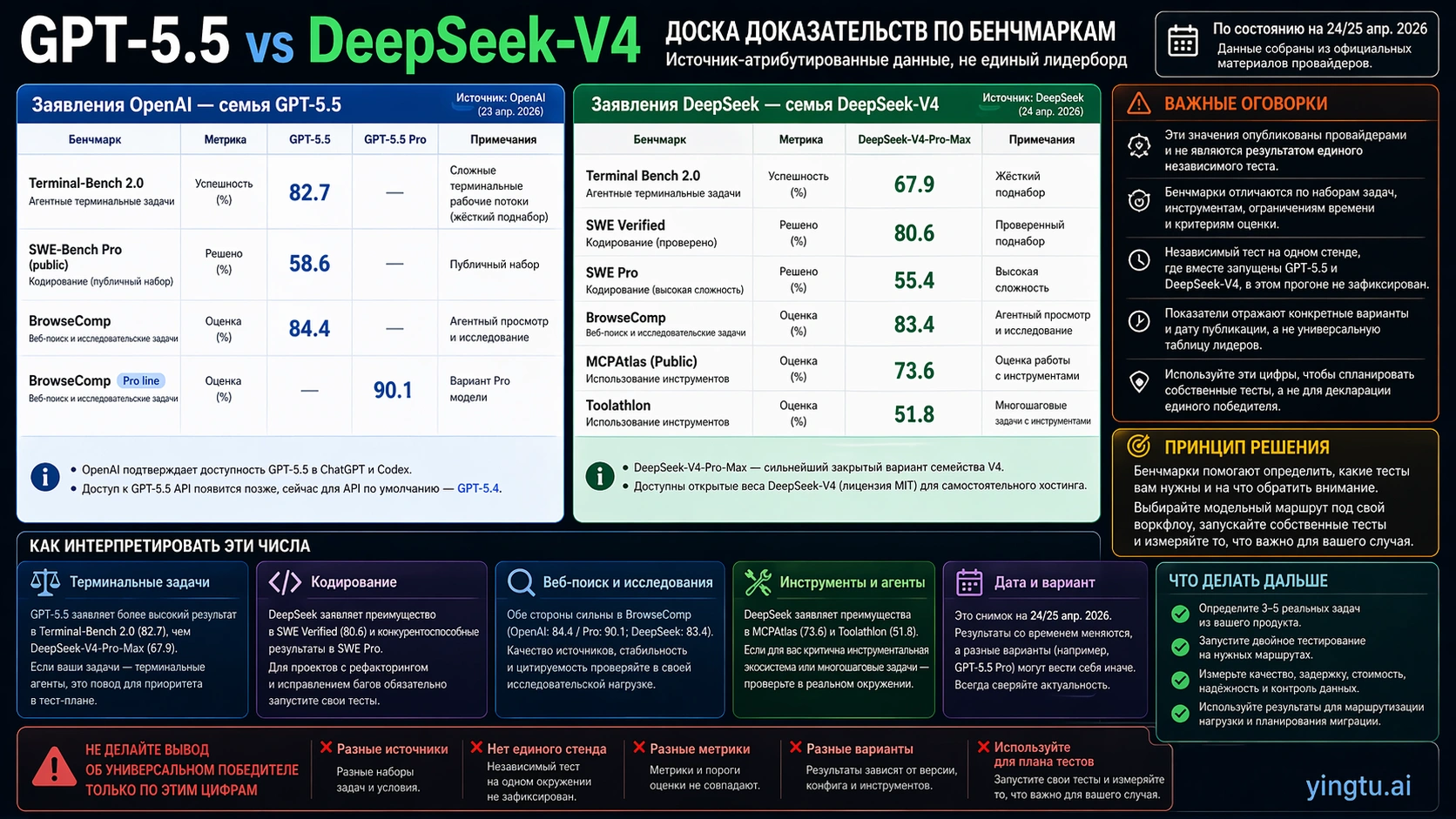

OpenAI публикует для GPT-5.5 сильные результаты по coding, browsing и agentic задачам, включая Terminal-Bench 2.0, SWE-Bench Pro public и BrowseComp. DeepSeek в карточке DeepSeek-V4-Pro публикует собственные строки для DeepSeek-V4-Pro-Max: Terminal-Bench 2.0, SWE Verified, SWE Pro, BrowseComp, MCPAtlas Public и Toolathlon.

Эти данные показывают направление, но не дают единого нейтрального scoreboard. Разные провайдеры, разные окружения, разные режимы мышления и разные tool chains могут менять итог. Поэтому public scores нужно превращать в test plan: какие задачи стоит прогнать, какие метрики собрать, какие провалы считать блокером.

| Область | Что подсказывают публичные строки | Что проверить самому |

|---|---|---|

| Код | GPT-5.5 выглядит сильным в OpenAI-coded workflows; DeepSeek-V4-Pro не выглядит только бюджетной моделью. | Multi-file patch, tests, dependency errors, review effort. |

| Tools и agents | У обеих сторон есть tool/browsing сигналы. | Аргументы функций, retry behavior, recovery после частичного сбоя. |

| Long context | DeepSeek-V4 делает 1M context ключевым предложением; GPT-5.5 API тоже заявлен с 1M context. | Late-context recall, conflicting instructions, real prompt cost. |

| Надежность | Бенчмарки редко показывают p95 latency и rate-limit боль. | Timeout, refusal rate, structured output validity, audit log. |

Если задача - миграция production API, победитель должен считаться по accepted output cost. Это цена только тех ответов, которые прошли проверку, не потребовали ручного ремонта и не создали downstream incident.

Внутри DeepSeek-V4: Flash, Pro или open weights

DeepSeek-V4 нельзя сводить к одной строке. V4-Flash - первый кандидат для больших потоков: извлечение, классификация, короткие ответы, batch summaries, routing, pre-filtering. Он хорош там, где ошибку можно автоматически поймать, а низкая цена позволяет добавить второй проход проверки.

V4-Pro нужен для более тяжелых задач: coding agents, reasoning, multi-step tools, long-context synthesis. Если Flash дает правдоподобные, но хрупкие ответы, Pro становится более честной DeepSeek-проверкой. Его hosted цена выше Flash, но может быть ниже по total cost, если он уменьшает retry и ручной review.

Open weights - это не бесплатный hosted API. Это инфраструктурный проект. Нужно считать GPU, batching, latency, security, upgrades, observability и людей, которые будут держать inference живым. Такой маршрут оправдан, когда privacy, data residency, кастомизация или локальная автономность стоят выше удобства провайдера.

Длинный контекст тоже нужно тестировать жестко. Добавьте отвлекающие документы, поздние факты, конфликтующие требования и проверку цитирования. Модель, которая хорошо отвечает на 20K tokens, может иначе вести себя на 300K tokens.

Рекомендации по рабочим сценариям

Для Codex-first кодинга начинайте с GPT-5.5. Здесь важна связка модели, продукта, task handoff, review, терминального или редакторского workflow. DeepSeek-V4 можно тестировать рядом, но он не заменяет весь Codex experience одной API-строкой.

Для существующего OpenAI API продукта оставайтесь на GPT-5.4 до появления GPT-5.5 в live API docs. Абстрагируйте model routing заранее, но не обещайте пользователям GPT-5.5 API, пока официальный маршрут не открыт.

Для дешевых массовых API задач начинайте с DeepSeek-V4-Flash. Смысл в том, чтобы уменьшить cost per accepted output, а не просто input token price. Если Flash ломает reasoning, format или tools, поднимайте только сложные части на V4-Pro.

Для сложного reasoning и coding вне OpenAI product surface сравнивайте DeepSeek-V4-Pro с GPT-5.4 API сейчас, а затем с GPT-5.5 API после его открытия. Метрики должны быть рабочими: accepted patches, passing tests, valid JSON, tool-call success, human review minutes.

Для приватности и local-control делайте маленький pilot на open weights. Он должен оценивать не только модель, но и операционную готовность команды.

План проверки перед миграцией

Выберите не больше пяти реальных задач: coding repair, long-context answer, structured extraction, tool call, high-volume batch. Для каждой задачи заранее определите input, expected output, scoring rubric, retry policy, failure severity и cost formula.

| Тестовая линия | Когда использовать | Что измерять |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | Product workflow OpenAI важен сам по себе. | Quality, saved human effort, code review result, product fit. |

| GPT-5.4 API | Текущий OpenAI API baseline. | Cost, latency, tool behavior, structured output, regressions. |

| DeepSeek-V4-Flash API | High-volume или cost-sensitive задачи. | Pass rate, retry rate, format validity, cache behavior. |

| DeepSeek-V4-Pro API | Сложные DeepSeek проверки. | Accuracy, reasoning stability, tools, long-context recall. |

| DeepSeek-V4 open weights | Нужен локальный контроль. | GPU cost, throughput, latency, monitoring, security. |

Стоп-правила должны быть написаны до теста. Не мигрируйте маршрут, который ломает JSON, теряет tool arguments, игнорирует late-context evidence, пишет небезопасный код или требует столько ручной проверки, что экономия исчезает. Новый маршрут сначала должен пройти shadow traffic или low-risk batch, а не сразу заменить основной поток.

Часто задаваемые вопросы

GPT-5.5 уже доступен в API?

OpenAI объявила будущий GPT-5.5 API и его цену, но на 24/25 апреля 2026 года текущая API-документация все еще оставляет GPT-5.4 производственной OpenAI API базой. GPT-5.5 нужно считать текущим ChatGPT/Codex маршрутом и будущим API маршрутом.

Что тестировать первым: DeepSeek-V4-Flash или V4-Pro?

Flash подходит для volume, low-risk и automatic acceptance. Pro подходит для reasoning, coding, tools и long context. Open weights выбирайте только если local control важнее hosted convenience.

Низкая цена DeepSeek-V4 автоматически делает его лучше?

Нет. Низкая цена делает тест обязательным, но production value определяется accepted output cost. Учитывайте retry, ручной review, latency и риск сбоя.

Можно ли выбрать победителя по бенчмаркам?

Нет. Публичные строки помогают выбрать задачи для теста. Производственное решение требует одинаковых inputs, одинаковой rubric и одинакового cost accounting.

Когда пересматривать выбор?

Когда GPT-5.5 появится в live OpenAI API docs, когда DeepSeek изменит цены или aliases, когда появятся независимые same-harness результаты, или когда изменится ваш workload. Это маршрутное решение, а не постоянный титул чемпиона.