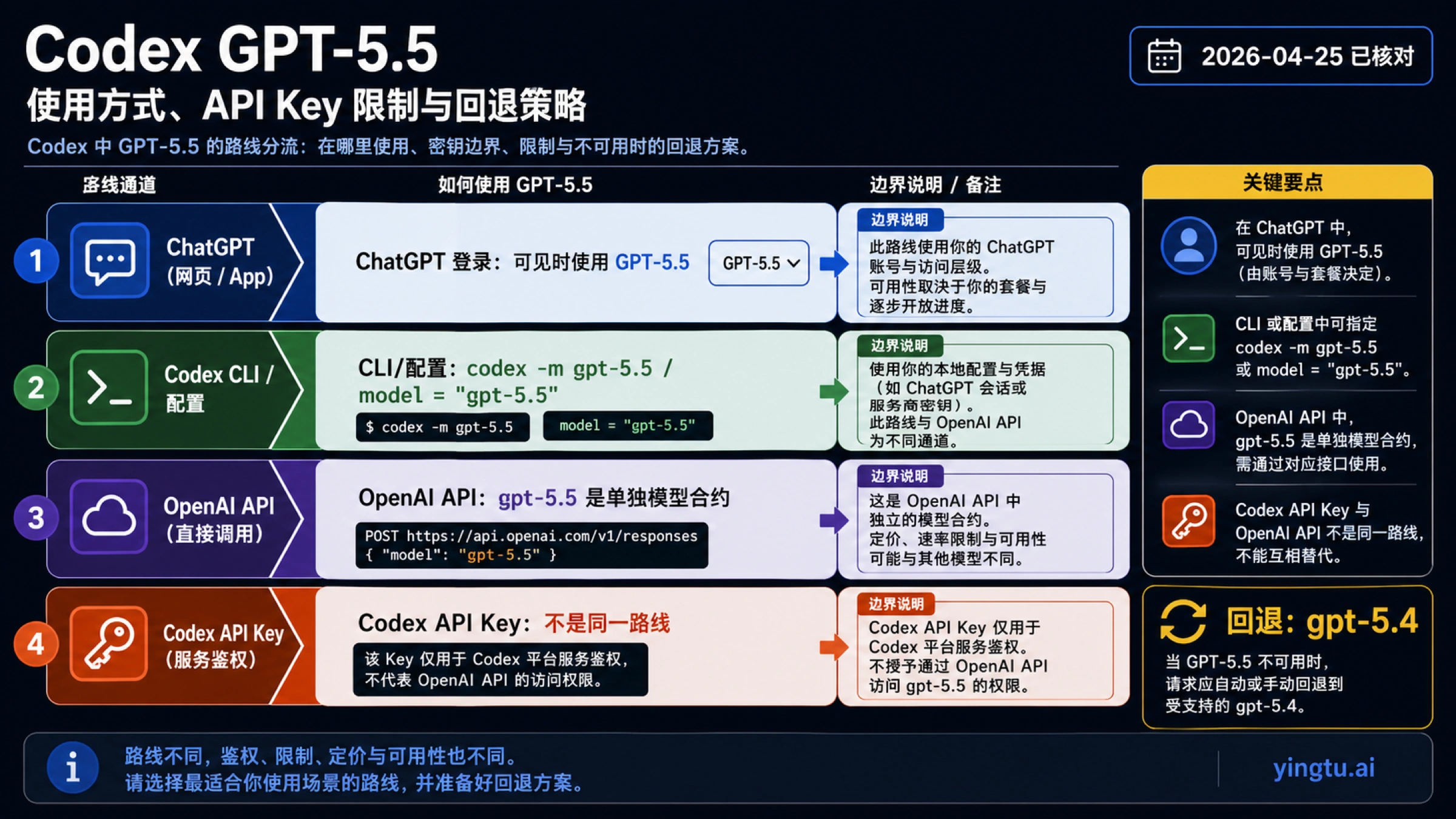

Codex 里怎么用 GPT-5.5:登录路线、API Key 限制和 GPT-5.4 回退

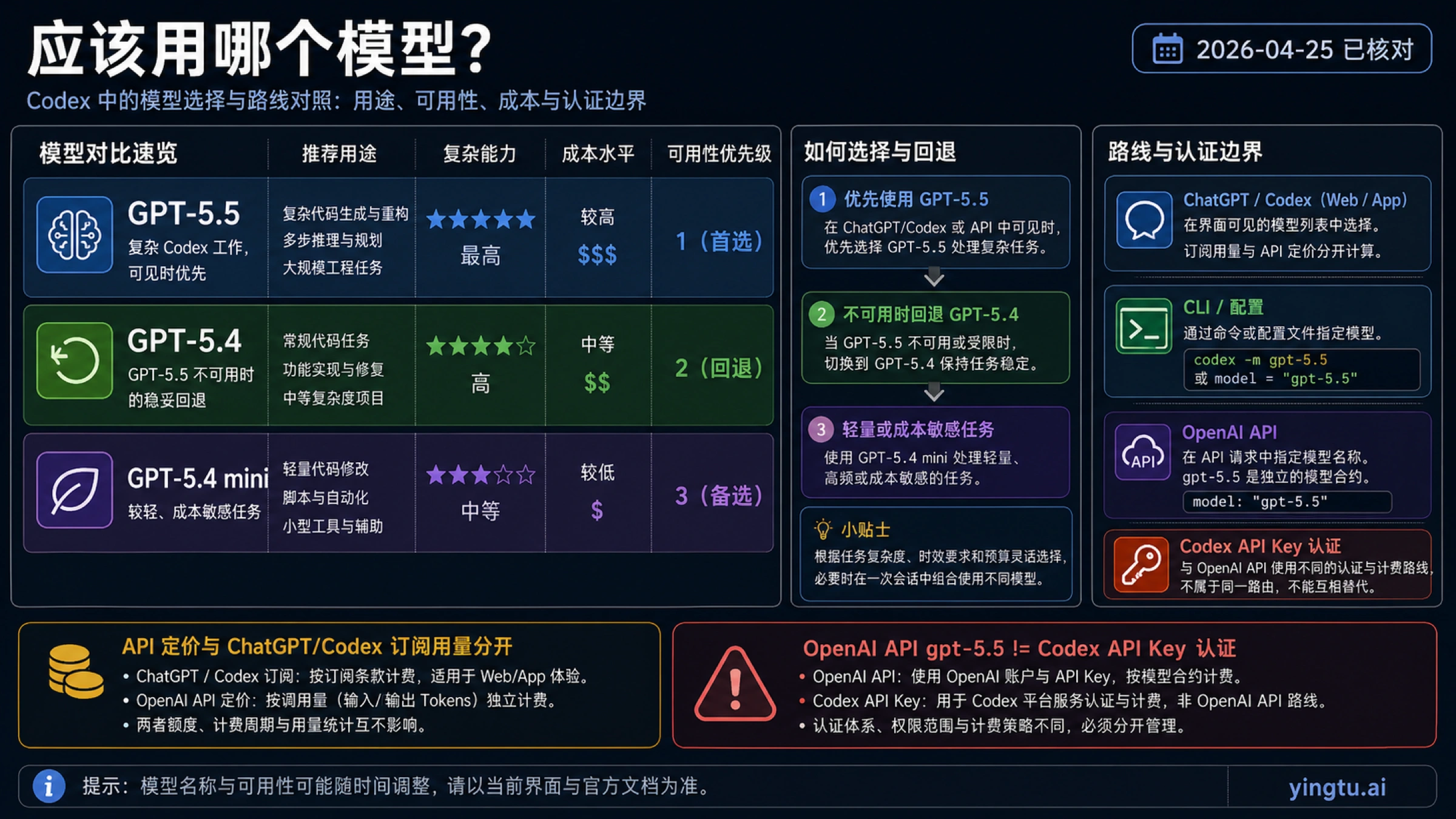

截至 2026 年 4 月 25 日,如果你的 Codex 账号通过 ChatGPT 登录后能看到 GPT-5.5,它就是复杂开发任务最值得先试的模型;但这不等于用 API Key 登录 Codex 也能调用 GPT-5.5。本地可以先试 codex -m gpt-5.5,或在配置中写 model = "gpt-5.5";如果模型不显示、命令被拒绝,先检查登录路线,再回退到 gpt-5.4,不要硬把 API 文档里的模型可用性套到 Codex API Key 认证上。

| 你的问题 | 先走哪条路线 | 排查前先确认什么 |

|---|---|---|

| 想在 Codex 里用最强模型做复杂开发 | 用 ChatGPT 登录 Codex,模型选择器里有 GPT-5.5 时再选它 | 账号、套餐、灰度状态和模型选择器都必须露出 GPT-5.5。 |

| 想在本地 CLI 或配置里指定模型 | codex -m gpt-5.5 或 model = "gpt-5.5" | 官方没有给出最低 CLI 版本时,不要写死版本号;先更新客户端再重试。 |

| 想通过 OpenAI API 调用 GPT-5.5 | 用 OpenAI API 的模型 ID gpt-5.5 和 API 计费规则 | API 计费与 ChatGPT / Codex 套餐用量是两件事。 |

| 想用 API Key 认证跑 Codex | 不要默认 GPT-5.5 一定可用 | 当前 Codex 文档说明 GPT-5.5 不通过 API Key 认证开放。 |

| GPT-5.5 不显示但工作要继续 | 先回退到 gpt-5.4 | gpt-5.4-mini 是轻任务和成本选项,不是复杂任务的质量默认。 |

这件事最容易错在把 OpenAI 的所有入口都当成同一个模型开关。更稳的顺序是:先判断 Codex 登录路线,再试命令和配置,然后看 API 价格,最后再讨论模型强弱。

先弄清:Codex 里的 GPT-5.5 到底是哪条路线

Codex 不是“OpenAI API 有什么模型,它就一定能用什么模型”的薄壳。它有 Web / App、CLI、IDE 扩展、云端任务、ChatGPT 套餐登录、API Key 认证等多个入口。GPT-5.5 可以在 OpenAI API 模型列表里成立,同时仍然在 Codex 的 API Key 认证路线里不可用。

应该以 OpenAI 的 Codex 模型文档 来判断 Codex 行为。该文档把 gpt-5.5 放在推荐模型里,给出 codex -m gpt-5.5 和 model = "gpt-5.5" 的示例,也明确区分了两点:通过 ChatGPT 登录 Codex 时可以使用 GPT-5.5;通过 API Key 认证时当前不提供 GPT-5.5。

这就解释了很多中文社区里的“我看到 API 了,为什么 Codex 还报错”。OpenAI 的 gpt-5.5 API 模型页 说明这个模型可用于 API 端点;Codex 文档则说明 Codex 自身的认证路线限制。两件事都可能同时为真。

还有一个容易忽略的点:Codex Cloud 与本地 CLI 也不是同一个控制面。Codex 文档说明云端默认模型目前不能由用户直接改。也就是说,本地 -m 参数能解决本地会话,不等于它能强行改变云端任务的默认模型。

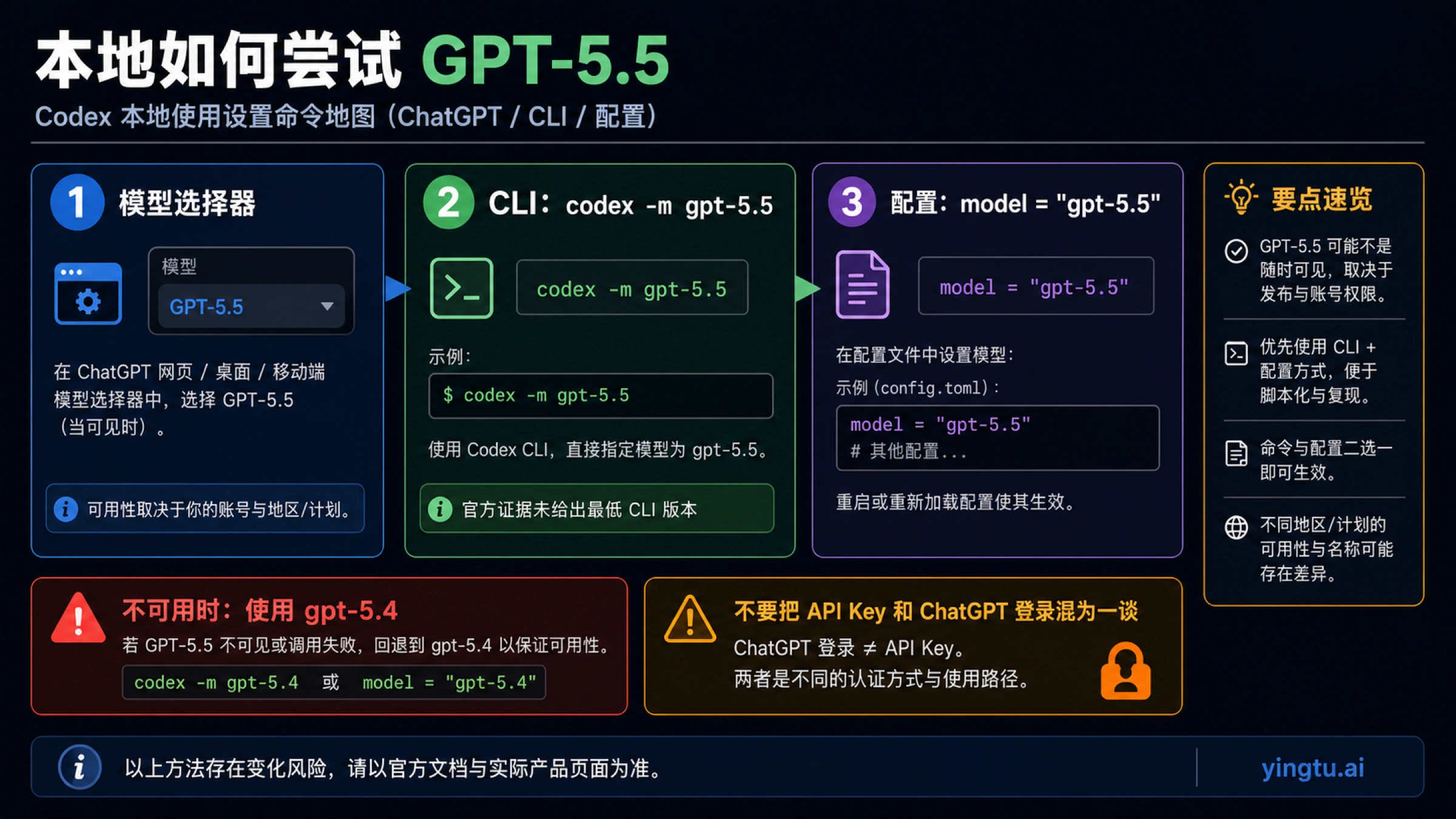

本地怎么试 GPT-5.5

如果你使用 Codex App、IDE 扩展或带模型选择器的本地客户端,先看模型列表。列表里出现 GPT-5.5,再把它用于复杂代码库改动、多文件编辑、难复现 bug、架构判断、前端实现和需要长时间自查的代理任务。

CLI 的直接命令是:

hljs bashcodex -m gpt-5.5

如果你想把本地配置固定到这个模型,按官方文档的形式写:

hljs tomlmodel = "gpt-5.5"

不要把“我本机能看到 -m, --model <MODEL>”写成所有人都必须满足的最低版本。一个客户端能接受模型参数,并不代表另一个账号、套餐、地区灰度、登录方式或客户端构建也一定能用 GPT-5.5。实际排查顺序更简单:更新 Codex,确认使用 ChatGPT 登录,重新打开模型选择器或重跑 CLI 命令,再判断是不是模型不支持。

第一次测试不要直接把所有项目都切过去。更稳的做法是打开一个真实仓库,给 Codex 一个范围明确的多文件任务,看它是否确实以你指定的模型运行。如果命令立刻返回模型不支持、模型元数据缺失或类似错误,就进入下面的路线排查,不要反复改大小写或标点。

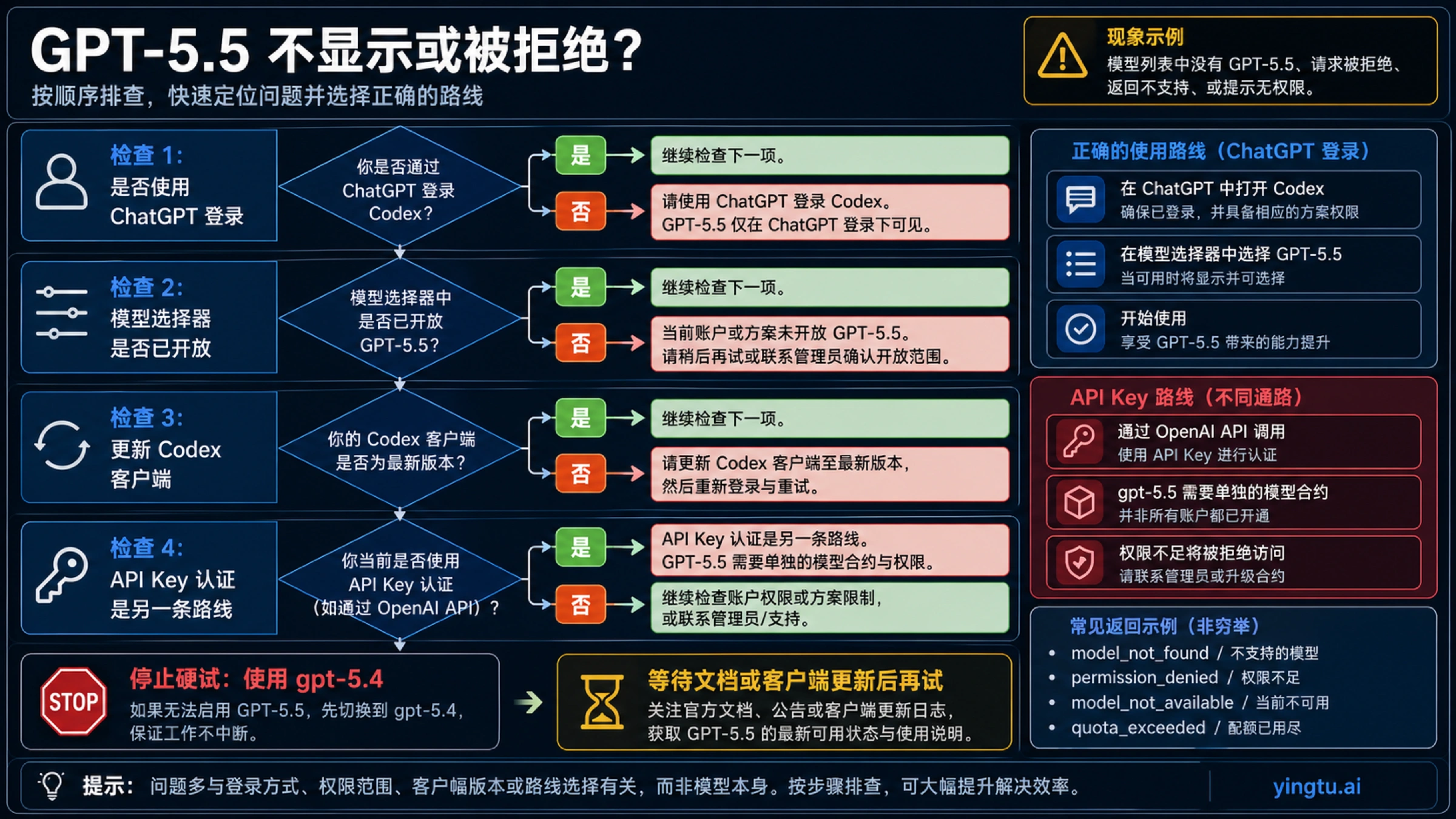

为什么 GPT-5.5 不显示或报错

大多数问题不是“GPT-5.5 存不存在”,而是“你现在站在哪个入口”。实际使用中常见的“升级后可用”“CLI 报错”“API 首日不开放”“怎么强制选择”都在指向同一个排查核心:先分清路线,再改命令。

| 现象 | 更可能的原因 | 第一步怎么做 |

|---|---|---|

| 模型选择器里没有 GPT-5.5 | 账号、套餐、灰度或客户端状态还没有开放 | 更新客户端,用 ChatGPT 重新登录,再看选择器。 |

codex -m gpt-5.5 被拒绝 | 本地这条路线暂时没有模型权限 | 先确认不是 API Key 认证路线,再回退到 gpt-5.4。 |

API 文档有 gpt-5.5,Codex 还是报错 | API 模型可用与 Codex API Key 认证不是一回事 | 不要把 API 文档当成 Codex API Key 支持证明。 |

| 云端 Codex 任务仍用别的模型 | 云端默认模型不等于本地 CLI 选择 | 单独确认 Codex Cloud 当前默认行为。 |

| 任务很轻、成本敏感 | GPT-5.5 未必必要 | 只在低风险任务里用 gpt-5.4-mini。 |

更可靠的恢复路径是:

- 先确认你是 ChatGPT 登录,还是 API Key 认证。

- 看 Codex 模型选择器里是否出现 GPT-5.5。

- 更新 Codex 客户端,再重试选择器或

codex -m gpt-5.5。 - 如果仍然缺失或被拒绝,直接用

gpt-5.4继续工作。 - 只有当任务小、可逆、对成本敏感时,才把

gpt-5.4-mini当成起点。

这能避免两个浪费时间的方向:还没检查官方路线就追社区偏方;或者明明是复杂开发任务,却因为 GPT-5.5 暂时不可用而过早降到 mini 模型。

OpenAI API 可用,不等于 Codex API Key 可用

OpenAI 的 API 模型列表 和 gpt-5.5 模型页 已经列出 GPT-5.5。模型页也列出了 Chat Completions 和 Responses 等端点。这说明 API 层面可以按 API 规则调用 gpt-5.5,但它不改变 Codex 文档里的 API Key 认证限制。

截至 2026 年 4 月 25 日,OpenAI 的 API pricing 页面列出的标准价格是:

| 模型 | 输入 | 缓存输入 | 输出 | 更适合什么 |

|---|---|---|---|---|

gpt-5.5 | $5.00 / 1M tokens | $0.50 / 1M tokens | $30.00 / 1M tokens | API 里最需要质量的复杂推理、编码和代理任务。 |

gpt-5.4 | $2.50 / 1M tokens | $0.25 / 1M tokens | $15.00 / 1M tokens | Codex 回退和成本更低的严肃任务基线。 |

gpt-5.4-mini | $0.75 / 1M tokens | $0.075 / 1M tokens | $4.50 / 1M tokens | 摘要、小改写、分类、抽取和低风险探索。 |

这些价格是 API 计费,不是 ChatGPT 套餐里 Codex 的使用方式。OpenAI Help Center 的 ChatGPT 套餐使用 Codex说明的是套餐和客户端访问;API pricing 说明的是 token 账单。团队可以同时用两种路线,但预算、限制、模型可用性和排查入口都要分开。

还要注意超长上下文价格。OpenAI 的模型页和价格页提到,极长的 GPT-5.5 输入可能进入更高的全会话价格规则。如果你把完整代码库、日志或大型文档塞进 API,不能只看普通价格行。

到底该选 GPT-5.5、GPT-5.4 还是 GPT-5.4 mini

如果路线支持,GPT-5.5 适合先用于复杂工作:跨文件重构、难 bug、架构调整、带很多约束的前端实现、安全敏感改动、需要模型自己计划和自查的代理任务。模型更贵或用量更重时,真正的比较对象不是“单次调用便不便宜”,而是一次失败会不会浪费更多工程时间。

如果 GPT-5.5 在 Codex 里不显示或被拒绝,先用 GPT-5.4。这是 Codex 文档给出的回退方向,比随便换成另一个便宜模型更稳。GPT-5.4 仍然适合认真开发,只是当 GPT-5.5 可用时,它不再是最高质量起点。

GPT-5.4 mini 则适合轻任务:读一个文件、写一个小工具、整理 issue、初步归类、把说明改得更清楚、先低成本探索再升级模型。不要在你本来就因为代码任务困难才打开 Codex 的时候,把 mini 当成默认模型。

| 判断条件 | 选择 |

|---|---|

| ChatGPT 登录可用,GPT-5.5 出现在 Codex 中,任务复杂 | gpt-5.5 |

| GPT-5.5 在 Codex 中缺失或被拒绝 | gpt-5.4 |

| 任务小、可回滚、成本敏感 | gpt-5.4-mini |

| 你要调用 API,而不是使用 Codex 行为 | 按 OpenAI API 模型 ID 和 API 价格规则处理 |

| 你用 API Key 认证跑 Codex | 不要默认 GPT-5.5 可用;查 Codex 文档并准备回退 |

实际操作清单

切换模型前,按这个顺序检查:

- 先判断任务属于 Codex、OpenAI API,还是 ChatGPT 套餐访问。

- 如果是 Codex,确认当前是 ChatGPT 登录还是 API Key 认证。

- 查看 Codex 模型选择器里有没有 GPT-5.5。

- 本地 CLI 先试

codex -m gpt-5.5。 - 需要固定配置时,只在支持路线下写

model = "gpt-5.5"。 - GPT-5.5 不显示或被拒绝时,用

gpt-5.4。 - 只有 API 调用才用 API 价格做成本判断。

- 以后更新文章或团队文档时,重新检查 OpenAI Codex 模型文档和 API 价格。

一句话总结:GPT-5.5 是 Codex 可见时的复杂任务优先模型;如果你的路线不支持它,GPT-5.4 是第一回退;OpenAI API 里能调用 gpt-5.5,不能自动证明 Codex 的 API Key 认证也支持 GPT-5.5。

常见问题

Codex 现在能用 GPT-5.5 吗?

能,但前提是你的 Codex 路线开放了它。OpenAI 的 Codex 模型文档说明,通过 ChatGPT 登录时 GPT-5.5 可用于 Codex,并建议在模型选择器里出现时优先用于大多数 Codex 任务。

CLI 里怎么指定 GPT-5.5?

使用 codex -m gpt-5.5。如果要写入本地配置,用 model = "gpt-5.5"。如果命令被拒绝,先检查登录路线和灰度状态,不要先假设是命令拼写问题。

OpenAI API Key 能解锁 Codex 里的 GPT-5.5 吗?

不能这么理解。Codex 文档把 ChatGPT 登录和 API Key 认证分开,并说明 GPT-5.5 当前不通过 Codex 的 API Key 认证开放。

OpenAI API 里有 gpt-5.5 吗?

有。OpenAI API 模型文档列出了 gpt-5.5,模型页也列出 Chat Completions 和 Responses 等端点。API 可用性要按 API 规则处理,不能拿来覆盖 Codex API Key 限制。

GPT-5.5 不显示时该用什么?

先用 gpt-5.4。这是 Codex 文档给出的回退模型。gpt-5.4-mini 更适合轻量、低风险、成本敏感任务。

能强制 Codex Cloud 使用 GPT-5.5 吗?

不要假设本地 CLI 参数能控制 Codex Cloud。Codex 文档说明云端默认模型目前不能由用户直接改变,所以云端任务要单独看当前默认行为。

ChatGPT 套餐使用和 API 计费是一回事吗?

不是。ChatGPT 套餐里的 Codex 访问与 OpenAI API 的 token 计费分开。套餐访问看 Help Center,API 成本看 API pricing。

要不要把所有 Codex 工作都切到 GPT-5.5?

不要一刀切。复杂任务先试 GPT-5.5,但要用你自己的仓库任务验证质量、速度、工具调用和失败恢复。GPT-5.4 应该保留为稳定回退,这样模型权限变化不会阻塞开发。