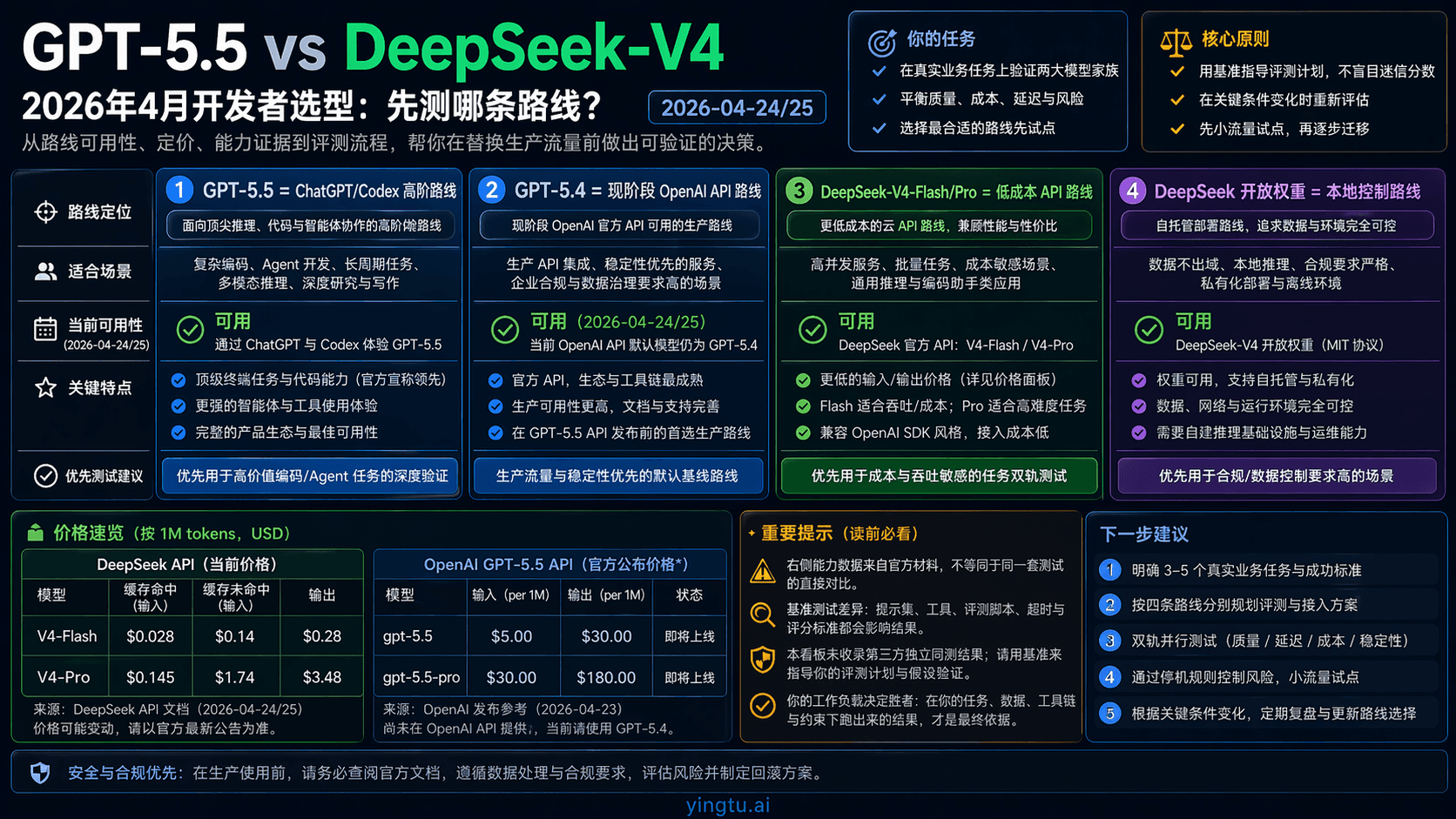

截至 2026 年 4 月 24/25 日,GPT-5.5 和 DeepSeek-V4 不是两条完全对称的 API 选择。如果你的工作发生在 ChatGPT 或 Codex 里,先测 GPT-5.5;如果你现在要上线 OpenAI API 工作流,先把 GPT-5.4 当作稳定基线;如果你要压低 API 成本、测试 1M 上下文,或评估开放权重,先测 DeepSeek-V4-Flash 或 DeepSeek-V4-Pro。

| 路线 | 先测它的场景 | 暂缓的场景 |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | 你要的是 OpenAI 产品内的高端编码、Agent 和推理体验。 | 你需要今天就能进入生产的常规 API 模型。 |

| GPT-5.4 in OpenAI API | 你正在交付 OpenAI API 工作流,需要当前文档可用的 API 基线。 | 你只是在评估下一代前沿路线,可以等 GPT-5.5 API 开放。 |

| DeepSeek-V4-Flash / V4-Pro API | 你要低成本吞吐、长上下文测试,或 DeepSeek 原生能力验证。 | 你需要 OpenAI 原生工具链、企业支持或已经验证过的质量基线。 |

| DeepSeek-V4 开放权重 | 你要本地控制、MIT 许可、隐私边界或自托管长上下文实验。 | 你不想承担推理基础设施、监控和模型服务责任。 |

公开基准只能帮你决定先测什么,不能替你宣布谁是通用赢家。真正换生产流量前,要把同一批真实任务跑过候选路线,记录质量、延迟、成本、工具调用、错误恢复和数据处理边界;当 OpenAI 正式在 API 文档里开放 GPT-5.5 后,再重新评估。

先选路线,不要先选冠军

中文讨论里很容易把这件事写成“DeepSeek-V4 和 GPT-5.5 谁更强”。这个问法能吸引点击,但对开发者不够实用。你真正要决定的是:哪条路线现在能测、哪条路线现在能上生产、哪条路线只适合等下一个官方状态更新后再评估。

GPT-5.5 当前的强项是 OpenAI 原生产品体验。ChatGPT、Codex、账号权限、编辑/终端集成、任务上下文和审查流程一起构成了它的实际价值。DeepSeek-V4 的强项则是另一组东西:更低的托管 API 价格、Flash/Pro 两档选择、1M 上下文、开放权重和更可控的自托管路线。这不是一个“一个模型替换另一个模型”的简单判断,而是产品路线、API 路线和基础设施路线的拆分。

可以先按任务类型分流:

| 任务类型 | 优先测试 | 判断原因 |

|---|---|---|

| Codex 内的复杂编码、Agent 调试、仓库修复 | GPT-5.5 | 模型和 OpenAI 产品面一起工作,价值不只来自模型分数。 |

| 已经上线的 OpenAI API 服务 | GPT-5.4 | 当前 API 文档仍把它作为可用基线,迁移风险更低。 |

| 大量分类、抽取、摘要、RAG 预处理 | DeepSeek-V4-Flash | 单次成本低,更适合配合自动验收和批量重试。 |

| 高难度编码、复杂推理、长上下文合成 | DeepSeek-V4-Pro | 比 Flash 更适合做质量评估,同时仍保留明显成本优势。 |

| 本地部署、隐私、可控推理、内部实验 | DeepSeek-V4 开放权重 | 适合把模型当作基础设施项目来评估。 |

这也是本地中文结果里最缺的部分:很多页面会强调“国产开源”“价格低”“实测谁赢”,但不会把 GPT-5.5 的 ChatGPT/Codex 入口、GPT-5.4 的 API 基线、DeepSeek-V4 的 Flash/Pro API 和开放权重放在同一张决策板里。缺少这一步,价格和基准都会被读错。

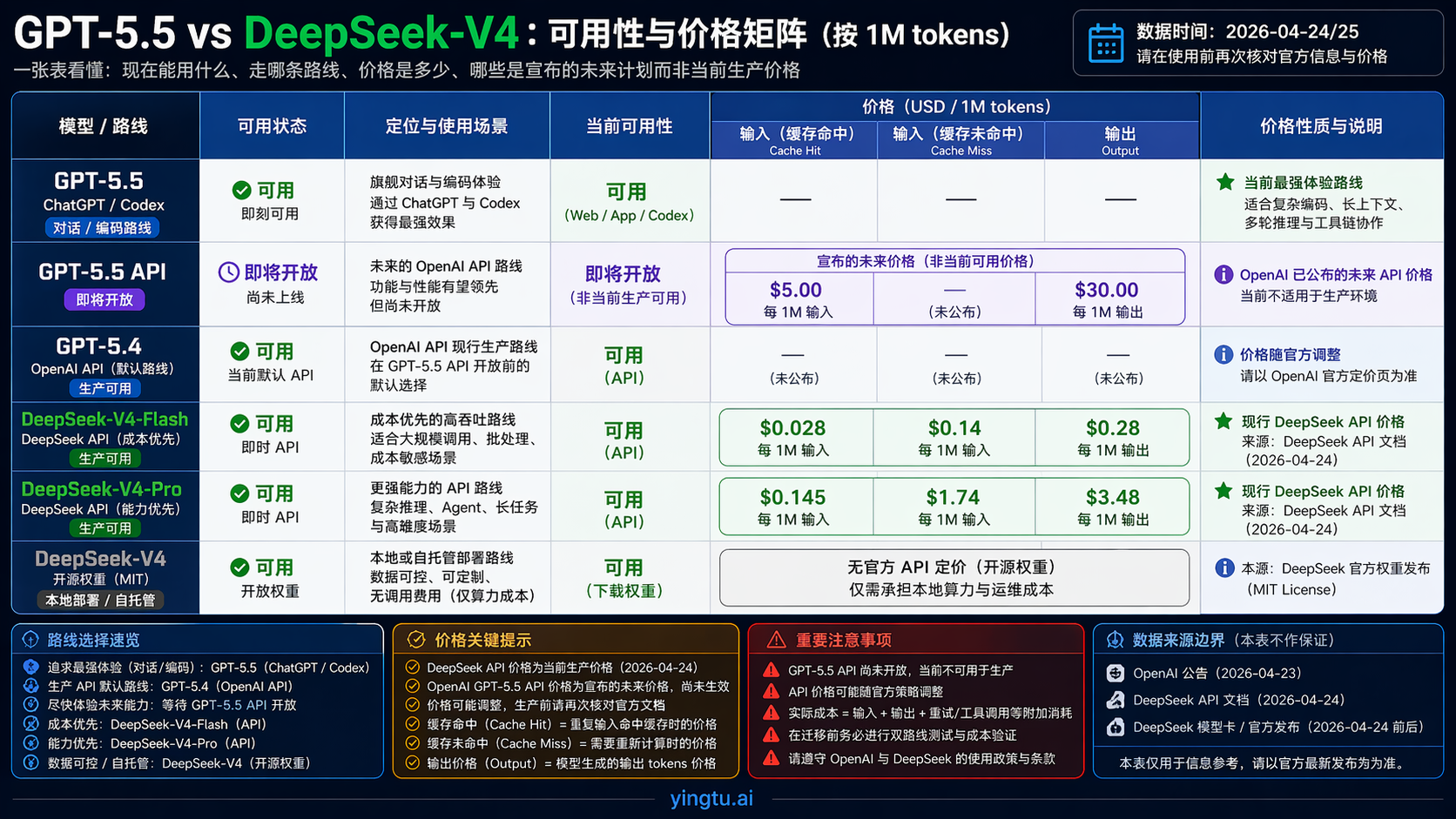

可用性和价格:先分清现在能用什么

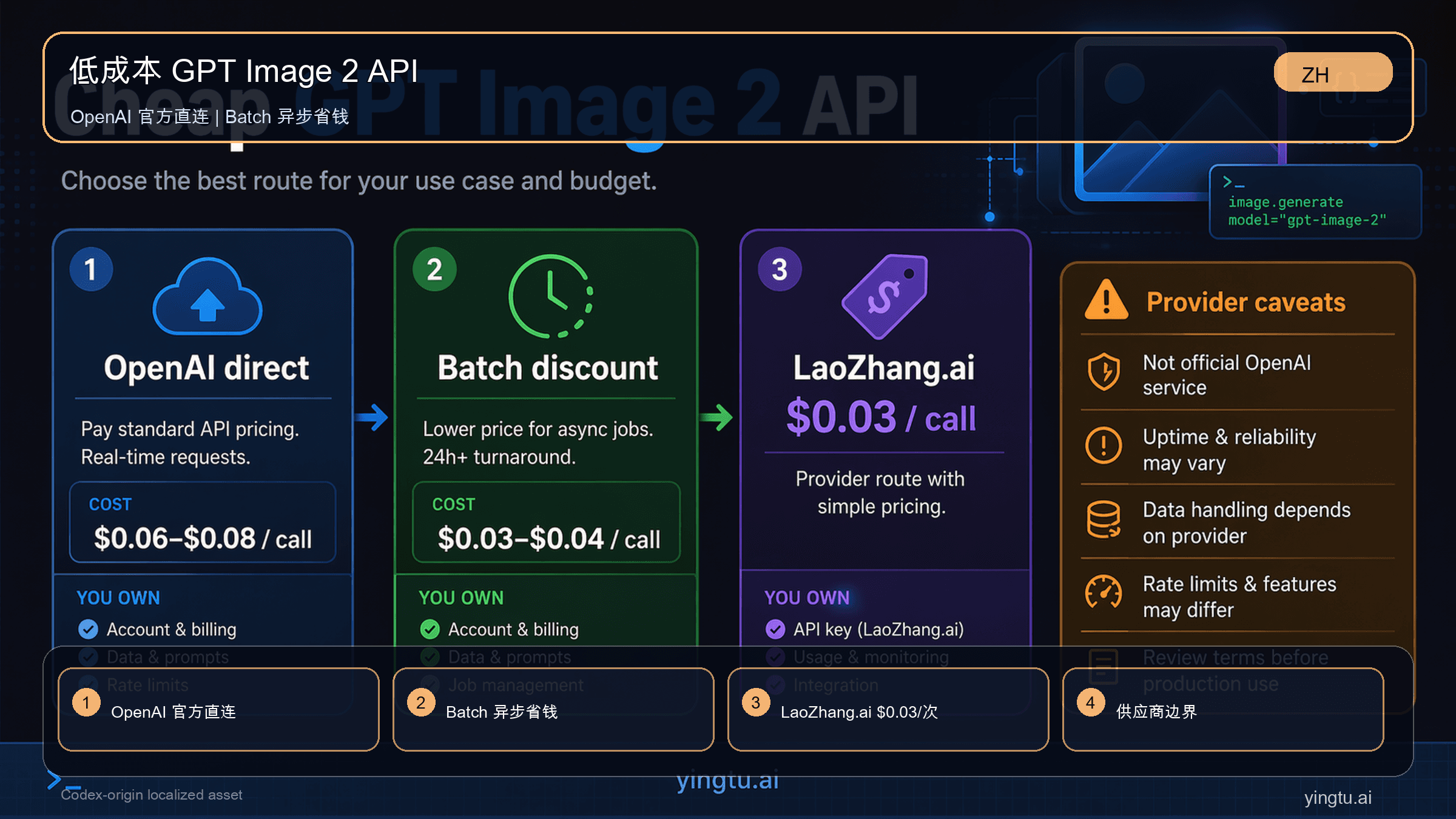

OpenAI 的 GPT-5.5 发布说明把 GPT-5.5 定位为新的高端模型,并说明它进入 ChatGPT 和 Codex 等产品面。发布说明也给出了未来 API 价格,但 OpenAI 的 latest-model API 指南在 2026 年 4 月 24/25 日仍把 GPT-5.4 作为当前 OpenAI API 路线。也就是说,GPT-5.5 现在可以作为 OpenAI 原生工作流的高端选择,但不能被写成已经可正常生产调用的 API 同级选项。

DeepSeek 的 API pricing 文档已经列出 deepseek-v4-flash 和 deepseek-v4-pro。同一组文档还提供 OpenAI-compatible 和 Anthropic-compatible 入口,这对想做小范围替换测试的团队很重要。需要注意的是,deepseek-chat、deepseek-reasoner 这类 alias 当前会映射到 V4-Flash 的不同模式,但生产配置最好使用明确模型 ID,避免以后 alias 变更造成静默漂移。

| 路线 | 当前状态 | 2026 年 4 月 24/25 日的价格信号 |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | 已在 OpenAI 产品面开放。 | 走产品订阅或工作区入口,不是常规 API token 计费。 |

| GPT-5.5 API | OpenAI 已预告即将开放。 | 预告价格:输入 $5 / 1M tokens,输出 $30 / 1M tokens。 |

| GPT-5.5 Pro API | OpenAI 已预告即将开放。 | 预告价格:输入 $30 / 1M tokens,输出 $180 / 1M tokens。 |

| GPT-5.4 API | 当前 OpenAI API 基线。 | 以 OpenAI 当前 API 文档和价格页为准。 |

| DeepSeek-V4-Flash API | 已列入 DeepSeek API 文档。 | cache hit $0.028,cache miss $0.14,output $0.28 / 1M tokens。 |

| DeepSeek-V4-Pro API | 已列入 DeepSeek API 文档。 | cache hit $0.145,cache miss $1.74,output $3.48 / 1M tokens。 |

| DeepSeek-V4 开放权重 | 官方模型卡提供开放权重证据。 | 托管 token 费变成 GPU、服务、监控和维护成本。 |

价格差距很大,但不能直接翻译成“DeepSeek 一定更适合生产”。如果任务是可自动验收的抽取、分类、摘要、批量检查,DeepSeek-V4-Flash 的成本优势会很明显。若任务是复杂推理、工具调用、长上下文和代码修改,DeepSeek-V4-Pro 更适合先测。GPT-5.5 的成本更高,但在 Codex 或 ChatGPT 里,如果它减少了人工来回、失败重试和审查时间,整体成本仍可能合理。

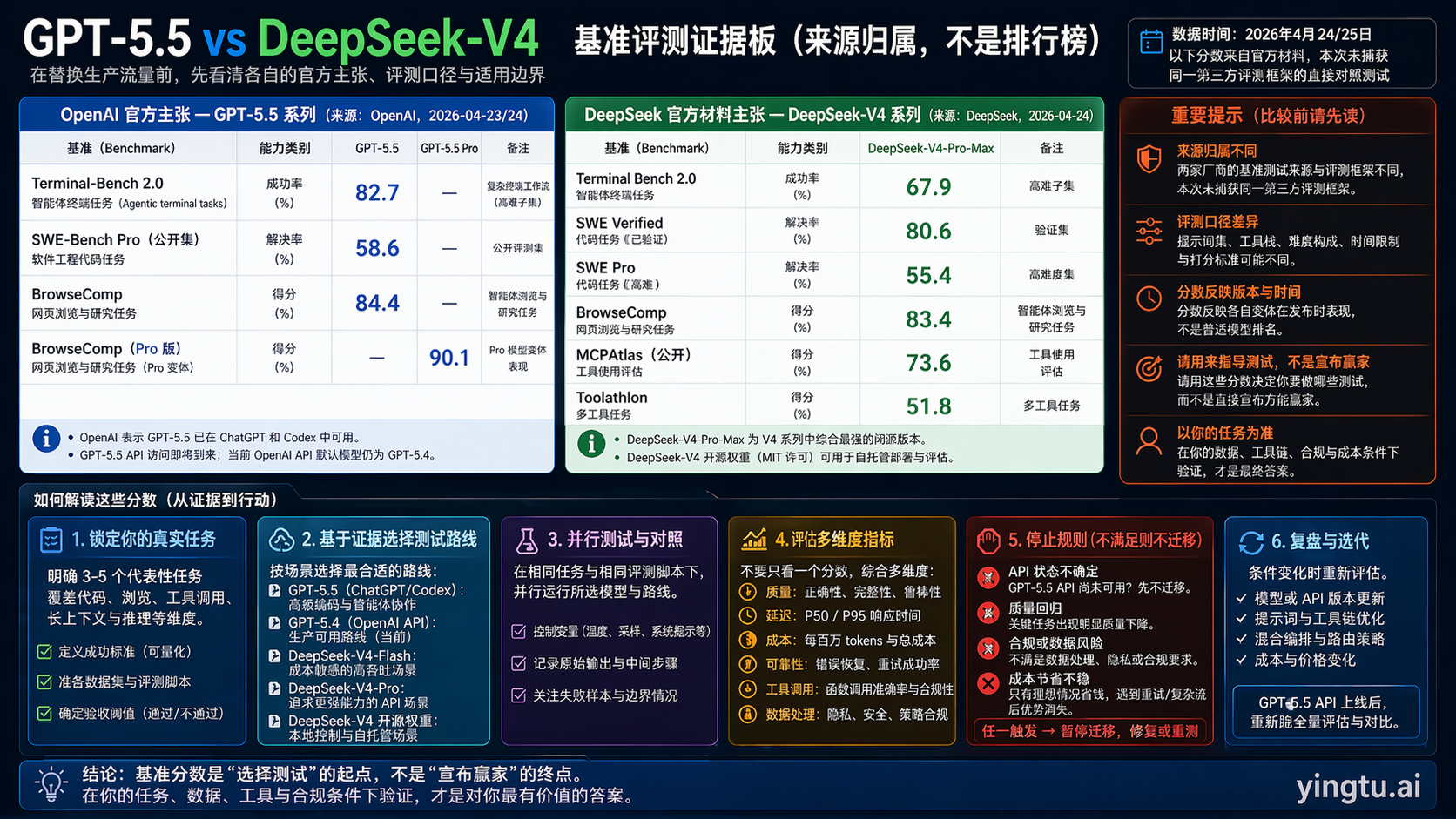

基准证据:看来源,不要看粗暴排名

公开基准的正确用法是帮你设计测试任务,不是替你决定迁移。OpenAI 在 GPT-5.5 发布材料中给出编码、浏览和 Agent 相关成绩,例如 Terminal-Bench 2.0、SWE-Bench Pro public、BrowseComp,以及 GPT-5.5 Pro 的 BrowseComp 表现。DeepSeek 的 DeepSeek-V4-Pro model card则给出 DeepSeek-V4-Pro-Max 在 Terminal-Bench 2.0、SWE Verified、SWE Pro、BrowseComp、MCPAtlas Public 和 Toolathlon 等项目上的成绩。

这些行可以说明方向:GPT-5.5 对 OpenAI 原生编码、浏览和 Agent 任务很强;DeepSeek-V4 不只是低价模型,它在软件、工具、浏览和长上下文方向也值得严肃测试。但这些行来自不同发布方,不等于同一个独立实验室、同一批提示词、同一套工具环境和同一评分规则。把它们合成一个“谁赢谁输”的总榜,会误导生产判断。

更稳的做法是把公开基准转成内部测试表:

| 证据区域 | 公开材料能说明什么 | 本地必须补测什么 |

|---|---|---|

| 编码和仓库修改 | GPT-5.5 的 OpenAI 成绩很强,DeepSeek-V4-Pro 也有竞争性软件分数。 | 多文件修改、测试修复、依赖处理、patch 质量和 review 成本。 |

| 工具与 Agent | 两边都有工具/浏览/Agent 证据,但来源和环境不同。 | 函数参数、工具失败恢复、重试策略、结构化输出有效率。 |

| 长上下文 | DeepSeek-V4 强调 1M 上下文;GPT-5.5 也预告 1M API 上下文。 | 后段信息回忆、冲突指令处理、引用准确性和实际长提示成本。 |

| 生产可靠性 | 公共基准通常看不到限速、延迟波动和数据合规边界。 | p95 延迟、超时率、拒答率、错误恢复、日志和审计要求。 |

如果你只看短视频或社区实测,很容易得到一个热闹但不可迁移的答案。真正有用的是把你的真实任务拆成 3 到 5 类,用同一输入、同一评分规则、同一成本口径去跑。

DeepSeek-V4 内部也要先分 Flash、Pro 和开放权重

DeepSeek-V4 不是一个单行选择。托管 API、Pro 能力路线、Flash 成本路线和开放权重路线会导向完全不同的工程决策。

DeepSeek-V4-Flash 适合先用在高吞吐、可验收、可重试的任务里。比如结构化抽取、分类、短摘要、RAG 预筛、路由判断、格式转换、批量标签等。如果这些任务有自动检查,Flash 的低成本可以让你多跑候选、多加验证层,最后按“通过验收的输出成本”算账。

DeepSeek-V4-Pro 适合先用在失败代价更高的任务里。比如代码修改、工具链协作、长上下文综合、复杂推理、Agent 步骤规划和高难度问答。它比 Flash 贵,但仍保留相对 GPT-5.5 预告 API 价格的明显差距。如果 Pro 能减少重试和人工修复,它可能比看起来更便宜。

DeepSeek-V4 开放权重 则是另一个项目。开放权重和 MIT 许可意味着你可以评估本地控制、私有数据边界和自定义服务,但这不是“免费 API”。你要承担 GPU、批处理、模型服务、升级、监控、安全、排障和团队时间。只有当数据边界、可控性或内部部署是第一需求时,这条路才应该排在前面。

长上下文也不要只看“支持 1M”。真正测试时要把无关文档、后段关键信息、冲突要求、跨文件引用和最终校验放进去。一个模型在 20K tokens 表现好,不代表它在 300K 或 800K tokens 的事实定位、指令坚持和输出结构同样稳定。

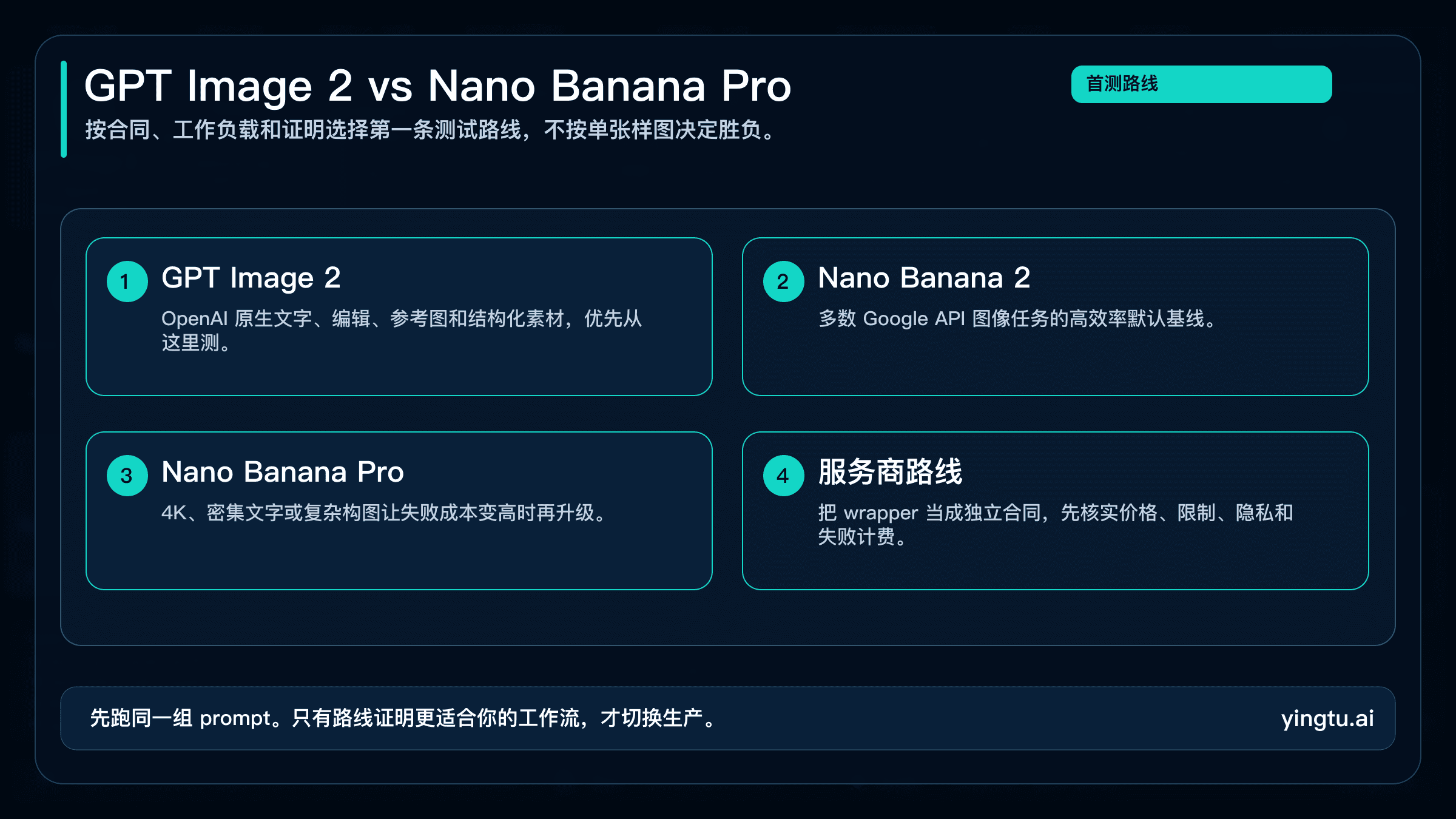

按工作流给首测建议

如果你在 Codex 或 ChatGPT 里做高级编码、仓库修复、Agent 调试、复杂推理,先用 GPT-5.5。它的价值来自模型和产品面的组合,不只是模型名。此时 DeepSeek-V4 可以作为外部路线做对照,但不应被当成整个 Codex 工作流的直接替代。

如果你已经把服务跑在 OpenAI API 上,先保留 GPT-5.4。你可以抽象出模型配置,准备将来加入 GPT-5.5,但不要在 GPT-5.5 API 真正出现在官方 API 文档前,把它写进 SLA、销售材料或用户承诺。

如果你要处理大量低风险 API 请求,先测 DeepSeek-V4-Flash。重点不是“每 token 便宜”这一句话,而是它能否在可验收任务上降低通过输出的总成本。若 Flash 在推理、格式和工具调用上不稳定,再把困难切片升级到 DeepSeek-V4-Pro。

如果你要做高风险推理或编码,但又不想被高价模型吞掉预算,DeepSeek-V4-Pro 应该和 GPT-5.4 API 做并行测试;等 GPT-5.5 API 真的开放后,再把它加入同一测试矩阵。不要拿一组公开分数替代内部测试,尤其不要忽略失败重试和人工 review 成本。

如果你有隐私、合规、私有部署或自定义推理需求,开放权重路线值得小规模试点。这个试点要同时测模型质量和基础设施成本,不要只把它当成模型替换。

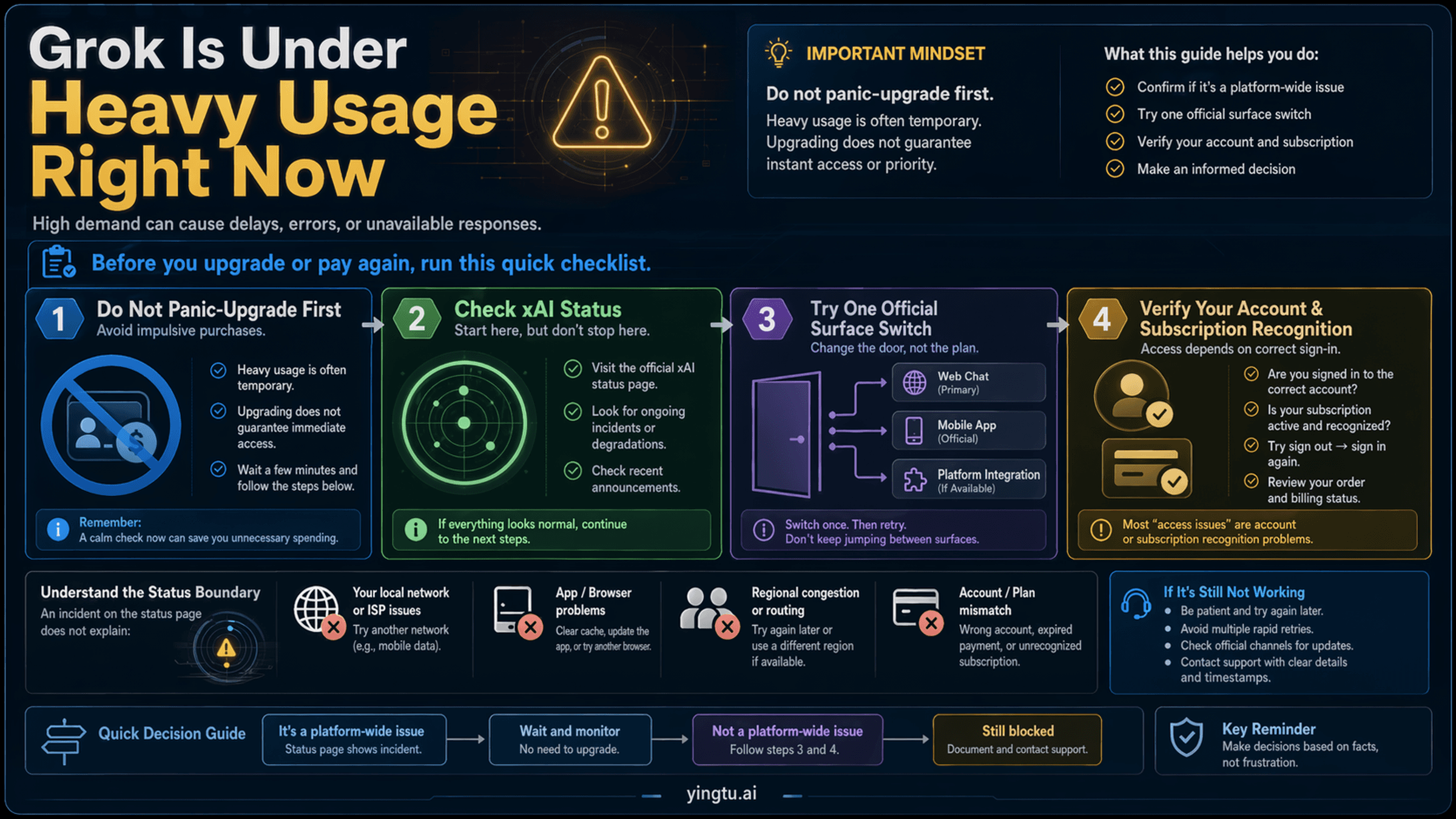

迁移前的双跑测试计划

不要用一百条随手写的提示词做迁移决定。更好的方法是挑 3 到 5 个真实任务:一个编码任务、一个长上下文任务、一个工具调用任务、一个结构化输出任务、一个高吞吐任务。每个任务都要有输入、期望输出、评分表、失败严重度、重试规则和成本口径。

| 测试路线 | 适用场景 | 要记录的指标 |

|---|---|---|

| GPT-5.5 in ChatGPT/Codex | 任务依赖 OpenAI 原生产品工作流。 | 完成质量、节省人工、代码审查结果、界面和任务流适配度。 |

| GPT-5.4 API | 当前 OpenAI API 生产基线。 | 基线质量、延迟、成本、工具调用、结构化输出、回归风险。 |

| DeepSeek-V4-Flash API | 高吞吐或成本敏感任务。 | 通过率、重试率、格式有效率、cache 行为、通过输出成本。 |

| DeepSeek-V4-Pro API | 更难的 DeepSeek 质量测试。 | 准确率、推理稳定性、工具行为、长上下文回忆、成本与重试。 |

| DeepSeek-V4 开放权重 | 本地控制或私有部署。 | 服务延迟、GPU 成本、吞吐、升级流程、安全和可观测性。 |

测试前先写停止规则。结构化输出经常坏、工具参数被省略、后段证据被忽略、代码改动不安全、人工 review 成本过高,都应该阻止迁移。便宜路线只有在“通过验收的输出成本”更低时才真的便宜。团队还应该保留原路线的回滚开关,把新路线先放进影子流量或低风险批处理里观察,确认日志、监控和审计字段都能覆盖问题后,再扩大比例。这样模型切换才是受控发布,而不是一次性押注。

推荐的当前结论很明确:GPT-5.5 先给 OpenAI 原生高端工作流;GPT-5.4 继续作为 OpenAI API 生产基线;DeepSeek-V4-Flash 先测高吞吐成本路线;DeepSeek-V4-Pro 先测更强的 DeepSeek 能力路线;开放权重只在本地控制和基础设施能力都成立时进入试点。

常见问题

GPT-5.5 现在可以直接在 API 里用吗?

OpenAI 已经公布 GPT-5.5 API 的未来价格,并说明 API access coming soon,但截至 2026 年 4 月 24/25 日,当前 API 指南仍以 GPT-5.4 作为可用 OpenAI API 路线。生产规划里应把 GPT-5.5 写成 ChatGPT/Codex 当前路线和未来 API 路线,而不是已经可正常上线的 API 模型。

DeepSeek-V4 应该先测 Flash 还是 Pro?

如果任务量大、风险低、有自动验收,先测 DeepSeek-V4-Flash。如果任务涉及复杂推理、编码、工具调用或长上下文,先测 DeepSeek-V4-Pro。两者都不是开放权重路线;开放权重适合本地控制和自托管评估。

DeepSeek-V4 价格低就一定更适合吗?

不一定。价格低只说明候选路线值得测试。真正要看通过输出成本、重试次数、人工审查时间、失败影响和合规边界。一个便宜模型如果需要两次重试和人工修复,可能比高价模型更贵。

基准分数能直接决定谁赢吗?

不能。公开基准可以告诉你该优先测哪些能力,但当前证据来自不同发布方和不同环境。生产迁移必须用同一批真实任务、同一套评分规则和同一成本口径验证。

什么时候应该重新判断?

当 OpenAI API 文档正式列出 GPT-5.5、DeepSeek 更新 V4 价格或 alias、出现独立同环境测试,或你的任务结构发生变化时,就应该重新跑一轮测试。这个选择不是一次性结论,而是跟随可用性、质量、成本和运行风险变化的工程决策。