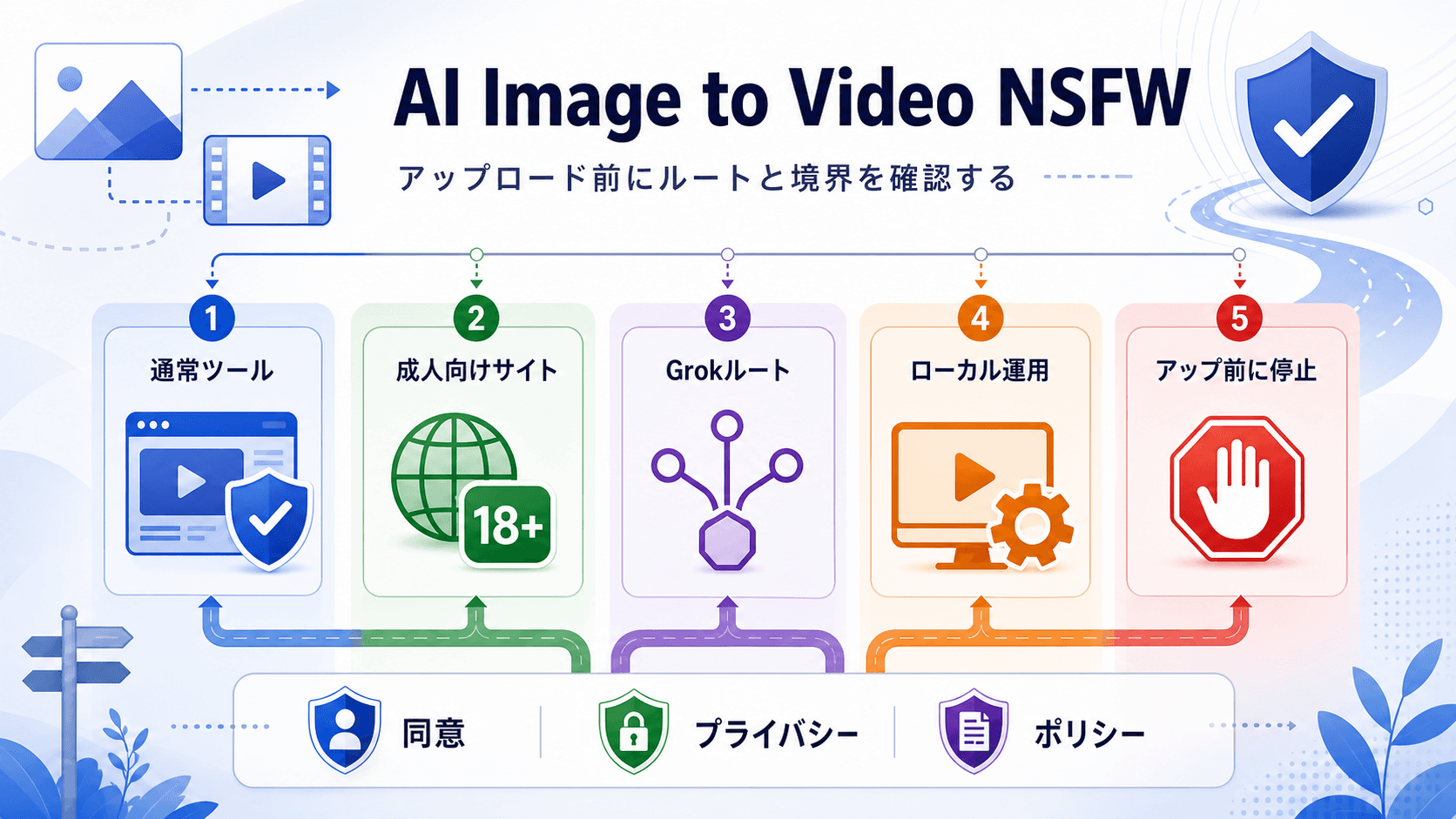

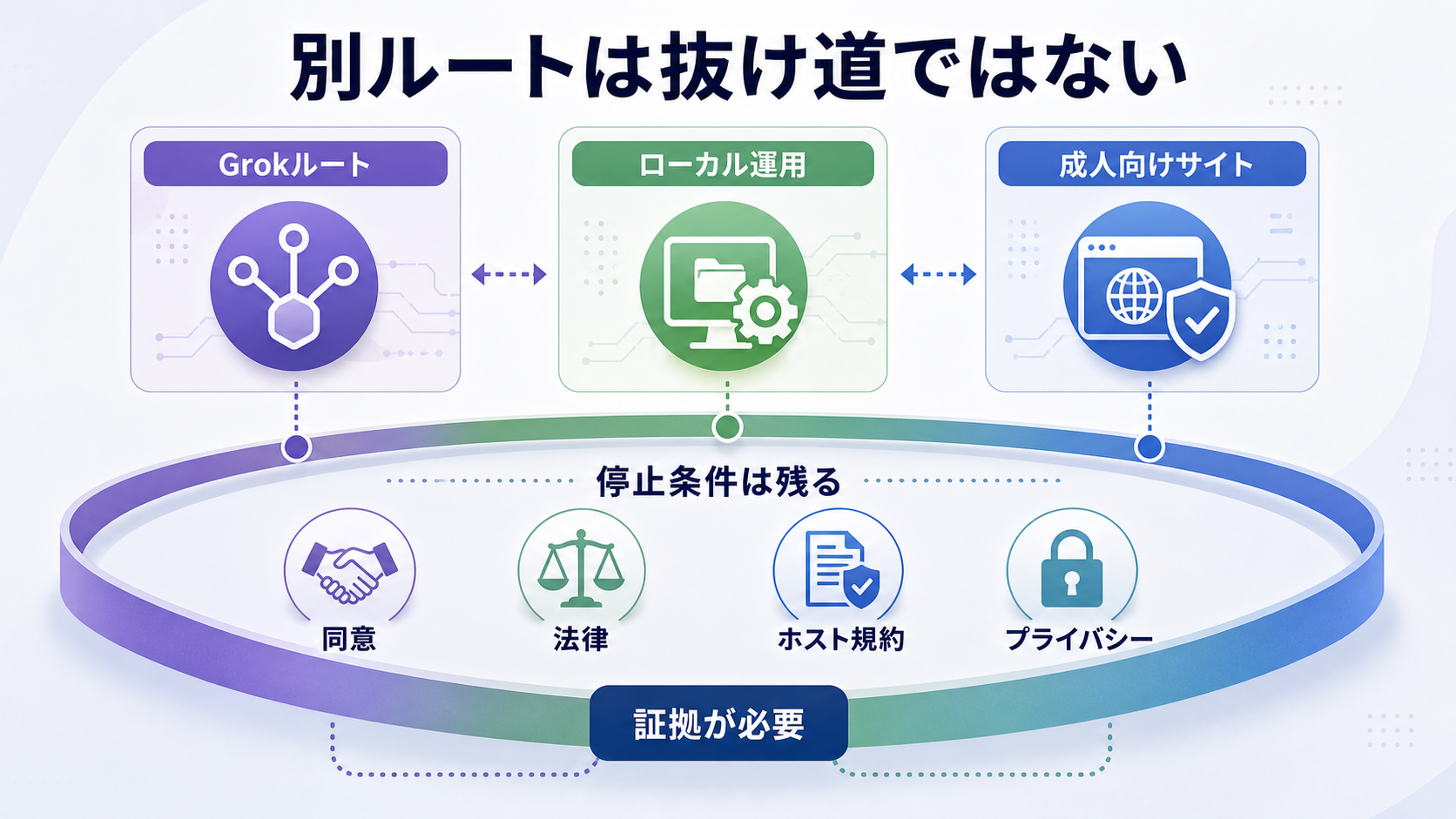

2026年5月8日時点で、AI画像をNSFW動画化する作業は「どのツールなら通るか」だけでは判断できない。一般向けの画像から動画へのAIは性的に露骨な内容や人物の無断利用を制限することが多い。成人向けサイトは「無修正」「制限なし」「無料」といった言葉を前面に出すことがある。ローカル環境はファイル管理をしやすくする一方で、同意や法律の責任を消してはくれない。最初に見るべきものは生成モデルではなく、アップロードする元画像である。

| 経路 | 向いているケース | 壊れやすい点 | アップロード前の確認 |

|---|---|---|---|

| 一般向けimage-to-video | 安全なアニメーション、商品動画、アバター、非露骨な動きの確認 | NSFW、実在人物、私的画像で拒否されやすい | 現在の利用規約、アカウントリスク、非NSFW版で足りるか |

| 成人向けサイト | 架空の成人キャラクター、明確に同意済みの成人素材 | 保存、削除、学習利用、公開ギャラリー、支払い表示が不明確になりやすい | 規約、プライバシー、削除範囲、同意の証拠 |

| Grok | Grok Imagine、Spicy Mode、xAIポリシーが本題のとき | アプリ、API、X投稿ルールが別の契約になる | Grok専用の可用性記事とxAIポリシー記事に分けて確認 |

| ローカルまたはopen-source | 自分の環境でファイルを管理する実験 | ローカル処理でも同意、年齢、権利、公開責任は残る | 画像の権利、人物性、年齢、ライセンス、配布先 |

| 生成せず止める | 同意のない実在人物、未成年、私的画像、NCII、嫌がらせ、回避目的 | 単なる非対応ではなく、危害や違法性の問題 | 生成しない。被害があるなら証拠を保全して通報する |

日本語圏の紹介文では、成人向けAPI、NSFW動画生成、一般向け画像動画化サービス、掲示板の相談、古いランキングが混ざりやすい。これは需要の形を示すだけで、許可の証明ではない。「無料」「無制限」「フィルターなし」という言葉は、現在の規約と保存条件で確認するまでは広告文句として扱う。

特に「画像を動画化」という言葉は軽く見えやすい。静止画を少し動かすだけなら問題が小さいように思えるが、性的な文脈では、元画像の人物性、同意、保存先、二次利用、サムネイル生成、決済履歴、公開先が一度に関係する。完成した動画だけでなく、アップロードした瞬間からリスクは始まる。だから生成後の見栄えより先に、アップロード前の停止条件を確認する。

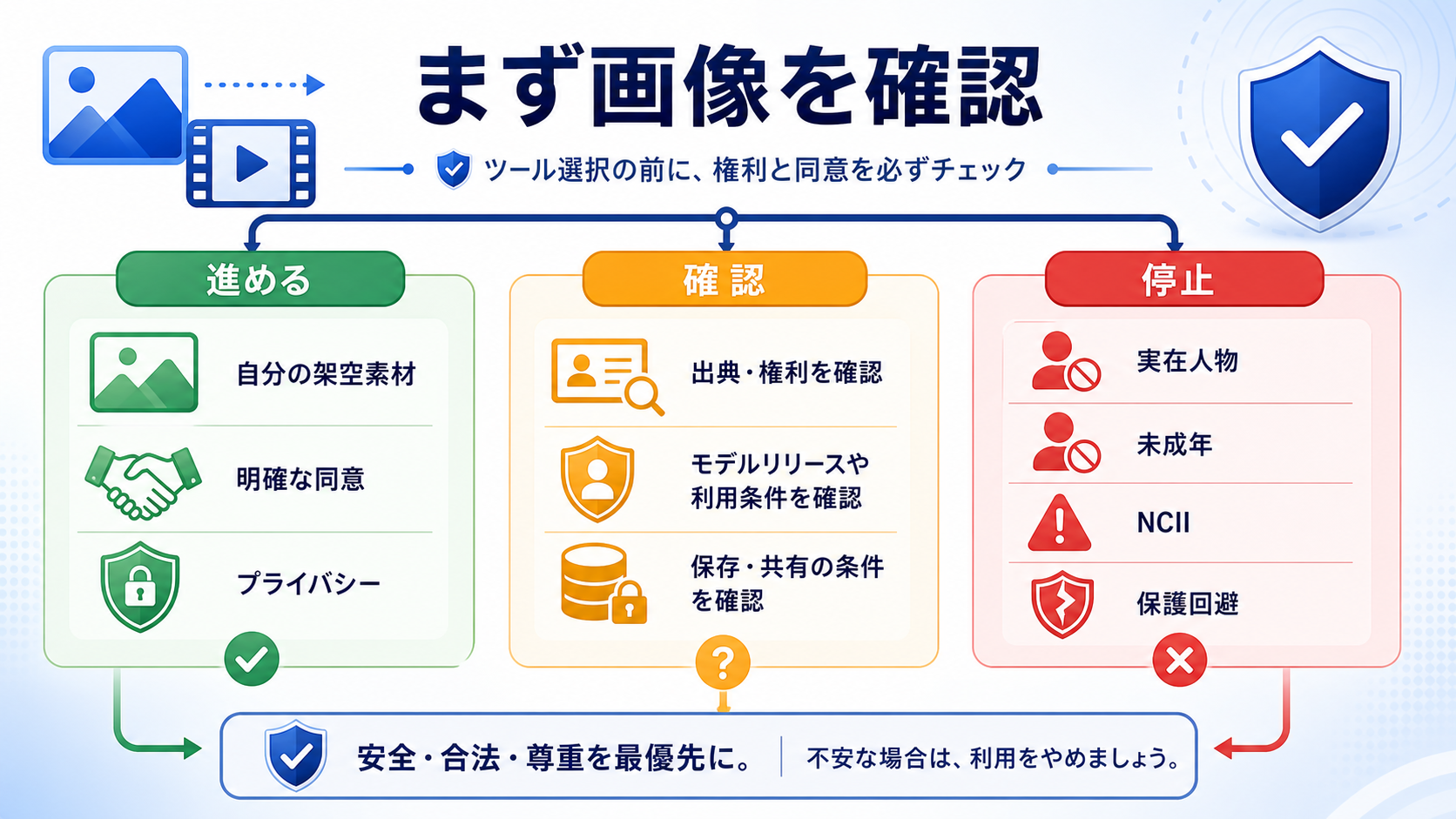

ツールより先に元画像を確認する

画像から動画にする作業では、プロンプトだけでなく実際のファイルを渡す。そこには顔、体、メタデータ、撮影場所、私的な文脈、本人だと分かる特徴が含まれることがある。だから最初の質問は「どのサイトが通すか」ではない。「この画像をこの目的でアップロードし、保存され、変換され、共有される可能性を本人が許可しているか」である。

確認は短くてよい。

| 元画像 | 読み方 | 行動 |

|---|---|---|

| 自作の架空キャラクターまたは完全な合成成人キャラクター | 身元リスクは比較的低いが、年齢表現と規約は残る | サイトが成人向けカテゴリを許可し、保存条件が読める場合だけ進む |

| モデル、パートナー、出演者がこの用途に明示同意している画像 | 同意は生成、保存、編集、出力、共有まで具体的である必要がある | 同意の記録を残し、削除範囲が曖昧なサービスを避ける |

| 同意のない実在人物 | 肖像、プライバシー、嫌がらせ、NCIIが重なる | 止める |

| 未成年または年齢が不明な人物 | 児童安全の境界 | 止める。被害がある場合は通報経路へ進む |

| 私的または親密な画像 | 非同意の親密画像になりやすい | アップロード、テスト、転送をしない |

| フィルターを避けるための依頼 | セーフガード回避 | 言い換えず、作業を止める |

この段階で失敗する画像は、サービスを変えても安全にならない。むしろ「通りやすい」サイトを探すほど、元画像が保存、漏えい、誤認、再利用されるリスクが上がる。

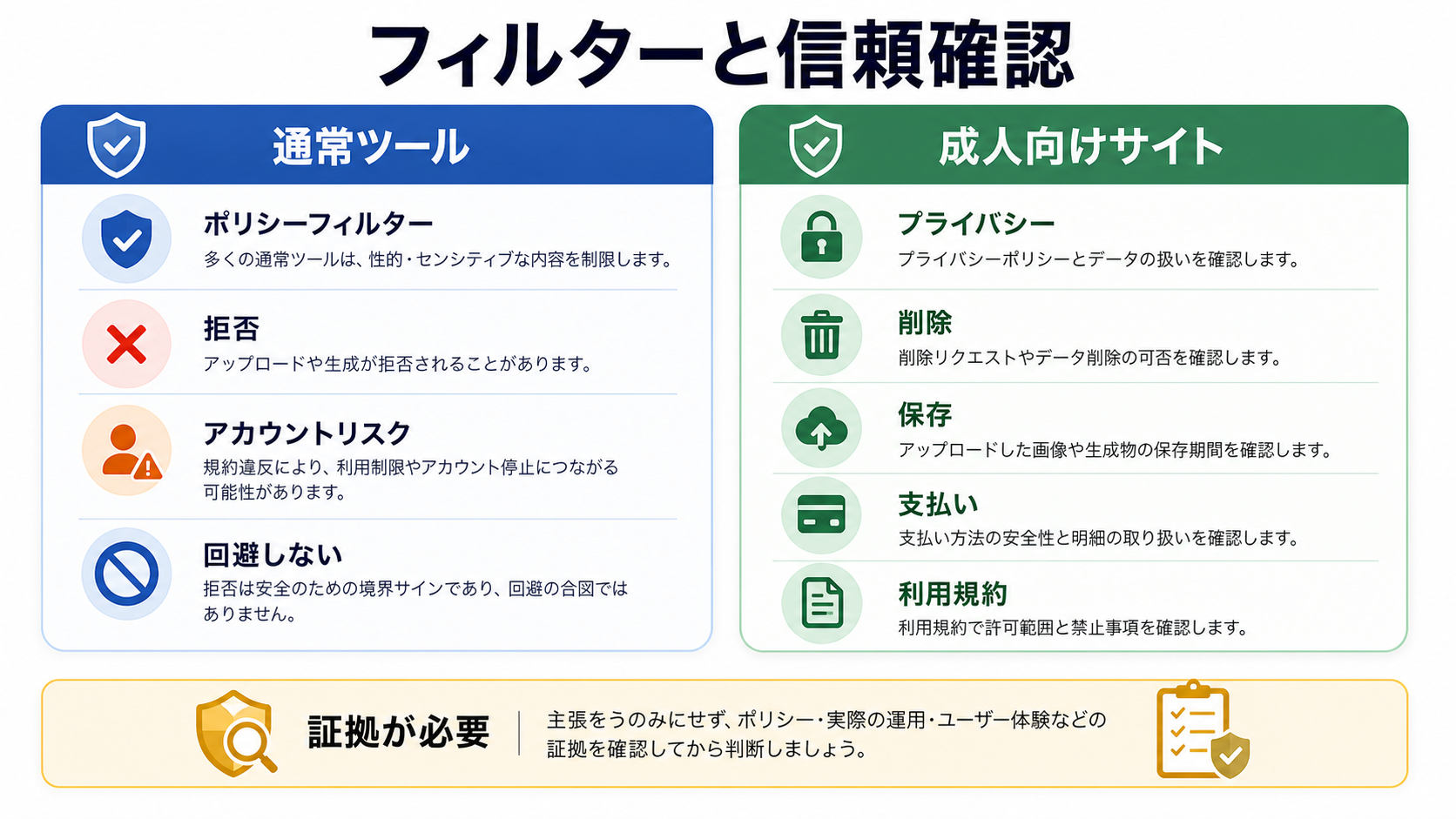

一般向け動画AIがNSFWを止める理由

一般向けのimage-to-videoサービスは、広告、教育、商品紹介、SNS投稿、ストーリーボード、アバターなど広い用途を想定している。そのため、性的に露骨な内容、同意のない親密画像、児童性的搾取、他人の顔や声や身体の無断利用、嫌がらせ、保護機能の回避に強い制限を置くことが多い。

RunwayのUsage Policyは、sexually explicit content、adult nudity、non-consensual intimate imageryの作成や変更、許可のない他人の画像や動画や音声の利用を禁じている。HeyGenもethicsとmoderation policyで、人物の許可、性的コンテンツ、動画生成の境界を示している。

モデル提供者の規則でも同じ構図が見える。OpenAIのusage policiesは、性的暴力、同意のない親密コンテンツ、児童の性的搾取、likenessの有害な利用、セーフガード回避を禁じる。GoogleのGenerative AI prohibited-use policyも、児童搾取、non-consensual intimate imagery、プライバシーやIP侵害、safety filterの回避、性的満足を目的としたポルノ表現を禁止する。

したがって、一般向けサービスで拒否された場合は「もっと通る言い方」を探すより、なぜ止まったのかを分類するほうがよい。露骨な表現か。実在人物か。本人同意がないのか。年齢が問題か。私的画像か。回避意図があるのか。拒否は不便なエラーではなく、境界の通知である。

成人向けサイトは信頼性を先に読む

成人向けサイトは、AI画像をNSFW動画化したい人にとって最も直接的に見える経路である。しかし、ここでは広告の言葉より契約の中身が重要になる。日本語の成人向け紹介文でも「無修正」「15以上のモデル」「無料」「制限なし」「画像から動画」といった表現が並ぶ。だが、その言葉だけでは元画像の保存、スタッフ閲覧、公開ギャラリー、学習利用、削除、支払い、悪用通報がどう扱われるか分からない。

確認すべき項目は決まっている。

| 表示される言葉 | 確認すること | なぜ重要か |

|---|---|---|

| プライベート | 保存期間、スタッフ閲覧、ギャラリー初期設定、学習利用 | 成人向け元画像は合法でも機微性が高い |

| いつでも削除 | 元画像、生成動画、サムネイル、ログ、バックアップまで消えるか | 削除ボタンだけでは足りない場合がある |

| フィルターなし | 禁止事項、通報窓口、未成年やNCIIへの対応 | 弱い管理は被害者を守れない |

| 無料 | クレジット、透かし、解像度、待ち時間、出力制限 | 試用無料と完成無料は違う |

| リアル人物対応 | 明示同意、likeness、NCII、年齢規則 | 実在人物は最も危険な領域 |

| ローカルまたは匿名 | 何が端末内に残り、何がサーバーへ出るか | プライバシーは宣伝語ではなく設計で決まる |

サイトが基本的な説明を出さないなら、失われたときに困る画像をアップロードしないほうがよい。成人向けの架空作品であっても、保存や削除の説明が薄いサービスは避ける価値がある。

また、年齢確認があることと、すべての入力画像が許されることは別である。18歳以上のユーザーだけが入れるサービスでも、同意のない実在人物、私的画像、未成年に見える人物、嫌がらせ目的の変換は止める必要がある。年齢ゲートは利用者側の入口管理であり、元画像の権利や本人同意を代わりに確認してくれる仕組みではない。

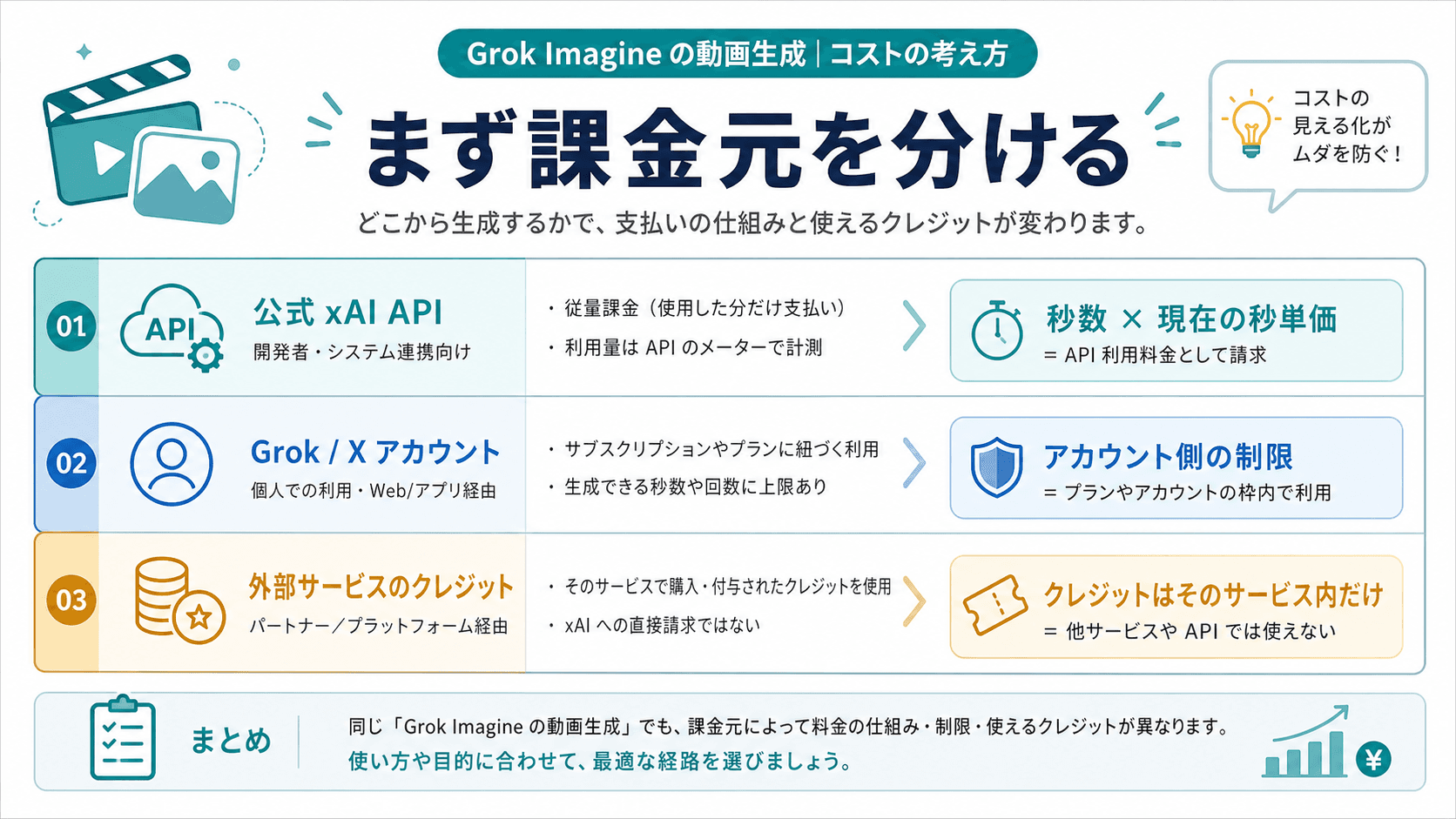

Grokは専用の枝として扱う

GrokはGrok ImagineやSpicy Modeの話題で成人向け生成と結びつきやすい。しかし、AI画像をNSFW動画化する一般的な話題をすべてGrokで説明するのは誤りである。Grokの表示、xAIのAPI、Xでの公開、xAIのAcceptable Use Policyは別々に確認する。

Spicy Modeが見えるか、なぜ使えないか、Xのsensitive media設定が関係するかを調べたい場合は、Grok Imagine Spicy Mode availability guideを読むほうがよい。xAIの規約、実在人物、未成年、NCII、モデレーション境界を確認する場合は、Grok xAI NSFW image generation policy guideが該当する。

xAIのAcceptable Use Policyは、privacyやpublicity rightsの侵害、実在人物のポルノ的な描写、児童の性的搾取、セーフガード回避を禁じる。つまりGrokは「全部通る選択肢」ではなく、独自のアカウント条件とポリシーを持つ別経路である。

ローカルやopen-sourceでも責任は残る

ローカル環境は、成人向けサイトへ元画像を送らないという意味で魅力がある。自分のハードウェア、隔離した作業フォルダ、削除できる中間ファイルを使えるなら、合法で同意済みの架空素材には向く場合がある。ただし、ローカルで動かすことは、他人の写真を同意なく性的に動かしてよい理由にはならない。

さらに、ローカル作業では自分が運用者になる。入力画像、生成途中のフレーム、失敗した出力、キャッシュ、ログ、共有フォルダ、クラウド同期、バックアップがどこに残るかを自分で把握しなければならない。成人向けサイトより外部露出が少ないように見えても、家族共有の端末、会社の管理端末、クラウド同期フォルダ、公開リポジトリに作業痕跡が残れば別の問題になる。ローカルは安全な魔法ではなく、管理責任が自分へ移る選択肢である。

| ローカルの利点 | 残る境界 |

|---|---|

| 元画像を外部サービスへ送らずに済む場合がある | 画像の権利と明示同意は必要 |

| ワークフローやモデルカードを確認できる | ライセンス、ホスト規則、地域の法律は残る |

| 成人向けサイトの保存や支払いリスクを減らせる | 自分で保管、削除、漏えい防止を管理する |

| 架空素材で実験しやすい | 実在人物や未成年やNCIIの停止条件は変わらない |

この節をモデル名、プロンプト、回避手順の一覧にしないほうがよい。必要なのは、ローカル処理がプライバシーの改善になり得る一方で、同意と権利の代わりにはならないという理解である。

古いNSFW動画生成リストはすぐ古くなる

NSFW動画生成のランキングは変化が速い。無料クレジット、出力制限、地域、削除、公開ギャラリー、支払い、モデル名、Grokの可用性、フィルターの挙動が数週間で変わることもある。日本語の古いレビューや自動翻訳されたリストは、確認の入口にはなるが、信頼の根拠にはならない。

| 主張 | 信じる条件 | 安全な読み方 |

|---|---|---|

| 無修正 | 現在の規約と禁止事項が本当に示している | 「そう宣伝しているが、規約確認が必要」 |

| プライベート | 元画像、動画、ログ、スタッフ閲覧、学習利用まで説明されている | 「保存と削除を読んでからアップロード」 |

| 無料 | クレジット、透かし、解像度、待ち時間、出力制限が見える | 「試用無料であり、完成まで無料とは限らない」 |

| 無制限 | プランとfair useが明記している | 「制限はプランや混雑や不正利用対策で変わる」 |

| 実写写真対応 | 同意済みの具体的用途をポリシーが許す | 「実在人物には明示同意が必要」 |

すでに有害なAI性的コンテンツが作られた場合、生成ツール選びはもう中心ではない。URL、アカウント名、日時、プラットフォーム、スクリーンショットを保全し、再共有せずに通報する。未成年が関係する場合は、NCMECのgenerative AI guidanceのような児童安全リソースを使う。米国のnon-consensual intimate imageryではTAKE IT DOWN Actが参考になるが、地域の法律は別途確認が必要である。

被害対応では、加害者や周囲に説明するために素材を再投稿しないことも重要である。証拠保全は、URL、投稿日時、アカウント名、通知メール、プラットフォーム上の報告番号を残す形で行う。検索やSNSで見つけた第三者の助言は役に立つ場合もあるが、未成年、脅迫、金銭要求、職場や学校への拡散がある場合は、信頼できる支援団体、プラットフォームの正式窓口、必要に応じて法律の専門家に早くつなぐほうがよい。

よくある質問

一般向けimage-to-videoでNSFW動画は作れるか。

通常の画像を動画化することはできても、露骨な性的内容、実在人物の無断利用、NCII、児童安全、フィルター回避は多くのサービスで止まる。拒否は境界の合図として扱う。

成人向けサイトなら安全か。

自動的には安全ではない。架空または明確に同意済みの成人素材に合う場合はあるが、規約、プライバシー、保存、削除、通報窓口が読めないなら使わない。

結果を公開しなければ実在人物の写真を使ってよいか。

よくない。性的な動画化には、その用途に対する明示同意が必要である。「非公開」はlikeness、プライバシー、NCII、嫌がらせ、法的リスクを消さない。

架空キャラクターやAI生成画像なら違うか。

身元リスクは下がるが、年齢表現、サービス規約、出力の公開、成人向けカテゴリの可否は残る。

ローカル生成なら合法になるか。

ならない。ローカル処理はファイルの場所を変えるだけで、同意、年齢、権利、ライセンス、ホスト規則、地域の法律を消さない。

「無修正」や「フィルターなし」は信用してよいか。

信用ではなく検証対象である。現在の規約、保存、削除、支払い、サポート、禁止事項を読めないなら、機微な画像はアップロードしない。

最初に何をすればよいか。

元画像を分類する。架空または完全に同意済みの成人素材なら、一般向け、成人向け、Grok、ローカルのどの契約が合うかを確認する。実在人物の無断利用、未成年、私的画像、NCII、嫌がらせ、回避目的が少しでも入るなら、生成経路を探さずに止める。