Grok 图像越狱请求不是一个“怎么把系统骗过去”的工作流。它通常说明用户真正想做的事落在五种情况之一:被拒绝的图片请求、看不到 Grok Imagine 或 Spicy Mode、想用 xAI 图片 API 做产品、需要做安全测试,或者已经遇到有害输出。前两种也不能自动变成技巧问题,后几种更需要先看授权、政策和举报路径。

先把目标分清楚:

| 你真正想解决的问题 | 更安全的下一步 |

|---|---|

| 想让被拦截的图片请求继续生成 | 停止。不要复制社区里的指令串、包装站或所谓成功案例。 |

| Grok Imagine 或 Spicy Mode 入口不显示 | 回到官方 Grok 或 X 入口,检查账号、地区、内容设置、年龄和订阅识别。 |

| 想把 xAI 图片生成接入产品 | 使用 xAI 文档里的开发者路线,同时保留内容审核、日志、举报和删除机制。 |

| 想测试安全边界 | 只有在明确授权、范围、记录和非伤害样例下做安全评估。 |

| 已经看到有害图片或疑似滥用 | 保留必要证据,走平台或组织举报路径,不要再生成、转发或扩散。 |

硬停止条件也要放在最前面:不要规避安全机制,不要生成或编辑真实人物的性化形象,不要涉及未成年人或年龄不明主体,不要制造或传播非自愿私密影像,不要把 Reddit、短视频或提示词仓库里的说法当成生产路线。如果真实问题只是入口不显示,可以读 Grok Imagine Spicy Mode 可用性检查;如果想理解更宽的成人内容规则和平台争议,可以读 Grok xAI NSFW image generation policy analysis。本页只处理更窄的安全分流:哪些请求应该停止,哪些路线仍然合法。

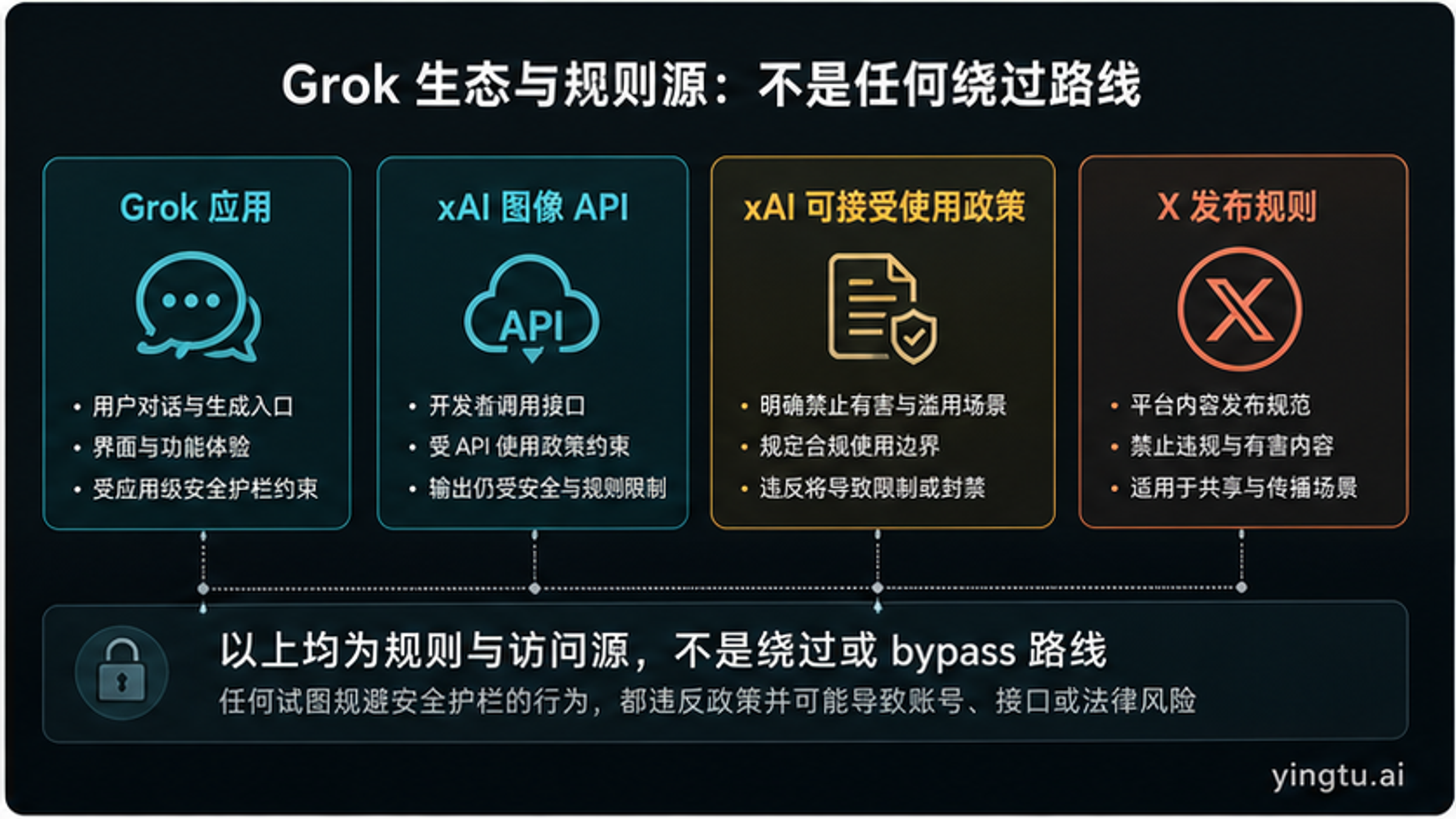

先分清四个规则来源

“Grok”这个词会把消费者功能、开发者接口和平台规则混在一起。安全判断要先拆开四个来源,因为一个来源能证明的事,不能替另一个来源背书。

| 规则来源 | 它能证明什么 | 它不能证明什么 |

|---|---|---|

| Grok 或 X 应用 | 当前登录账号在消费者界面里能看到什么,包括 Grok Imagine 或 Spicy Mode 控件是否出现 | 不能证明所有账号都能用,不能证明有隐藏路线,也不能证明 API 等价 |

| xAI 图片 API 文档 | xAI 提供开发者图片生成与编辑能力,说明请求、模型、输出和审核响应等接口行为 | 不能证明消费者 Spicy Mode 可用,也不能证明 API key 可以避开审核 |

| xAI Acceptable Use Policy | 消费者、开发者和企业使用 xAI 服务时的边界,包括违法用途、儿童安全、肖像、隐私、公示权和安全机制 | 不是提示词白名单,也不会把被拒请求改成可接受请求 |

| X Adult Content Policy | X 上被标记、合意、允许展示的成人内容发布规则 | 不等于 Grok 可以生成相同内容,也不覆盖 xAI 服务规则 |

截至 2026 年 5 月 9 日,xAI 的 image capabilities documentation 能证明开发者图片路线存在,也说明生成内容会经过政策审核。这个结论对开发者很重要:API 可以让流程更可控、更适合接入产品,但它不是“更容易越过安全层”的通道。

xAI 的 Acceptable Use Policy 是更硬的边界。它覆盖消费者、开发者和企业场景,并禁止违法用途、侵犯隐私或公示权、儿童性化或剥削、以色情方式呈现他人肖像,以及规避安全机制。X 的 Adult Content Policy 范围更窄,主要说明合意成人材料在 X 上如何标记和发布。能在 X 上发布某类已标记内容,并不等于 Grok 或 xAI 服务允许生成那类内容。

哪些做法不要试

不要把被拒的图片请求当成谜题。系统拒绝可能是因为内容本身不允许,可能是模型无法安全判断,也可能是账号入口并不开放,还可能是请求本来就在推动安全机制失效。复制多轮指令、角色扮演、包装站教程或“已经可用”的社区截图,并不会让请求更安全。

| 停止场景 | 为什么必须停 | 更好的行动 |

|---|---|---|

| 规避安全机制 | xAI 政策要求尊重安全保护,除非处在官方授权的红队或评测范围内 | 停止,或转入有授权、有记录、有边界的安全测试 |

| 真实人物性化形象 | 肖像权、同意、骚扰、隐私、公示权和色情化风险同时出现 | 不生成、不编辑、不发布、不转发 |

| 未成年人或年龄不明主体 | 儿童安全和法律边界没有灰区 | 立即停止;如涉及已有内容,走举报或升级流程 |

| 非自愿私密影像 | 这是平台、法律和个人伤害问题,不是提示工程问题 | 只保留举报所需证据,不重做、不扩散 |

| “无过滤”“解除限制”“未删减”路线 | 这类词通常意味着转向不可信工具或试图让系统失效 | 不把它们当成个人使用或产品方案 |

这一节刻意不提供可执行细节。安全研究可以讨论越狱尝试存在,滥用报告也可以描述风险类型,但公开面向读者的文章不应该复述步骤、片段、样例或成功配方。真正有价值的动作是识别目标,然后选合法路线。

仍然可以走的合法路线

拒绝越狱路线,不代表所有读者都只得到一个“不能用”的答案。要看请求背后的真实任务。

如果真实任务是消费者访问,先回到当前账号对应的官方 Grok 或 X 入口。检查应用版本、登录账号、内容显示设置、年龄状态、地区、订阅识别和灰度状态。缺失入口不是使用修改客户端、共享账号、卖家代开或社区指令包的理由。可用性排查应由 Grok Imagine Spicy Mode 可用性检查 负责,那里处理账号和设置问题。

如果真实任务是开发,把 xAI 图片 API 当成受政策约束的开发者表面,而不是消费者入口的替代品。产品需要日志、内容审核、用户举报、删除机制、身份和同意判断,还需要明确拒绝策略。不要设计一个允许用户上传他人照片并要求性化处理的流程;这不是等待合适话术的功能需求,而是可以预见的伤害模式。

如果真实任务是安全测试,核心区别是授权。安全团队、信任与安全团队、模型评估人员或合同红队,可以在明确范围内使用非伤害样例、记录、披露规则和终止条件测试限制行为。公开帖里的“可复制方法”不是授权测试。

如果真实任务是处理已出现的有害内容,不要再生成一次,也不要为了求证而扩大传播。只保留举报所需的最小证据,使用平台举报入口;当可能涉及未成年人、非自愿私密影像、勒索、骚扰或真实人物深度伪造时,按组织或法律流程升级。

API 不是审核捷径

xAI 图片 API 听起来比消费者应用更可控,所以很多人会把它误读成更容易“绕开”的路线。这是错误的。API 是开发者合同:它说明请求格式、模型、计费、输出和集成方式,但不会取消可接受使用政策。

| API 问题 | 安全答案 |

|---|---|

| xAI 是否有图片生成文档? | 有。xAI 文档说明图片生成和图片编辑能力。 |

| 被消费者界面拒绝的内容能搬到 API 吗? | 不能这样推断。API 仍受政策审核和安全响应约束。 |

| API key 是否证明 Spicy Mode 可用? | 不能。消费者控件和开发者 API 是两套表面。 |

| API 是否适合真实人物性化编辑? | 不适合。肖像、同意、隐私、公示权、骚扰和非自愿私密影像风险会让这条路停止。 |

| 旧文章里的价格、模型和限制能直接抄吗? | 不应该。模型名、价格、计划、限制和地区都要按当天一手页面核对。 |

团队做产品评审时,不应该从“能不能让 Grok 生成”开始,而要从用例、用户上传物、身份和同意、地区、举报路径、删除机制、法律审核和拒绝策略开始。如果唯一能满足需求的方法是让安全机制失效,项目应停止,而不是改用 API。

这些风险不是抽象讨论

围绕 Grok 图像生成的公共风险已经进入监管和平台安全讨论。2026 年 1 月 16 日,加州总检察长向 xAI 发出 cease-and-desist letter,要求其停止与 Grok 相关的涉嫌深度伪造非自愿私密影像和儿童性虐待材料风险。两天前,该办公室还宣布调查 Grok sexual AI imagery。

英国方面,Ofcom 在 2026 年 1 月 12 日启动正式调查,关注 X 上与 Grok 性化影像有关的问题。后续记录提到 X 报告了缓解措施,同时调查状态仍需按官方页面描述。这里要谨慎:这些是带日期的监管动作和调查状态,不应写成最终法律结论。

对读者有用的结论更窄:非自愿私密影像、儿童安全、真实人物性化肖像、平台举报和快速删除,都是现实风险类别。一个搜索“越狱”的人应先看到这些风险,而不是先看到功能背景或社区技巧。

什么时候这不是越狱问题

很多 Grok 图像问题不应该继续放在越狱框架里。遇到下面几类情况,应把任务转交给更合适的来源。

| 实际问题 | 更好的负责人 |

|---|---|

| 当前账号看不到 Spicy Mode 或 Grok Imagine 控件 | Grok Imagine Spicy Mode 可用性检查 |

| 想理解 xAI/Grok 成人图像政策和平台争议 | Grok xAI NSFW image generation policy analysis |

| 想接入开发者图片生成 | xAI 图片 API 文档,加上团队内部安全和合规评审 |

| 已经出现有害输出 | 平台举报、证据保全和组织或法律升级流程 |

| 想确认当前价格、限制、地区或模型名 | 当天的一手结账页、账号控制台、官方文档或政策页面 |

这样分流可以避免重复和误导。访问文章负责合法可用性检查,政策文章负责成人内容和监管背景,API 文档负责开发者合同。越狱安全页只保留一个任务:当请求方法或目标不安全时,停止或重新分类。

哪些事实会变,哪些边界不该变

Grok 图像生成周边有很多事实会快速变化:模型名、API 价格、图片尺寸、临时 URL、消费者功能可见性、订阅包装、地区、账号控件、审核文案和监管状态。写作或采购决策需要这些事实时,应查看当天一手页面;如果事实对读者行动没有必要,就不要在文章里补一个看起来确定的数字。

不太会变的是核心边界。让安全机制失效不是正常消费者工作流。真实人物性化肖像、未成年人、非自愿私密影像和非法用途是硬停止场景。X 的成人内容发布规则不是 Grok 生成许可。xAI API 是开发者路线,不是漏洞。

组织内部也可以用同样的判断表:用户会上传什么、输出会影响谁、是否涉及真实身份、是否取得同意、有没有举报和删除机制、哪些地区上线、谁审核政策变化、拒绝时产品如何解释。如果答案必须依赖越过安全限制,路线本身就不应该进入实现阶段。

对个人用户也是一样:如果下一步需要隐藏身份、借用账号、修改客户端或反复试探拒绝边界,说明问题已经从“能不能用”变成“是否应该停”。这时停止比继续寻找技巧更可靠。

常见问题

Grok 图像越狱有安全做法吗?

没有适合公开读者使用的安全做法。遇到这类说法,应把它当成边界警告,再选择官方访问排查、合规 API、授权安全测试、举报,或者直接停止。

xAI API 会避开 Grok Imagine 的审核吗?

不会。xAI 文档说明图片生成和编辑 API,但开发者路线仍受政策审核和安全响应约束。API 是开发者合同,不是消费者控件或政策控制的替代品。

X 允许成人内容,是否代表 Grok 可以生成?

不代表。X 成人内容规则处理的是 X 上合意、标记、允许展示的成人材料。Grok 生成和 xAI 服务仍有自己的规则,尤其涉及非自愿内容、未成年人、真实人物肖像、违法用途和安全机制时。

Spicy Mode 不显示怎么办?

走官方访问排查:检查当前 Grok 或 X 入口、账号、内容显示设置、年龄状态、订阅识别、地区和灰度发布。不要把缺失控件当成寻找社区指令、共享账号或修改客户端的理由。

安全研究人员能测试 Grok 图像限制吗?

只能在授权范围内进行。负责任测试需要明确权限、记录、非伤害样例、披露规则和终止条件。公开社区方法不等于授权测试。

已经看到有害 Grok 图像时该怎么做?

举报疑似非自愿私密影像、未成年人性化内容、冒充、骚扰或真实人物肖像滥用。只保留举报所需证据,不要再生成、编辑、转发或扩散。