Google的gemini-3.1-flash-image-preview模型能够在4至6秒内生成高达4K分辨率的高质量图像。虽然Google官方API对标准1024像素图像收费$0.067且没有免费额度,但开发者可以通过laozhang.ai以每张仅$0.03的价格访问完全相同的模型——成本降低55%,同时完全兼容OpenAI SDK并支持实时处理。

要点速览

- 模型ID:

gemini-3.1-flash-image-preview(社区代号:Nano Banana 2) - 官方定价:每张图像$0.045-$0.151,取决于分辨率(无免费额度)

- 最低实时访问价格:通过laozhang.ai仅需$0.03/张——比Google 1K定价便宜55%

- 集成方式:完全兼容OpenAI SDK——只需修改2行代码

- 性能表现:支持4K分辨率,4-6秒生成,约90%文字渲染准确率

Gemini 3.1 Flash Image Preview是什么?

Gemini 3.1 Flash Image Preview是Google图像生成模型家族的最新成员,它将此前仅Pro级模型独有的高质量输出与Flash架构的速度效率完美结合。在开发者社区中,这个模型被称为Nano Banana 2,是Google原生图像生成能力的第三次进化——前两代分别是2025年8月发布的初代Nano Banana(gemini-2.5-flash-image)和2025年11月推出的Pro变体(gemini-3-pro-image-preview)。

该模型在Google AI官方文档页面上的描述是:"强大的高效率图像生成与编辑,专为速度和高并发使用场景优化"(Google AI for Developers,2026年2月)。这一定位揭示了Google的意图——Flash Image模型面向的是需要快速、经济高效地大规模生成图像的应用开发者,而非追求Pro模型在高端使用场景中所提供的绝对最高画质的用户。

这个模型之所以对开发者具有特殊意义,在于它实现的速度与质量之间的平衡。社区基准测试显示,标准图像的生成时间为4至6秒,大约是Pro变体所需的8至12秒的一半,同时图像质量与Pro级输出非常接近。该模型支持最高4K(4096x4096像素)分辨率,文字渲染准确率约为90%——对于需要在生成图像中包含可读文字的应用来说,这是一个关键指标。

该API遵循标准的Gemini规范,并支持OpenAI兼容的请求格式,因此可以通过开发者熟悉的SDK来访问。这对于已经在使用OpenAI DALL-E模型的开发者尤为重要——他们可以在不重写集成代码的情况下探索Gemini的图像生成功能。如需深入了解Flash和Pro架构的对比,可以查看Pro与Flash详细对比,该文覆盖了多个测试场景下的基准差异。

Nano Banana这一命名源于Google在正式发布之前,以匿名方式将模型提交到LMArena等社区基准测试平台的做法。初代Nano Banana于2025年8月出现在LMArena上,凭借相对紧凑体积下出人意料的强大图像生成能力迅速引起关注。当Pro变体于2025年11月发布时,社区将其命名为Nano Banana Pro以延续这一命名传统。3.1 Flash Image变体——即Nano Banana 2——继续沿用了这一传统,其社区代号如今在开发者论坛、Discord服务器和技术博客中被广泛认可和使用。

理解这一发展脉络的实际意义远不止于趣味知识。Nano Banana家族的每一次进化都在改善速度、质量和成本之间的平衡,而Flash Image变体是迄今为止在可及性方面最为激进的尝试。初代模型证明了Google有能力与成熟的图像生成器竞争;Pro变体将质量推向了同类最佳水平;而Flash变体如今以适合大规模生产使用的价格和速度使这种质量变得触手可及。这一演进表明Google的战略承诺是将图像生成打造为一种普惠能力,而非一项高端功能——这一趋势直接惠及基于这些API进行开发的开发者。

官方定价:完整解析

理解gemini-3.1-flash-image-preview的定价需要掌握Google基于token的计费模型,因为每张图像的实际成本会随输出分辨率的不同而有显著差异。Google对输出图像token的收费为每百万token $60.00,输入文本的价格为每百万token $0.25(Google AI Developer Pricing,2026年2月)。由于不同分辨率消耗的token数量不同,每张图像的实际成本也随之变化。

分辨率与成本的关系如下:一张512像素的图像大约消耗747个输出token,成本约为$0.045。标准1024像素图像使用约1,120个token,成本约$0.067。提升到2K(2048像素)分辨率时,token消耗增加到约1,680个,成本为每张$0.101,而最大4K(4096像素)分辨率需要约2,520个token,成本达到每张约$0.151。

| 分辨率 | 消耗Token数 | 每张成本 | 批处理成本(五折) |

|---|---|---|---|

| 512px | ~747 | $0.045 | $0.023 |

| 1024px | ~1,120 | $0.067 | $0.034 |

| 2048px | ~1,680 | $0.101 | $0.051 |

| 4096px | ~2,520 | $0.151 | $0.076 |

有一个关键细节经常让开发者措手不及:gemini-3.1-flash-image-preview没有免费额度。不同于Google的某些文本模型通过Google AI Studio提供慷慨的免费配额,图像生成模型从第一次调用起就需要付费API密钥。Google定价页面上该模型的免费额度栏明确显示"不可用",而且与稳定版本模型相比,它还具有"更严格的速率限制"。

Google确实提供了一个批处理API选项,可以对图像输出token享受50%的折扣,成本降至每百万token $30.00。这意味着每张1024像素图像约为$0.034——节省相当可观。然而,批处理模式有一个重大权衡:结果以异步方式交付,处理延迟最长可达24小时,这使其不适合实时应用或交互式用户体验。有关Gemini生态系统中免费和付费层级对比的更多背景信息,可参阅Gemini API免费层级指南。

输入token的成本——每百万token $0.25——容易被忽略,但值得了解,因为它适用于你在每次生成请求中发送的文本提示。一个典型的50-100词图像生成提示大约转换为75-150个token,每次请求的成本仅为几分之一美分($0.00002-$0.00004)。这意味着输入成本与输出图像成本相比基本可以忽略不计。不过,对于包含大量系统提示或带有参考图像的图像编辑指令的应用,输入token的消耗可能会变得有意义。Google对图像输入和文本输入收取相同的$0.25/M费率,因此在提示旁上传参考图像会按比例增加总成本。

整体定价结构揭示了一个重要的战略现实:Google将gemini-3.1-flash-image-preview的定价设置在适合生产使用但对于实验来说并非微不足道的水平。免费额度的缺失以及与文本生成相比($0.25/M的输入token可以处理数千次查询)相对较高的每张图像成本,传递了一个清晰的信号:Google将图像生成视为其API生态系统中的高端能力。这种定价策略也为第三方服务商提供了提供有竞争力替代方案的经济空间。

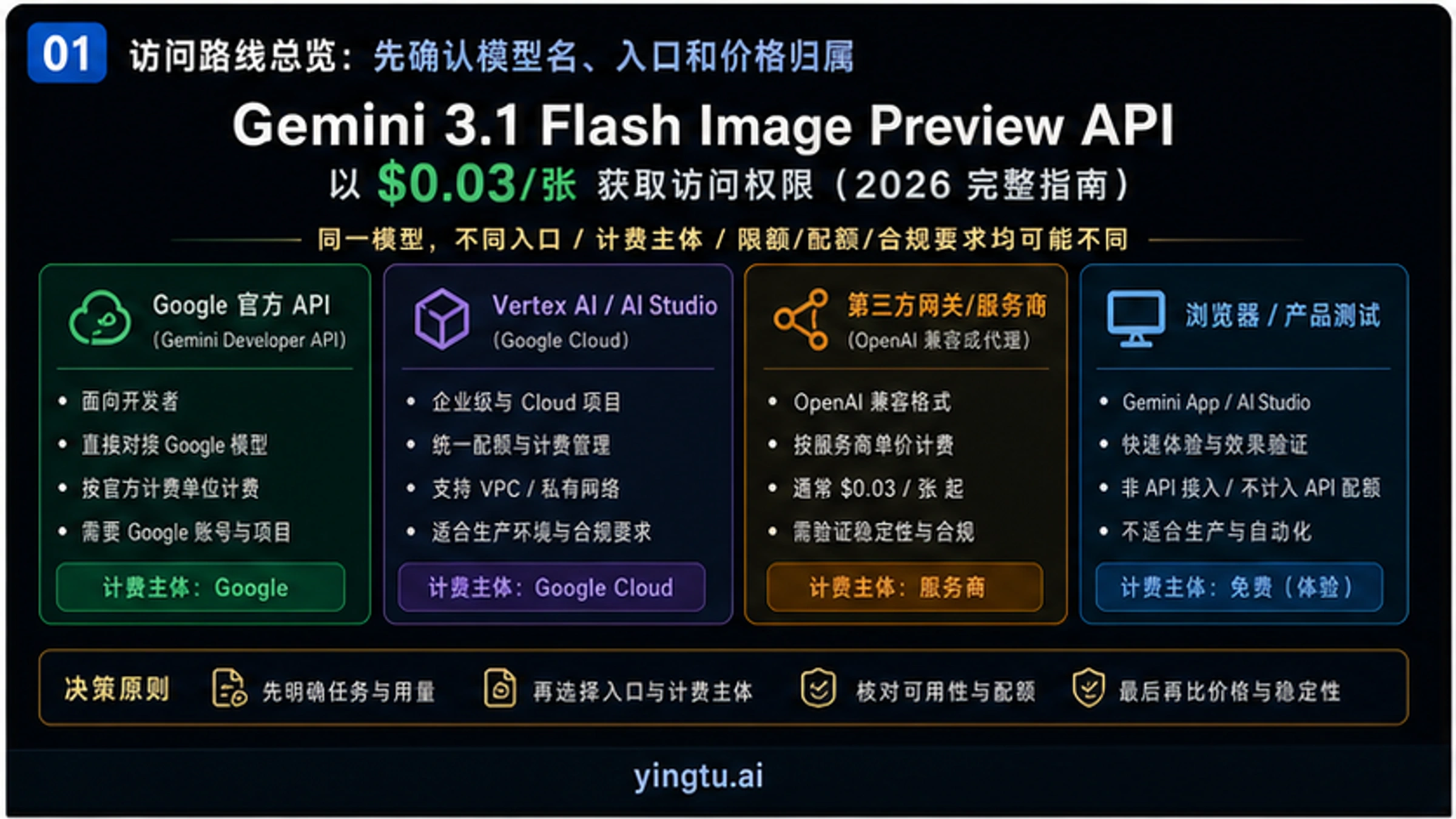

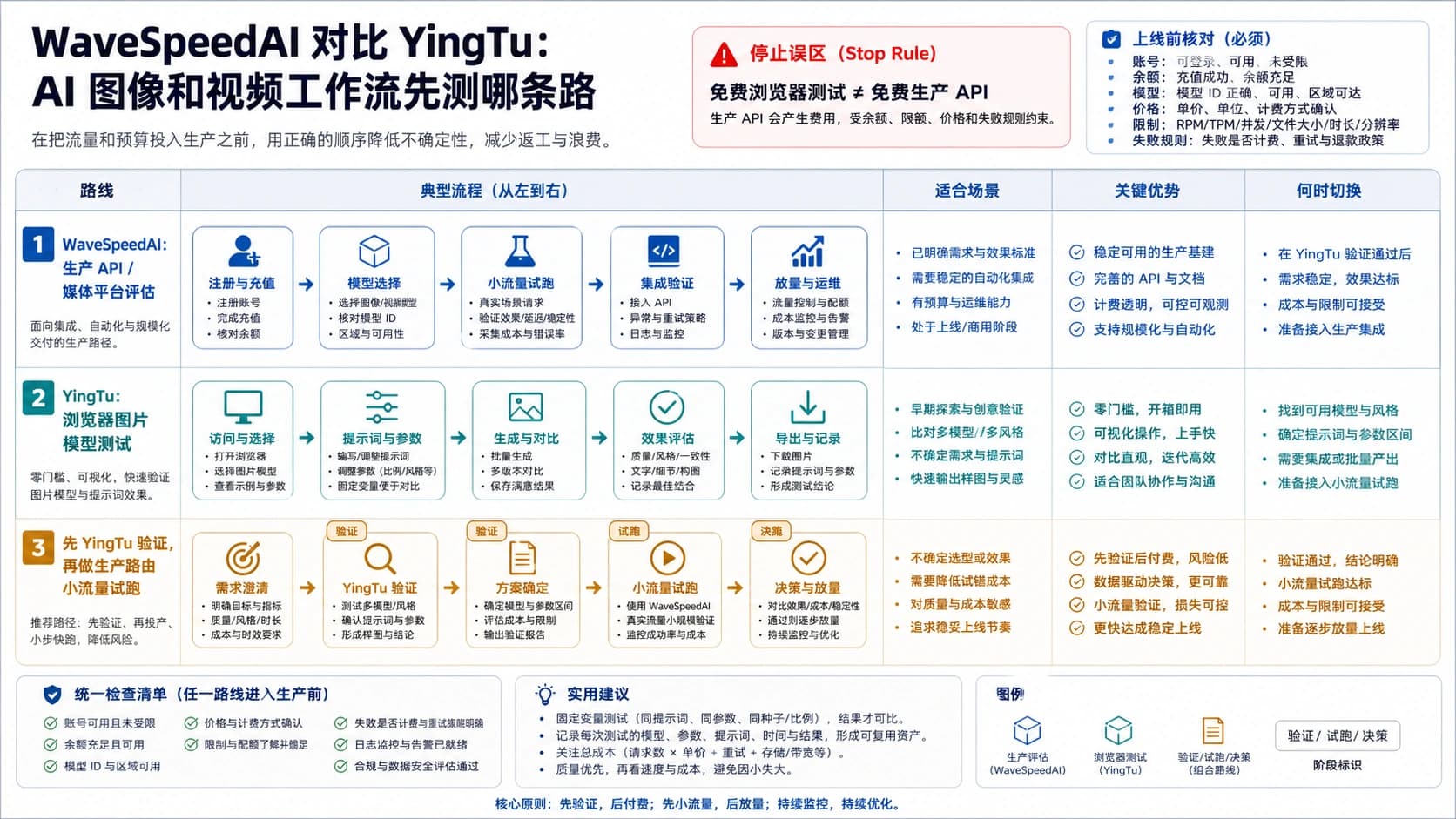

为什么Google官方API并非总是最佳选择

Google官方API提供了访问gemini-3.1-flash-image-preview最直接的途径,但若干实际考量使得探索替代方案具有价值——尤其是对于注重成本的开发者在构建生产级应用时。

首要挑战是实验阶段没有免费额度可用。习惯于利用其他Google AI模型免费配额进行原型开发的开发者面临一个直接障碍:测试gemini-3.1-flash-image-preview从第一次API调用起就需要付费。对于想要评估模型是否适合其用例的开发者来说,这意味着在做出任何架构决策之前就需要花费真金白银。即便只生成100张1024像素分辨率的测试图像,成本也达到$6.70——对个人开发者或正在探索方向的小型初创公司来说,这并非一笔小数目。

第二个限制涉及预览模型的严格速率限制。Google的文档明确指出,预览模型的"速率限制比稳定版本更为严格"。对于流量模式多变或具有突发性的应用——比如闪购期间的电商产品图像生成,或社交媒体工具在高峰时段的使用——这些限制可能成为直接影响用户体验的瓶颈。当你的应用触及速率限制时,用户看到的就是错误提示或加载动画,无论底层模型有多好。

第三个因素是规模化后的成本。考虑一个中等规模的应用每天以1024像素分辨率生成1,000张图像。按Google官方定价,这意味着每天$67,每月大约$2,010。对于资金有限的初创公司而言,$2,010与$900(通过第三方服务商每张$0.03)之间的差距代表着每月$1,110的节省——足以覆盖其他基础设施成本或以有意义的幅度延长公司的资金跑道。

第四个考量是计费本身的复杂性。Google基于token的图像定价创造了一种不直观的成本结构,同一API调用的费用可能在$0.045到$0.151之间浮动,取决于输出分辨率。对于允许用户选择图像尺寸的应用开发者来说,这种可变定价使成本预测变得困难。你需要实现分辨率感知的成本追踪,设置意外支出峰值的告警,并可能需要构建考虑不同分辨率成本差异的速率限制逻辑。采用统一费率的替代方案可以完全消除这一类工程复杂度。

当然,官方API也有真实的优势值得坦诚承认。Google的直接支持意味着出现问题时有明确的升级路径。企业客户可获得由Google基础设施支撑的保证SLA承诺。该API与Google Cloud的更广泛生态系统无缝集成——包括Vertex AI流水线、Cloud Storage存储生成的图像、IAM访问控制以及Cloud Monitoring可观测性。对于供应商关系和合规认证比单位成本经济性更重要的企业应用,官方API仍然是正确的选择。

关键洞察在于:"官方"并不自动等同于"最适合你的具体情况"。一个将图像生成功能集成到个人项目中的独立开发者,与一个有合规义务需大规模部署的企业团队,其需求有着根本性差异。两者都是合理的使用场景,但它们指向不同的最优解。

以$0.03/张访问gemini-3.1-flash-image-preview

对于想要获取Google Flash Image模型能力但不愿承担官方API定价开销的开发者,第三方API聚合服务商以显著降低的成本提供了对同一底层模型的访问。在可用的选项中,laozhang.ai以$0.03/张的价格提供gemini-3.1-flash-image-preview——这是一个不分输出分辨率的统一费率,随着分辨率升高Google基于token的定价急剧攀升时,这一优势愈发突出。

成本优势可以直观量化。在1024像素分辨率下,laozhang.ai的$0.03价格相比Google的$0.067降低了55%。在4K分辨率下,节省更加显著:$0.03对比Google的$0.151,成本降低达80%。统一费率定价模式消除了为不同分辨率计算token消耗的复杂性,使得成本预测对预算规划更简单、更可预见。

入门只需三步:

-

创建账户——访问docs.laozhang.ai,注册大约需要两分钟,初始注册过程不需要信用卡。

-

充值余额——最低充值金额为$5,按照每张$0.03的费率大约可以生成166张图像。这一低门槛意味着你可以在进行更大额充值之前充分测试服务的性能、延迟和图像质量。

-

复制API密钥并使用laozhang.ai的基础URL(

https://api.laozhang.ai/v1)配置你的客户端。该服务支持OpenAI兼容的API格式,因此如果你已经在使用OpenAI SDK,只需更改两个配置值:API密钥和基础URL。

该服务提供实时处理(无批处理延迟),对标准使用模式不施加严格的速率限制,并维护多服务商故障转移基础设施以确保可靠性。有关类似API信用体系方法的背景信息,Nano Banana API积分指南解释了不同服务商的每张图像信用体系如何运作。

透明度声明:Google官方API提供的直接厂商支持和企业级SLA保证是第三方服务商无法匹配的。如果你的应用需要合同级别的可用时间承诺或合规认证,尽管单位成本较高,官方API仍是更合适的选择。

完整集成指南:Python + OpenAI SDK

gemini-3.1-flash-image-preview兼容OpenAI格式的实际优势在于,集成只需对现有OpenAI图像生成实现进行极少的代码更改。以下是一个使用Python和OpenAI SDK生成图像并保存到本地的完整可运行示例。

前置条件:使用pip安装所需的包:

hljs bashpip install openai Pillow

完整可运行示例:

hljs pythonimport base64

from openai import OpenAI

from PIL import Image

from io import BytesIO

# 配置 - 修改这两个值即可切换服务商

API_KEY = "your-laozhang-api-key" # 从 docs.laozhang.ai 获取

BASE_URL = "https://api.laozhang.ai/v1" # laozhang.ai 端点

# 初始化客户端(与标准OpenAI用法相同)

client = OpenAI(

api_key=API_KEY,

base_url=BASE_URL,

)

# 生成图像 - 每次调用$0.03

response = client.images.generate(

model="gemini-3.1-flash-image-preview",

prompt="A modern tech startup office with floor-to-ceiling windows, "

"minimalist furniture, and warm afternoon sunlight casting "

"long shadows across the hardwood floor",

response_format="b64_json",

n=1,

)

# 解码并保存图像

image_data = response.data[0].b64_json

image = Image.open(BytesIO(base64.b64decode(image_data)))

image.save("generated_image.png")

print(f"Image saved: {image.size[0]}x{image.size[1]}px")

需要理解的关键细节是,gemini-3.1-flash-image-preview以base64编码数据而非托管URL的形式返回图像。这意味着你会直接在API响应中收到完整的图像数据,无需后续的下载请求。虽然这增加了响应的数据量,但它通过消除对图像托管服务的初始检索依赖简化了整体架构。

在服务商之间切换只需修改两行代码。要改用Google官方API,将配置修改为:

hljs python# Google 官方API配置

API_KEY = "your-google-api-key" # 从 aistudio.google.com 获取

BASE_URL = "https://generativelanguage.googleapis.com/v1beta/openai/"

其余一切——模型名称、请求结构、响应处理——保持完全一致。这种可互换性意味着你可以使用一个服务商进行测试,使用另一个进行部署,或者实现服务商故障转移逻辑而无需为不同的API维护单独的代码路径。

生产环境的错误处理:

hljs pythonimport time

from openai import OpenAI, APIError, RateLimitError

def generate_image_with_retry(client, prompt, max_retries=3):

for attempt in range(max_retries):

try:

response = client.images.generate(

model="gemini-3.1-flash-image-preview",

prompt=prompt,

response_format="b64_json",

n=1,

)

return response.data[0].b64_json

except RateLimitError:

wait_time = 2 ** attempt # 指数退避

time.sleep(wait_time)

except APIError as e:

if attempt == max_retries - 1:

raise

time.sleep(1)

return None

此模式实现了速率限制错误的指数退避和基本的瞬态API错误重试逻辑——两者对于可靠性与成本效率同等重要的生产环境部署都不可或缺。

批量图像生成是另一个常见的生产模式。当你需要从一组提示词生成多张图像时——例如为电商目录创建产品缩略图——顺序生成会浪费等待每个响应的时间。以下异步模式在遵守合理并发限制的同时并发生成图像:

hljs pythonimport asyncio

from openai import AsyncOpenAI

async_client = AsyncOpenAI(

api_key=API_KEY,

base_url=BASE_URL,

)

async def generate_batch(prompts, max_concurrent=5):

semaphore = asyncio.Semaphore(max_concurrent)

async def generate_one(prompt):

async with semaphore:

response = await async_client.images.generate(

model="gemini-3.1-flash-image-preview",

prompt=prompt,

response_format="b64_json",

n=1,

)

return response.data[0].b64_json

tasks = [generate_one(p) for p in prompts]

return await asyncio.gather(*tasks, return_exceptions=True)

# 并发生成20张图像(每次5张)

prompts = ["product photo of " + item for item in product_list]

results = asyncio.run(generate_batch(prompts))

这种方式处理20张图像所需的时间大约与顺序生成5张相同,因为4-6秒的生成时间在并发请求之间重叠。通过信号量将并发限制为5,你可以在保持远低于典型速率限制的同时,获得显著优于顺序处理的吞吐量。按laozhang.ai每张$0.03的价格,这批20张图像的总成本仅$0.60——而通过Google官方API在1024像素分辨率下则需要$1.34。

响应处理注意事项:base64响应格式意味着每个图像响应大约为1-4 MB,具体取决于分辨率。对于处理大量图像的应用,建议考虑将响应流式写入磁盘,而不是同时在内存中保持所有解码后的图像。上面示例中使用的PIL库能高效处理这一点,但内存受限的环境(无服务器函数、边缘Worker)可能需要在处理后显式清理解码后的图像缓冲区。

图像质量对比:Flash 3.1 vs Pro vs DALL-E 3

选择图像生成模型需要在多个因素之间取得平衡,而正确的选择很大程度上取决于你的具体使用场景,而非单一的基准数字。以下对比基于社区测试数据和官方规格,帮助你做出明智的决策。

Flash 3.1与Pro Image之间最关键的差异在于速度与质量的取舍。Flash 3.1在4至6秒内生成图像,而Pro需要8至12秒,对于生成速度影响用户体验的应用来说,吞吐量实际上翻了一倍。对于交互式应用——对话中生成图像的聊天机器人、实时设计工具或面向客户的产品可视化——这种速度优势直接转化为更高的用户满意度。质量差异虽然可以量化,但在大多数典型使用场景中细微到终端用户几乎不会注意到。

| 指标 | Flash 3.1 | Pro Image | DALL-E 3 |

|---|---|---|---|

| 最大分辨率 | 4K (4096x4096) | 4K (4096x4096) | 1K (1024x1024) |

| 生成速度 | 4-6秒 | 8-12秒 | 15-25秒 |

| 文字渲染准确率 | ~90% | ~94% | ~85% |

| 成本(1K图像) | $0.03 (laozhang.ai) | $0.134(官方) | $0.040 (OpenAI) |

| 角色一致性 | ~90% | 高 | 中等 |

| 最适场景 | 大批量、速度优先 | 最高质量、文字密集 | 创意、艺术风格 |

文字渲染准确率是Pro模型保持明显优势的领域。Pro模型约94%的准确率对比Flash 3.1的约90%,对于生成图像中必须包含可靠可读文字的应用——产品标签、含数据的信息图、带标语的营销素材——Pro模型是更好的选择。但对于文字渲染并非关键的图像——风景、人像、抽象艺术、不含文字叠加的产品照片——4%的准确率差异实际上无关紧要,而55%的成本节省却非常实在。

OpenAI的DALL-E 3在这一版图中占据着不同的位置。其最大分辨率限制为1024x1024,无法匹配任何一个Gemini模型的4K能力。15至25秒的生成速度明显更慢。然而,DALL-E 3在创意和艺术图像生成方面表现出色,具有某些应用特别偏爱的独特美学风格。其与OpenAI生态系统的原生集成也使其成为已深度嵌入OpenAI平台的团队阻力最小的选择。

根据具体应用场景的实际建议如下。对于电商和产品可视化,Flash 3.1是明确的赢家——快速生成、4K分辨率支持放大查看以及每张$0.03的经济性三者结合,使得按规模生成独特产品图像成为可行方案,而不必完全依赖摄影。一个拥有10,000个商品的产品目录可以用不到$300的成本生成主图,仅为专业摄影费用的零头。

对于内容营销和社交媒体,Flash 3.1能有效应对大多数使用场景。博客文章头图、社交媒体图形和新闻简报插图很少需要完美的文字渲染,因此约90%的准确率完全足够。速度优势意味着你的内容团队可以在创意过程中实时生成和迭代视觉素材,而不是每张图像等待数分钟。

对于技术文档和数据可视化这类文字准确性至关重要的场景,Pro模型的较高成本是值得的。包含代码截图的API文档、带精确数据标签的信息图以及教学示意图,都受益于Pro模型94%的文字渲染准确率——当一个渲染错误的数字可能误导用户时,那额外的4个百分点就很重要了。

对于大多数构建图像生成功能的API优先型应用,以每张$0.03访问的Flash 3.1提供了最强的性价比——特别是通过laozhang.ai等服务商访问时成本优势最为突出。关于整个Gemini Flash系列最便宜选项的详尽分析,可参阅最便宜的Gemini Flash API方案获取更多信息。

生产环境的成本优化策略

将gemini-3.1-flash-image-preview从开发推向生产意味着需要仔细考虑成本优化——因为微小的每张图像节省在规模化后会产生巨大的复合效应。每张$0.03与$0.067的成本差异在单独看来似乎微不足道,但分摊到每天数千甚至数万次的生成量上,它从根本上改变了应用的经济模型。

基于量级的成本分析揭示了服务商选择的真实影响:

| 日生成量 | Google官方(1K) | Google批处理 | laozhang.ai | 相比官方的月度节省 |

|---|---|---|---|---|

| 100张 | $6.70/天 | $3.40/天 | $3.00/天 | $111 |

| 1,000张 | $67.00/天 | $34.00/天 | $30.00/天 | $1,110 |

| 10,000张 | $670.00/天 | $340.00/天 | $300.00/天 | $11,100 |

在每天10,000张图像的量级下,使用laozhang.ai替代Google官方API的年度节省超过$133,000。即便与Google的批处理定价相比,laozhang.ai每年也能节省$12,000——而且没有批处理模式带来的24小时处理延迟。这些并非理论数字,而是将定价差异应用于实际生产量级后的直接结果。

除服务商选择外,若干架构决策可以进一步降低每张图像的成本。缓存生成的图像是最具影响力的方法:如果你的应用为重复的提示词生成相似的图像(产品类别缩略图、标准头像样式、基于模板的设计),存储并重用先前的结果可以完全消除冗余的API调用。一个使用提示文本作为键的简单哈希缓存可以为具有重复生成模式的应用减少30-60%的实际API调用。

分辨率优化同样重要。并非每个使用场景都需要4K输出。一个在网站上以200像素显示的缩略图不会因为以4096像素分辨率生成而受益。通过将请求分辨率匹配到实际显示尺寸——为缩略图生成512像素,为标准网页展示生成1024像素,将4K保留给打印或全屏使用——你可以在使用Google官方API时最小化token消耗,并在任何服务商下最大化预算利用率。

提示词工程也间接影响成本。精心编写的提示词能在首次尝试时就产生可接受的结果,从而消除重新生成的需要。在开发阶段花时间打磨提示词模板——测试不同的措辞、具体度水平和风格指令——在生产环境中通过减少每张成功图像的平均API调用次数来产生回报。最便宜的图像生成调用就是你根本不需要发出的那一次。

服务商故障转移策略在不显著增加平均成本的情况下增强了弹性。通过将应用配置为先通过主要服务商(laozhang.ai,$0.03)尝试图像生成,仅当主服务商不可用时才回退到Google官方API,你可以实现接近完美的正常运行时间,同时将平均成本维持在接近最低价格的水平。在实际运行中,主要服务商的可用性通常超过99.5%,因此稍贵的回退服务商被调用的频率低到对整体成本的影响可以忽略不计。这一模式也可以反向使用——对非紧急的后台任务使用Google批处理API,对实时面向用户的请求使用laozhang.ai,为每条路径的特定延迟和成本需求进行优化。

监控和告警是完善生产就绪成本优化策略的最后一环。设置每日成本追踪,将实际支出与你的每张图像预算进行对比。每张图像成本的突然飙升可能表明你的应用无意中请求了超出预期的更高分辨率,或者某次代码更改移除了缓存层。在数小时内而非在账单周期结束时发现这些问题,对高流量应用来说可以节省数千美元。大多数API服务商(包括laozhang.ai)都提供使用量仪表盘和可通过API访问的计费数据,使这种监控易于实现。

这些策略的复合效应是显著的。一个实施了缓存(减少30-60%)、分辨率优化(可变节省)、优质提示词工程(减少10-20%的重新生成)以及服务商选择($0.03 vs $0.067)的应用,在典型工作负载下可以将有效每张图像成本降低到远低于$0.02——将图像生成从一项显著的支出项目转变为可管理、可预测的费用。

常见陷阱及避免方法

首次集成gemini-3.1-flash-image-preview的开发者经常遇到几个一旦了解就容易预防的问题。最常见的错误是尝试通过免费的Google AI Studio API密钥使用该模型。由于该模型没有免费额度,这些请求会立即失败并返回认证或计费错误,如果你期望获得与Gemini文本模型相同的免费访问权限,这可能会令人困惑。解决方案很直接:确保你的API密钥关联了付费计费账户,或使用laozhang.ai等第三方服务商,其基于信用的计费方式清晰明了。

第二个常见问题涉及响应格式的预期。从DALL-E或其他图像API迁移过来的开发者通常期望响应中包含一个指向托管图像的URL。Gemini的图像生成模型返回的仅是base64编码的图像数据——没有URL选项。如果你的现有代码期望响应中有url字段,它将失败或返回null。始终设置response_format="b64_json"并实现上述集成指南中展示的base64解码流程。

内容过滤是另一个开发者遇到意外行为的领域。Gemini的图像生成模型包含内置的安全过滤器,可能会拒绝包含某些关键词或概念的提示词,即使预期的输出是良性的。如果你收到内容策略错误,问题通常出在提示词中的特定触发词而非整体意图。在保持相同创意方向的同时重新措辞提示词以避开被标记的术语——通常就能解决问题。Google的安全过滤倾向于比OpenAI更为保守,因此在DALL-E上可用的提示词可能需要为Gemini模型进行调整。

最后,请注意预览模型的速率限制。与稳定版Gemini模型不同,预览变体执行更严格的每分钟请求上限。对于具有突发流量模式的应用,建议实现一个请求队列来平滑API调用而不是发送触发速率限制器的突发请求。本指南前面展示的指数退避模式处理的是单个速率限制错误,而基于队列的方法则从源头防止错误的发生,从而带来更可预测的延迟和更好的用户体验。

常见问题解答

gemini-3.1-flash-image-preview有免费额度吗?

没有。Google官方定价页面对gemini-3.1-flash-image-preview的免费额度明确标注为"不可用"。这同时适用于Google AI Studio和Vertex AI访问方式。最经济的测试入口是通过laozhang.ai等第三方服务商,$5的信用额度大约可以生成166张图像——足以进行充分评估而不需要大额资金投入。

我可以将现有的OpenAI代码用于这个模型吗?

可以。Gemini的图像生成模型支持OpenAI兼容的API格式。你只需要更改两个配置值:API密钥和基础URL。请求结构、响应格式(base64编码的图像)和错误处理模式与OpenAI的图像生成API保持一致。模型参数改为gemini-3.1-flash-image-preview,其他一切照常工作。

$0.03/张与Google的批处理定价相比如何?

Google的批处理API提供50%的折扣,将1024像素图像的成本降至约$0.034。这与laozhang.ai的$0.03统一费率接近,但有一个关键区别:批处理模式引入了最长24小时的结果交付延迟。laozhang.ai以相当的价格提供实时处理,对于需要即时图像交付的应用来说是更好的选择。对于处理延迟可接受的应用,Google的批处理API是一个可行的成本优化替代方案。

支持的最大图像分辨率是多少?

Gemini 3.1 Flash Image Preview支持最高4K分辨率(4096x4096像素)的图像生成。当使用Google基于token的定价时,分辨率直接影响成本(512像素时$0.045到4K时$0.151),但像laozhang.ai这样采用统一费率定价的服务商无论输出分辨率如何都收取相同的$0.03——使得4K生成通过第三方访问特别具有成本效益。

通过第三方服务商的图像质量会降低吗?

不会。像laozhang.ai这样的第三方API服务商将请求路由到相同的底层Google模型。生成的图像在质量、分辨率和特征方面与通过Google官方API产生的完全相同。成本差异反映的是服务商的商业模式和基础设施效率,而非模型输出的质量差异。相同的提示词无论通过哪个端点访问gemini-3.1-flash-image-preview都会产生等效的结果。